Оптимизация производительности веб-приложений: стратегии кэширования с Redis и Varnish на VPS/Dedicated

TL;DR: Краткое резюме

- Двухуровневое кэширование – ключ к успеху в 2026 году: Комбинация Varnish (HTTP-кэш, "близкий" к пользователю) и Redis (объектный/данный кэш, "близкий" к приложению) обеспечивает максимальную производительность и отказоустойчивость для веб-приложений.

- Varnish Cache для HTTP-трафика: Идеален для кэширования полных HTTP-ответов, статического и часто запрашиваемого динамического контента. Значительно снижает нагрузку на бэкенд и ускоряет доставку контента, особенно на VPS/Dedicated серверах.

- Redis для объектного и сессионного кэширования: Высокопроизводительное хранилище данных в оперативной памяти, незаменимое для кэширования результатов запросов к БД, пользовательских сессий, временных данных и реализации счетчиков/очередей.

- Гибкая инвалидация кэша – критически важна: Эффективные стратегии инвалидации (Soft Purge для Varnish, TTL и Pub/Sub для Redis) предотвращают выдачу устаревших данных и поддерживают консистентность.

- Мониторинг и оптимизация – непрерывный процесс: Использование инструментов вроде Prometheus, Grafana, Redis CLI и Varnishlog позволяет отслеживать метрики производительности, выявлять узкие места и настраивать конфигурации для максимальной эффективности.

- Экономия ресурсов и масштабирование: Правильное кэширование снижает потребность в более мощных серверах, откладывая дорогостоящий апгрейд и упрощая горизонтальное масштабирование бэкенда.

- Безопасность и отказоустойчивость: Важно не только ускорять, но и защищать. Правильная настройка Varnish как обратного прокси, а также кластеризация Redis с Sentinel, повышают надежность и устойчивость к атакам.

3. Введение

Схема: 3. Введение

Схема: 3. Введение

В стремительно развивающемся мире веб-приложений, где каждая миллисекунда задержки может обернуться потерей пользователя или клиента, производительность становится не просто желаемым свойством, а критически важным требованием. К 2026 году пользователи ожидают мгновенного отклика от любого сервиса, будь то SaaS-платформа, интернет-магазин или корпоративный портал. Медленно загружающиеся страницы не только ухудшают пользовательский опыт, но и негативно влияют на SEO-рейтинг, конверсию и, как следствие, на доходы бизнеса.

Эта проблема особенно актуальна для проектов, развернутых на VPS (Virtual Private Server) или Dedicated (выделенных) серверах, где ресурсы хоть и ограничены, но поддаются тонкой настройке и оптимизации. В отличие от бессерверных или полностью управляемых облачных решений, VPS/Dedicated дают полный контроль над инфраструктурой, что открывает широкие возможности для ручной оптимизации, но также накладывает ответственность за эффективное использование каждого гигабайта RAM и каждого ядра CPU.

Данная статья призвана стать исчерпывающим руководством по внедрению и оптимизации стратегий кэширования с использованием двух мощнейших инструментов: Redis и Varnish Cache. Мы рассмотрим, как их синергия позволяет добиться феноменальных результатов в скорости и стабильности работы веб-приложений. Целевая аудитория этого гайда — это опытные DevOps-инженеры, бэкенд-разработчики (независимо от используемого стека: Python, Node.js, Go, PHP), фаундеры SaaS-проектов, системные администраторы и технические директора стартапов, которые стремятся выжать максимум из своей инфраструктуры и обеспечить бесперебойную работу своих сервисов.

Мы углубимся в практические аспекты, предоставим конкретные примеры конфигураций, обсудим типичные ошибки и предложим эффективные пути их решения. Наша цель — дать вам не просто теоретические знания, но и набор инструментов и рекомендаций, которые можно немедленно применить для улучшения производительности ваших веб-приложений в условиях 2026 года.

4. Основные критерии/факторы оптимизации производительности

Схема: 4. Основные критерии/факторы оптимизации производительности

Схема: 4. Основные критерии/факторы оптимизации производительности

Перед тем как погрузиться в детали реализации кэширования, необходимо четко понимать, какие метрики и факторы определяют производительность веб-приложения и как их оценивать. Эффективная оптимизация всегда начинается с измерения и анализа.

4.1. Время отклика (Latency)

Почему важен: Это время, которое проходит с момента отправки запроса пользователем до получения первого байта ответа. Высокая задержка напрямую коррелирует с плохим пользовательским опытом и высоким показателем отказов. Google и другие поисковые системы учитывают время отклика как важный фактор ранжирования.

Как оценивать:

- TTFB (Time To First Byte): Измеряется браузерными инструментами разработчика, Lighthouse, WebPageTest.

- Server Response Time: Метрики из APM-систем (Application Performance Monitoring) вроде New Relic, Datadog, Prometheus.

- Ping/Traceroute: Для оценки сетевой задержки между клиентом и сервером.

Цель — снизить TTFB до минимума, в идеале до 100-200 мс для большинства запросов, а для кэшированных — до 10-50 мс.

4.2. Пропускная способность (Throughput)

Почему важна: Количество запросов, которые сервер может обработать за единицу времени (например, RPS - requests per second). Высокая пропускная способность позволяет приложению справляться с большим количеством одновременных пользователей без деградации производительности.

Как оценивать:

- RPS/QPS (Requests/Queries Per Second): Мониторинг логов веб-сервера (Nginx, Apache), метрики из APM.

- Concurrent Connections: Количество активных соединений, обрабатываемых сервером.

- Load Testing: Использование инструментов вроде Apache JMeter, k6, Locust для симуляции нагрузки и определения максимальной пропускной способности.

Важно не только абсолютное значение RPS, но и стабильность этого значения при росте нагрузки.

4.3. Коэффициент попаданий в кэш (Cache Hit Ratio)

Почему важен: Процент запросов, которые были обслужены из кэша, без обращения к бэкенду или базе данных. Чем выше этот показатель, тем меньше нагрузка на основные вычислительные ресурсы и тем быстрее ответы.

Как оценивать:

- Varnishlog/Varnishstat: Предоставляют детальную статистику по попаданиям (Hit) и промахам (Miss) для HTTP-кэша.

- Redis INFO: Метрики

keyspace_hits и keyspace_misses для Redis.

- Custom Application Metrics: Реализация собственного счетчика попаданий/промахов для объектного кэша в приложении.

Для Varnish желательно достигать 90%+ hit ratio для кэшируемого контента. Для Redis — от 70% и выше в зависимости от типа данных.

4.4. Использование ресурсов сервера (Resource Utilization)

Почему важно: Эффективное использование CPU, RAM, дискового I/O и сетевого трафика. Высокая утилизация без видимых причин указывает на узкие места. Низкая утилизация может означать избыточные ресурсы или неэффективный код.

Как оценивать:

- CPU Usage:

top, htop, Prometheus/Grafana. В идеале средняя утилизация CPU должна быть в пределах 60-80% под пиковой нагрузкой, оставляя запас для всплесков.

- Memory Usage:

free -h, Prometheus/Grafana. Важно отслеживать не только общее потребление, но и кэши (Varnish, Redis) и потребление памяти приложением.

- Disk I/O:

iostat, Prometheus/Grafana. Высокая активность диска часто указывает на неэффективные запросы к БД или отсутствие кэширования.

- Network I/O:

iftop, Prometheus/Grafana. Мониторинг входящего/исходящего трафика для выявления аномалий и оценки пропускной способности.

Оптимальное использование ресурсов позволяет максимально эффективно использовать ваш VPS или Dedicated сервер, откладывая необходимость дорогостоящего апгрейда.

4.5. Масштабируемость (Scalability)

Почему важна: Способность системы справляться с растущей нагрузкой путем добавления ресурсов (вертикальное масштабирование) или новых экземпляров (горизонтальное масштабирование). Правильное кэширование значительно упрощает горизонтальное масштабирование бэкенда.

Как оценивать:

- Response Time vs. Load: Как меняется время отклика при увеличении числа пользователей. Идеально, если оно остается стабильным.

- Resource Utilization vs. Load: Линейный рост утилизации ресурсов при линейном росте нагрузки свидетельствует о хорошей масштабируемости.

- Cost-effectiveness of Scaling: Сколько стоит обработка дополнительного пользователя/запроса.

Цель — спроектировать систему так, чтобы добавление нового сервера бэкенда или Redis-инстанса приводило к пропорциональному увеличению пропускной способности.

Понимание этих критериев является фундаментом для принятия обоснованных решений по оптимизации и позволяет точно измерять эффект от внедряемых изменений.

5. Сравнительная таблица: Redis vs. Varnish (по состоянию на 2026 год)

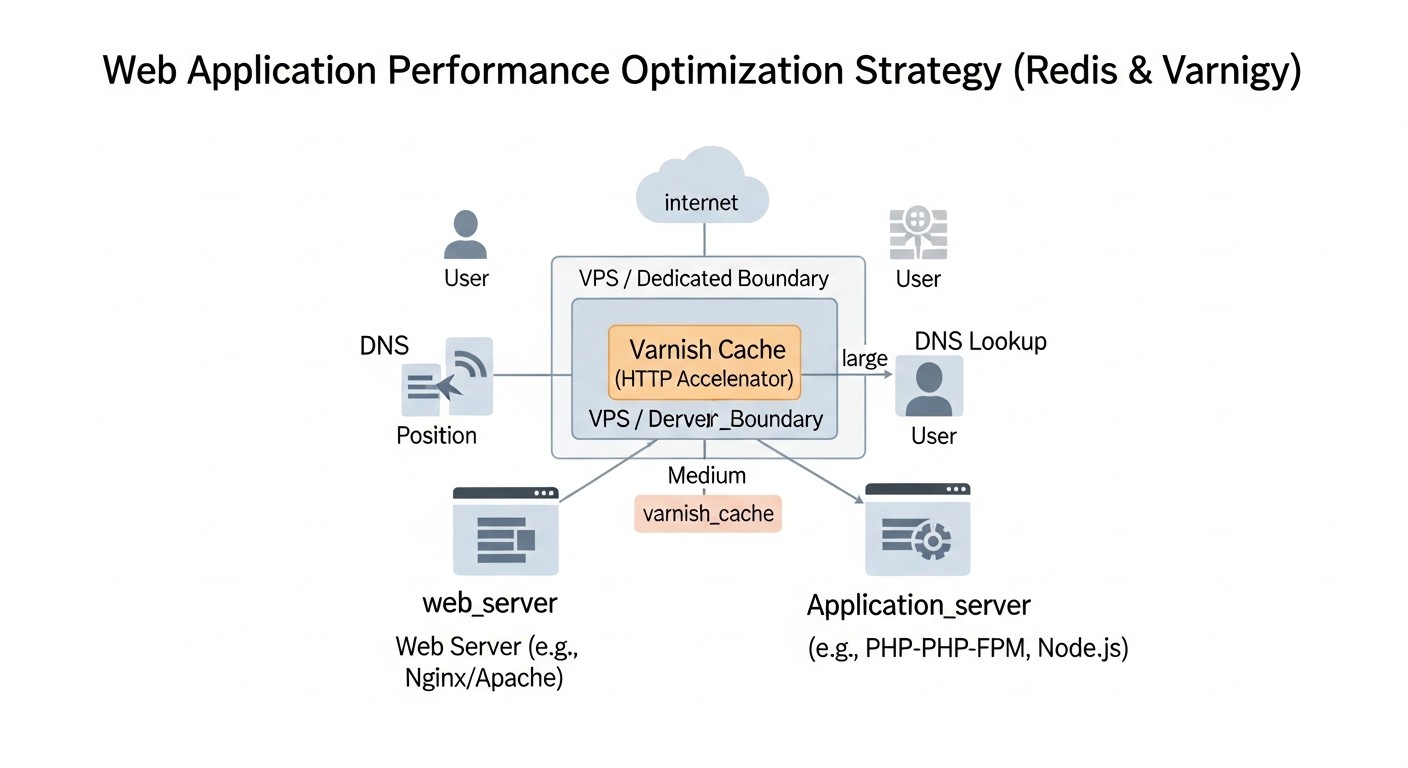

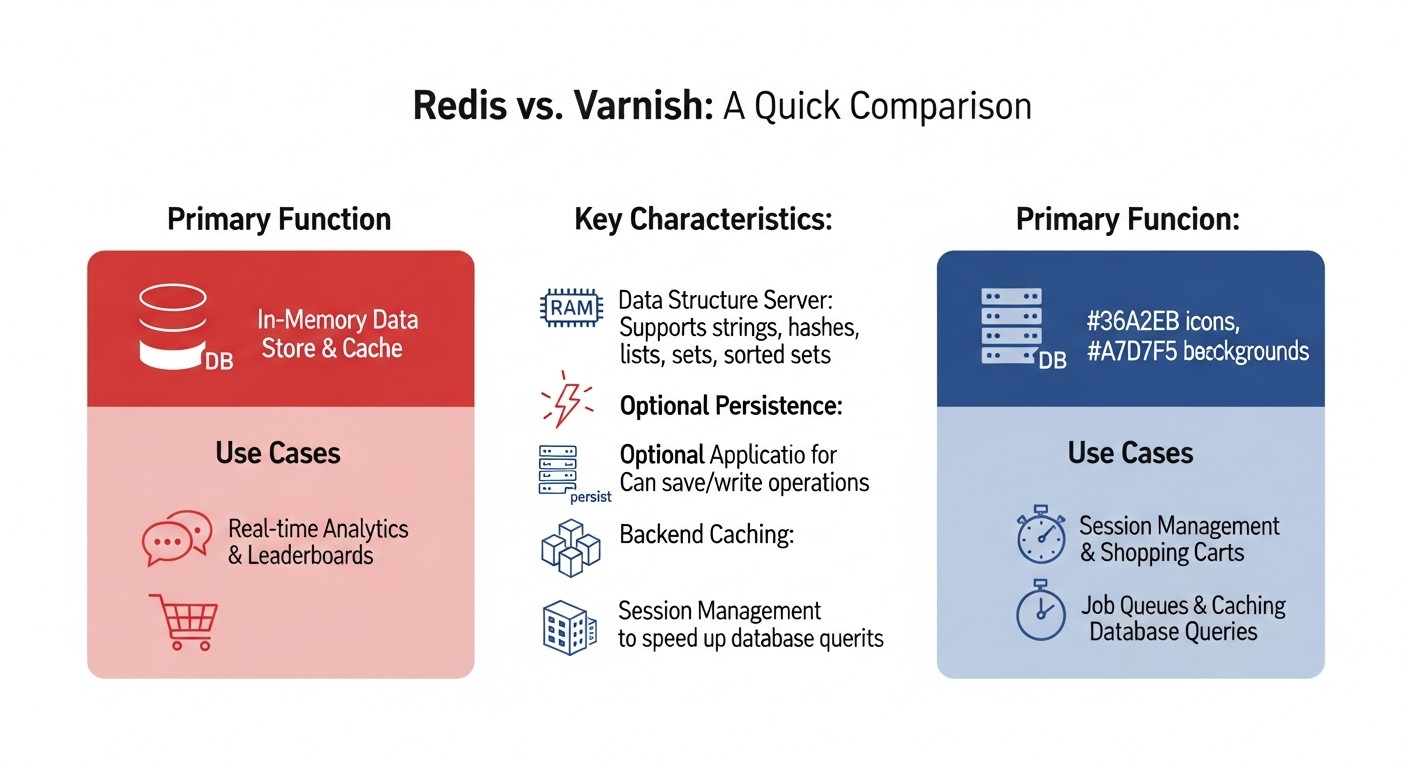

Схема: 5. Сравнительная таблица: Redis vs. Varnish (по состоянию на 2026 год)

Схема: 5. Сравнительная таблица: Redis vs. Varnish (по состоянию на 2026 год)

Хотя Redis и Varnish часто используются вместе, они решают разные задачи в стеке производительности веб-приложений. Эта таблица поможет понять их основные различия и области применения.

| Критерий |

Redis |

Varnish Cache |

Комментарии (Актуально для 2026 года) |

| Основное назначение |

Хранилище данных в оперативной памяти (ключ-значение, структуры данных) |

HTTP-акселератор / Реверс-прокси с кэшированием |

Redis — бэкенд-кэш, Varnish — фронтенд-кэш. Синергия дает максимальный эффект. |

| Тип кэшируемых данных |

Результаты запросов к БД, сессии, токены, счетчики, очереди, метаданные, временные объекты |

Полные HTTP-ответы (страницы, API-ответы), статические файлы (CSS, JS, изображения) |

Redis работает с "сырыми" данными, Varnish — с готовыми HTTP-объектами. |

| Место в стеке |

Между приложением и базой данных |

Между клиентом (браузером) и веб-сервером/приложением |

Varnish обычно находится перед Nginx/Apache, Redis — доступен из кода приложения. |

| Протокол |

Собственный протокол (RESP), TCP |

HTTP/1.1, HTTP/2 (через прокси, например, Nginx) |

Varnish нативно работает с HTTP. Redis — с бинарными данными через свой протокол. |

| Персистентность данных |

Опционально (RDB-снимки, AOF-журнал) |

Неперсистентный, кэш очищается при перезапуске |

Redis может быть использован как база данных, Varnish — только как временное хранилище. |

| Поддержка SSL/TLS |

Напрямую не поддерживает (нужен stunnel или прокси) |

Напрямую не поддерживает (нужен Nginx/HAProxy впереди Varnish) |

К 2026 году это стандартная практика: SSL-терминация происходит на Nginx/HAProxy, затем трафик идет в Varnish по HTTP. |

| Масштабирование |

Кластер, Sentinel (для высокой доступности), шардинг |

Горизонтальное (несколько инстансов за балансировщиком), ESI для частичного кэширования |

Оба хорошо масштабируются, но по-разному. Redis для данных, Varnish для трафика. |

| Язык конфигурации / API |

CLI, клиентские библиотеки для языков программирования |

VCL (Varnish Configuration Language) |

VCL позволяет очень гибко настраивать правила кэширования и обработки запросов. |

| Требования к ресурсам |

RAM (основной потребитель), CPU (для сериализации/десериализации) |

RAM (основной потребитель), CPU (для обработки HTTP, VCL) |

Оба требуют достаточно RAM, но Varnish может быть более CPU-интенсивным при сложной VCL. |

| Лицензия / Стоимость |

BSD (Open Source), доступны коммерческие облачные сервисы |

BSD (Open Source), доступны коммерческие версии с поддержкой |

На VPS/Dedicated оба могут быть развернуты бесплатно. Коммерческие версии предлагают расширенные функции и поддержку. |

| Типичная задержка |

<1 мс (в памяти) |

~1-5 мс (из кэша, зависит от сети) |

Оба обеспечивают очень низкую задержку, но Redis ближе к приложению. |

| Инвалидация кэша |

TTL, команды DEL/FLUSH, Pub/Sub |

PURGE/BAN-запросы, TTL |

Varnish PURGE/BAN обычно более "тяжелые" для реализации, чем Redis DEL. |

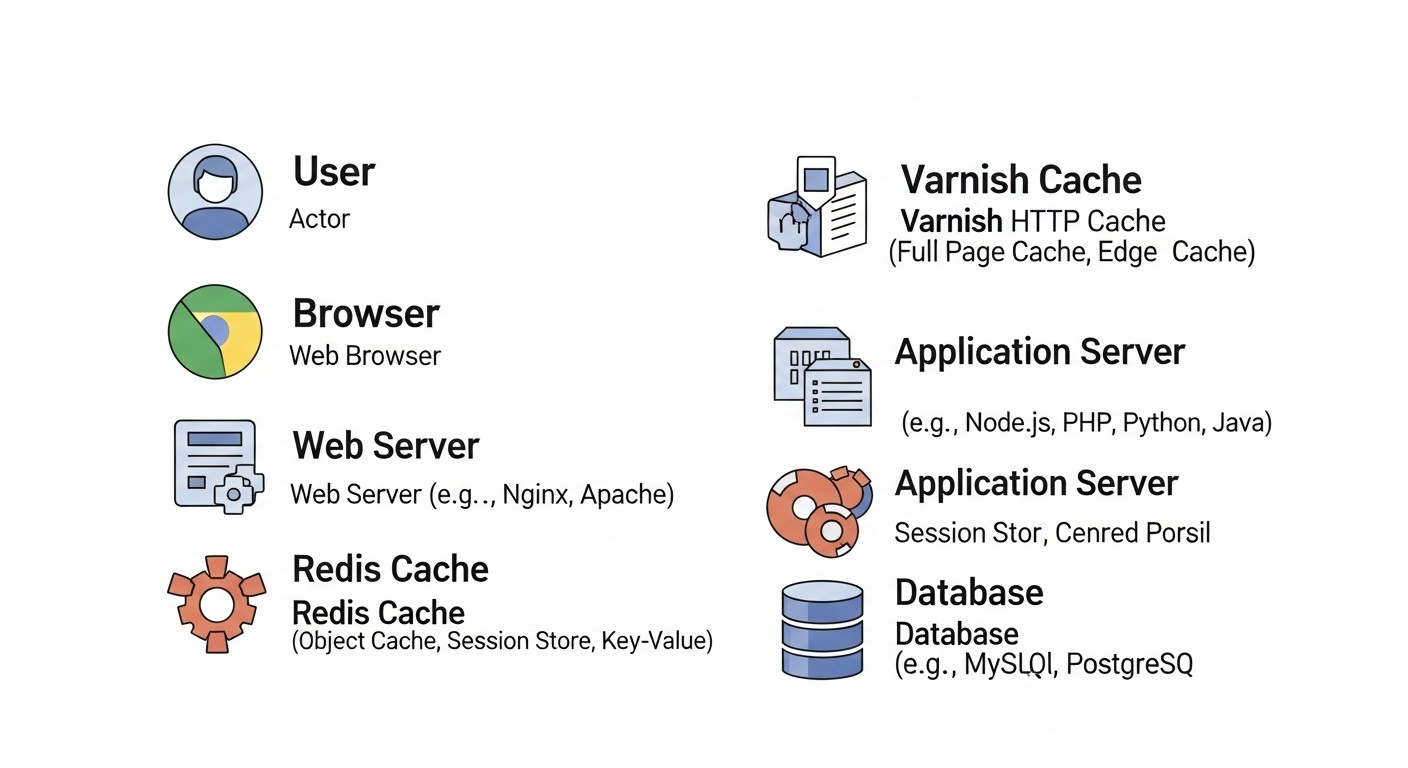

6. Детальный обзор Redis и Varnish

Схема: 6. Детальный обзор Redis и Varnish

Схема: 6. Детальный обзор Redis и Varnish

Для создания высокопроизводительного веб-приложения на VPS/Dedicated серверах недостаточно просто установить Redis и Varnish. Необходимо глубоко понимать их архитектуру, возможности и области применения, чтобы эффективно интегрировать их в свою инфраструктуру.

6.1. Redis: Хранилище данных в оперативной памяти

Redis (Remote Dictionary Server) — это высокопроизводительное, открытое хранилище данных в оперативной памяти, которое часто называют "структурой данных на стероидах". Он поддерживает множество абстрактных типов данных, таких как строки, хеши, списки, множества, отсортированные множества с запросами диапазона, битовые карты, HyperLogLogs, геопространственные индексы и потоки. Это делает Redis невероятно универсальным инструментом для множества задач, выходящих за рамки простого кэширования.

6.1.1. Преимущества Redis

- Невероятная скорость: Поскольку Redis хранит данные в оперативной памяти, операции чтения и записи выполняются за доли миллисекунды. Это критически важно для высоконагруженных систем, где каждый запрос к базе данных может стать узким местом.

- Гибкость типов данных: В отличие от простых систем ключ-значение, Redis позволяет хранить сложные структуры данных, что упрощает разработку и оптимизирует работу с данными. Например, хеши идеально подходят для кэширования профилей пользователей, а отсортированные множества — для рейтингов или лент активности.

- Атомарные операции: Все операции в Redis атомарны, что гарантирует целостность данных при одновременном доступе из нескольких клиентов, без необходимости в сложных механизмах блокировок на стороне приложения.

- Персистентность (опционально): Redis может сохранять данные на диск (RDB-снимки или AOF-журнал), что позволяет восстановить состояние кэша после перезапуска сервера, превращая его в полноценную базу данных NoSQL.

- Публикация/Подписка (Pub/Sub): Встроенная функциональность для обмена сообщениями в реальном времени, что полезно для инвалидации кэша, уведомлений или создания чатов.

- Транзакции и Lua-скрипты: Позволяют выполнять несколько команд как единое целое или реализовывать сложную логику на стороне сервера, минимизируя сетевые задержки.

- Кластеризация и высокая доступность: Redis Sentinel обеспечивает автоматическое переключение при сбое мастера, а Redis Cluster позволяет горизонтально масштабировать хранилище данных по нескольким узлам.

6.1.2. Недостатки Redis

- Зависимость от RAM: Основной недостаток — все данные должны помещаться в оперативную память. Это может быть дорого при очень больших объемах данных, особенно на VPS/Dedicated.

- Отсутствие встроенной безопасности: Redis изначально не предназначен для работы в недоверенных сетях. Требует тщательной настройки брандмауэра и аутентификации.

- Сложность настройки кластера: Хотя кластер Redis мощный, его настройка и управление могут быть сложными для новичков.

6.1.3. Примеры использования Redis в 2026 году

- Кэширование результатов запросов к БД: Самый распространенный сценарий. Вместо повторного обращения к PostgreSQL или MySQL, результаты запросов кэшируются в Redis.

- Хранение пользовательских сессий: Особенно актуально для распределенных приложений, где сессии должны быть доступны с любого экземпляра бэкенда.

- Счетчики и рейтинги: Высокопроизводительные инкременты/декременты, отсортированные списки для лидербордов.

- Очереди задач: Реализация фоновых задач с помощью списков Redis (например, с Celery для Python, BullMQ для Node.js).

- Полнотекстовый поиск (RedisSearch): С помощью модуля RedisSearch можно построить быстрый полнотекстовый поиск прямо в Redis.

- Rate Limiting: Ограничение количества запросов от пользователя/IP за определенный период.

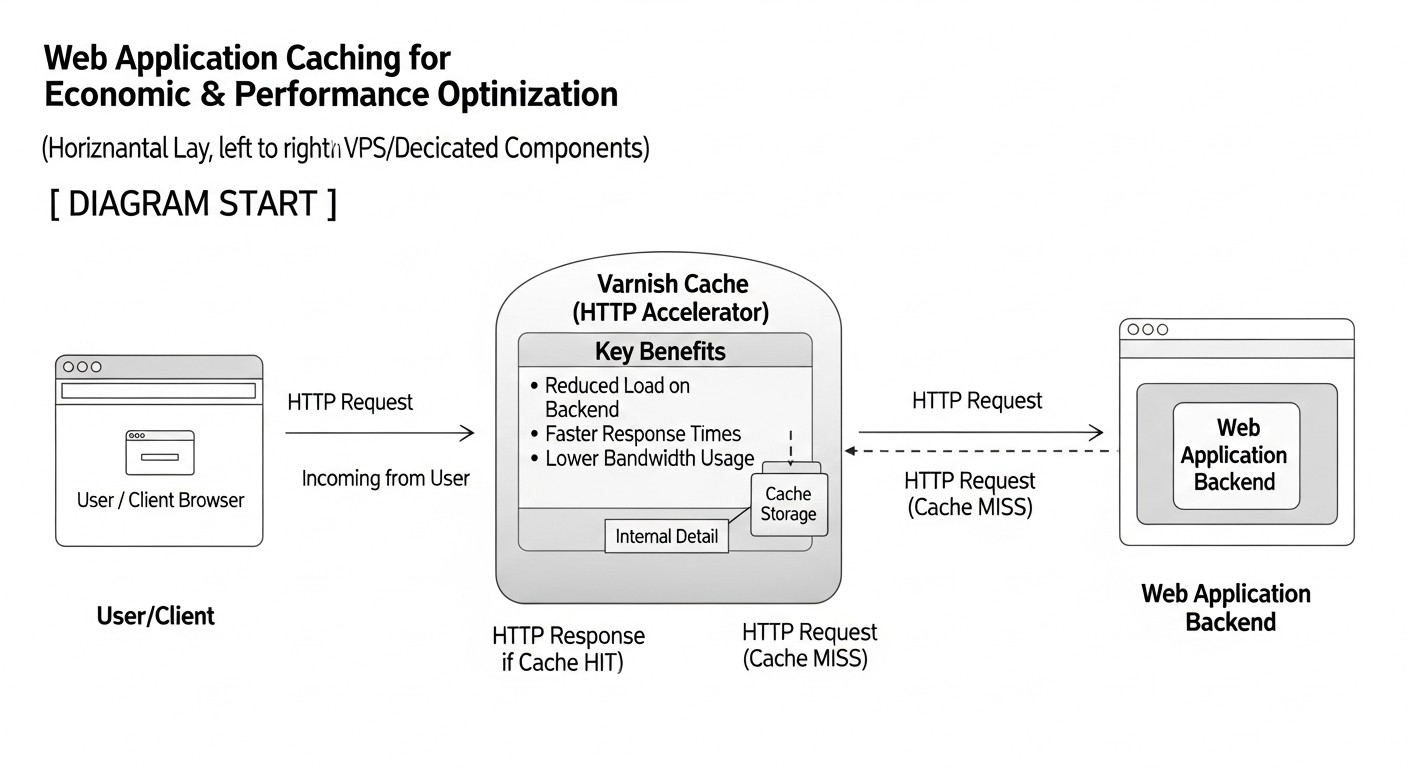

6.2. Varnish Cache: Высокопроизводительный HTTP-акселератор

Varnish Cache — это открытый HTTP-акселератор, или обратный прокси-сервер, разработанный специально для кэширования HTTP-ответов. Он располагается между клиентом и вашим веб-сервером/приложением (Nginx/Apache/Gunicorn/PM2), перехватывает все входящие HTTP-запросы и, если ответ для данного запроса уже есть в кэше, мгновенно отдает его, не обращаясь к бэкенду. Это значительно снижает нагрузку на сервер приложений и базу данных, а также сокращает время ответа для конечного пользователя.

6.2.1. Преимущества Varnish

- Феноменальная скорость: Varnish полностью работает в оперативной памяти, что позволяет отдавать кэшированные ответы с минимальной задержкой. Он оптимизирован для обработки огромного количества одновременных соединений.

- Мощный VCL (Varnish Configuration Language): VCL — это предметно-ориентированный язык, который позволяет писать очень гибкие правила для обработки HTTP-запросов и ответов. Вы можете настраивать правила кэширования, маршрутизации, модификации заголовков, балансировки нагрузки и многое другое.

- ESI (Edge Side Includes): Позволяет кэшировать части страниц независимо друг от друга. Например, можно кэшировать большую часть страницы, но оставить некэшируемым блок с корзиной пользователя. Varnish "склеивает" эти части на лету.

- Graceful Degradation: Varnish может продолжать отдавать устаревшие, но все еще актуальные объекты из кэша, даже если бэкенд недоступен (например, во время деплоя или сбоя). Это значительно повышает отказоустойчивость.

- Поддержка HTTP/2 (через внешний прокси): К 2026 году Varnish сам по себе не поддерживает HTTP/2 напрямую, но прекрасно работает в связке с Nginx или HAProxy, которые обеспечивают HTTP/2 и SSL-терминацию.

- Снижение нагрузки на бэкенд: Основная функция Varnish — принимать на себя основную часть HTTP-трафика, позволяя вашим серверам приложений сосредоточиться на обработке сложной бизнес-логики.

6.2.2. Недостатки Varnish

- Отсутствие встроенной SSL/TLS: Varnish не может напрямую обрабатывать HTTPS-трафик. Перед ним всегда должен стоять SSL-терминирующий прокси (Nginx, HAProxy). Это добавляет дополнительный слой в архитектуру.

- Неперсистентный кэш: Кэш Varnish полностью хранится в RAM и сбрасывается при перезапуске сервиса. Это означает, что после перезапуска Varnish должен будет снова заполнять свой кэш.

- Сложность конфигурации VCL: Хотя VCL очень мощный, его изучение и правильная настройка для сложных сценариев может быть вызовом. Неправильная конфигурация может привести к нежелательным эффектам или некорректному кэшированию.

- Не подходит для персональных данных: Varnish не следует использовать для кэширования конфиденциальной информации, специфичной для каждого пользователя, если только не используются сложные механизмы ESI и очень строгая инвалидация.

6.2.3. Примеры использования Varnish в 2026 году

- Кэширование неперсонализированных страниц: Главные страницы, страницы категорий, статьи блога, публичные API-ответы.

- Кэширование статических файлов: CSS, JavaScript, изображения, шрифты. Хотя Nginx также хорош для этого, Varnish может добавить дополнительный уровень контроля.

- Ускорение API-запросов: Если API возвращает данные, которые меняются редко или являются публичными, Varnish может кэшировать эти ответы.

- Graceful Degradation: Обеспечение доступности сайта даже при временных сбоях бэкенда.

- Распределение нагрузки: С помощью VCL можно реализовать простые механизмы балансировки нагрузки между несколькими бэкендами.

Совместное использование Redis и Varnish позволяет создать многоуровневую систему кэширования, которая эффективно обрабатывает как HTTP-запросы, так и внутренние данные приложения, обеспечивая максимальную производительность и отказоустойчивость.

7. Практические советы и рекомендации по внедрению

Схема: 7. Практические советы и рекомендации по внедрению

Схема: 7. Практические советы и рекомендации по внедрению

Теперь, когда мы понимаем возможности Redis и Varnish, перейдем к конкретным шагам по их внедрению и настройке на VPS/Dedicated серверах. Мы будем исходить из того, что у вас есть базовый сервер с Ubuntu 24.04 (актуально для 2026 года) и веб-приложение, работающее, например, через Gunicorn/PM2 за Nginx.

7.1. Внедрение Redis в приложение

Redis должен быть установлен на том же сервере, что и ваше приложение, или на выделенном сервере Redis (для больших проектов). Для начала установим его:

sudo apt update

sudo apt install redis-server -y

sudo systemctl enable redis-server

sudo systemctl start redis-server

7.1.1. Базовая конфигурация Redis

Отредактируйте файл /etc/redis/redis.conf. Ключевые параметры:

bind 127.0.0.1 ::1: Redis должен слушать только локальный интерфейс, если он используется только приложением на том же сервере. Если Redis вынесен на отдельный сервер, укажите IP-адрес, доступный для бэкенда, и настройте фаервол.protected-mode yes: Оставьте включенным для безопасности.maxmemory <размер>mb: Установите лимит на использование RAM. Например, maxmemory 2048mb. Это критично для VPS/Dedicated.maxmemory-policy allkeys-lru: Политика вытеснения ключей при достижении лимита памяти. LRU (Least Recently Used) — хороший выбор для кэша.requirepass <ваш_сложный_пароль>: Обязательно установите пароль для продакшн-окружения.

sudo nano /etc/redis/redis.conf

# После изменений перезапустите Redis

sudo systemctl restart redis-server

7.1.2. Интеграция Redis в код приложения

Примеры для разных языков:

Python (с Flask/Django):

# Установка библиотеки

# pip install redis Flask-Caching

import redis

from flask import Flask, request

from flask_caching import Cache

app = Flask(__name__)

app.config['CACHE_TYPE'] = 'redis'

app.config['CACHE_REDIS_HOST'] = 'localhost'

app.config['CACHE_REDIS_PORT'] = 6379

app.config['CACHE_REDIS_DB'] = 0

app.config['CACHE_REDIS_PASSWORD'] = 'ваш_сложный_пароль' # Если установлен

cache = Cache(app)

@app.route('/api/products')

@cache.cached(timeout=300) # Кэшировать на 5 минут

def get_products():

# Имитация долгого запроса к БД

products = fetch_products_from_database()

return {'products': products}

@app.route('/api/user_session')

def get_user_session():

user_id = request.args.get('user_id')

r = redis.StrictRedis(host='localhost', port=6379, db=0, password='ваш_сложный_пароль')

session_data = r.get(f'session:{user_id}')

if session_data:

return {'session': session_data.decode('utf-8')}

return {'message': 'Session not found'}

# Для инвалидации кэша

def invalidate_product_cache():

with app.app_context():

cache.delete_memoized(get_products) # Удалить кэш конкретной функции

Node.js (с Express):

// Установка библиотеки

// npm install redis connect-redis express-session

const express = require('express');

const redis = require('redis');

const session = require('express-session');

const connectRedis = require('connect-redis');

const app = express();

const RedisStore = connectRedis(session);

const redisClient = redis.createClient({

host: 'localhost',

port: 6379,

password: 'ваш_сложный_пароль' // Если установлен

});

redisClient.on('error', (err) => console.log('Redis Client Error', err));

app.use(session({

store: new RedisStore({ client: redisClient }),

secret: 'super_secret_key_2026',

resave: false,

saveUninitialized: false,

cookie: { secure: false, maxAge: 86400000 } // 24 часа

}));

app.get('/api/data', (req, res) => {

// Проверяем кэш перед запросом к БД

redisClient.get('cached_data_key', async (err, data) => {

if (data) {

console.log('Serving from Redis cache');

return res.send(JSON.parse(data));

}

console.log('Serving from database');

const dbData = await fetchDataFromDatabase(); // Долгая операция

redisClient.setex('cached_data_key', 300, JSON.stringify(dbData)); // Кэшируем на 5 минут

res.send(dbData);

});

});

7.1.3. Стратегии инвалидации кэша Redis

- TTL (Time To Live): Самый простой способ. При записи данных в Redis указывайте время жизни ключа (

SETEX).

- Проактивная инвалидация: При изменении данных в базе данных, отправляйте команду

DEL в Redis для соответствующих ключей.

- Pub/Sub: Используйте Redis Pub/Sub для оповещения всех экземпляров приложения о необходимости инвалидировать кэш, например, при изменении глобальных настроек.

- Кэш-тегирование: Если данные зависят от нескольких сущностей, храните список ключей в Redis, связанных с каждой сущностью, и при изменении сущности удаляйте все связанные ключи.

7.2. Настройка Varnish Cache

Varnish будет работать перед Nginx. Nginx будет терминировать SSL и проксировать запросы в Varnish по HTTP, а Varnish, в свою очередь, будет проксировать их в ваш бэкенд (Gunicorn/PM2).

7.2.1. Установка Varnish

sudo apt install varnish -y

sudo systemctl enable varnish

sudo systemctl start varnish

7.2.2. Настройка Nginx для работы с Varnish

Ваш Nginx должен слушать порт 443 (HTTPS) и проксировать запросы на порт Varnish (по умолчанию 6081). Varnish будет слушать порт 80 (HTTP).

Пример конфигурации Nginx (/etc/nginx/sites-available/your_app.conf):

server {

listen 80;

listen 443 ssl http2;

server_name your_domain.com www.your_domain.com;

ssl_certificate /etc/letsencrypt/live/your_domain.com/fullchain.pem;

ssl_certificate_key /etc/letsencrypt/live/your_domain.com/privkey.pem;

ssl_session_cache shared:SSL:10m;

ssl_session_timeout 10m;

ssl_protocols TLSv1.2 TLSv1.3;

ssl_ciphers "ECDHE-ECDSA-AES128-GCM-SHA256:ECDHE-RSA-AES128-GCM-SHA256:ECDHE-ECDSA-AES256-GCM-SHA384:ECDHE-RSA-AES256-GCM-SHA384:DHE-RSA-AES128-GCM-SHA256:DHE-RSA-AES256-GCM-SHA384";

ssl_prefer_server_ciphers on;

# Проксируем все запросы в Varnish, который слушает на 127.0.0.1:80

# Varnish будет ожидать HTTP-трафик

location / {

proxy_pass http://127.0.0.1:80; # Varnish будет слушать порт 80

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

proxy_set_header X-Forwarded-Port $server_port;

proxy_set_header Connection ""; # Важно для HTTP/1.1

}

# Для статики, которая не должна кэшироваться Varnish (или кэшируется Nginx)

# location ~ \.(jpg|jpeg|gif|png|webp|ico|css|js)$ {

# expires 30d;

# add_header Cache-Control "public, no-transform";

# try_files $uri @backend; # Если статика не найдена, отдаем бэкенду

# }

}

sudo systemctl restart nginx

7.2.3. Конфигурация Varnish (/etc/varnish/default.vcl)

Varnish по умолчанию слушает порт 6081. Мы изменим его на 80, чтобы Nginx мог проксировать запросы на него.

Отредактируйте /etc/default/varnish или /etc/systemd/system/varnish.service.d/override.conf (предпочтительнее) и измените порт:

# Для Ubuntu 24.04, скорее всего, нужно отредактировать systemd unit

sudo systemctl edit varnish

# Вставьте:

# [Service]

# ExecStart=

# ExecStart=/usr/sbin/varnishd -a :80 -F -a localhost:8443,HTTP/2 -T localhost:6082 -f /etc/varnish/default.vcl -S /etc/varnish/secret -s malloc,2G

# Здесь -a :80 означает, что Varnish слушает публичный порт 80

# localhost:8443 - это ваш Nginx, который слушает на 8443 (или другой порт)

# -s malloc,2G - это 2GB памяти для кэша

Или, если у вас старый способ через /etc/default/varnish (менее вероятно для 2026):

sudo nano /etc/default/varnish

# Измените VARNISH_LISTEN_PORT на 80

# VARNISH_LISTEN_PORT=80

Теперь основной файл VCL: /etc/varnish/default.vcl. Это ваш основной инструмент управления кэшированием.

Предположим, ваш бэкенд (Gunicorn, PM2 и т.д.) слушает на порту 8000.

vcl 4.1;

# Определяем бэкенд - ваше приложение

backend default {

.host = "127.0.0.1";

.port = "8000";

.probe = {

.url = "/health"; # Эндпоинт для проверки здоровья бэкенда

.timeout = 1s;

.interval = 5s;

.window = 5;

.threshold = 3;

}

}

# Обработка входящих запросов

sub vcl_recv {

# Удаляем нежелательные заголовки, которые могут мешать кэшированию

unset req.http.Cookie; # По умолчанию не кэшируем, если есть Cookie

# Если запрос - PURGE, проверяем IP и выполняем очистку

if (req.method == "PURGE") {

if (!client.ip ~ "127.0.0.1") { # Разрешить PURGE только с localhost

return (synth(403, "Forbidden"));

}

return (purge);

}

# Если запрос BAN, проверяем IP и выполняем бан

if (req.method == "BAN") {

if (!client.ip ~ "127.0.0.1") {

return (synth(403, "Forbidden"));

}

ban("req.url ~ " + req.url + " && req.http.host == " + req.http.host);

return (synth(200, "Ban added"));

}

# Всегда пропускаем POST, PUT, DELETE, PATCH

if (req.method != "GET" && req.method != "HEAD") {

return (pass);

}

# Не кэшируем админку

if (req.url ~ "^/admin") {

return (pass);

}

# Передача IP клиента в бэкенд через X-Forwarded-For

if (req.http.X-Forwarded-For) {

set req.http.X-Forwarded-For = req.http.X-Forwarded-For + ", " + client.ip;

} else {

set req.http.X-Forwarded-For = client.ip;

}

# Хеширование запроса для кэша (чтобы разные URL с query-параметрами кэшировались по-разному)

# Можно нормализовать URL, если query-параметры не влияют на контент

# Например, отбросить UTM-метки

# set req.url = regsub(req.url, "\?utm_.", "");

return (hash);

}

# Обработка ответов от бэкенда

sub vcl_backend_response {

# Если бэкенд установил Cookie, то обычно не кэшируем

if (beresp.http.Set-Cookie) {

return (uncache);

}

# Кэшируем успешные ответы на 5 минут

if (beresp.status == 200 || beresp.status == 203 || beresp.status == 301 || beresp.status == 302 || beresp.status == 304 || beresp.status == 307) {

set beresp.ttl = 5m; # Время жизни кэша по умолчанию

return (deliver);

}

# Для ошибок или других статусов не кэшируем

return (deliver);

}

# Обработка ответов от Varnish клиенту

sub vcl_deliver {

# Добавляем заголовок, чтобы видеть, был ли ответ из кэша

if (obj.hits > 0) {

set resp.http.X-Cache = "HIT";

} else {

set resp.http.X-Cache = "MISS";

}

# Удаляем внутренние заголовки, если они не нужны клиенту

unset resp.http.X-Varnish;

unset resp.http.Via;

}

# Обработка ошибок Varnish

sub vcl_synth {

if (resp.status == 403) {

set resp.http.Content-Type = "text/html; charset=utf-8";

synthetic( {"

403 Forbidden

403 Forbidden

Доступ запрещен.

"} );

return (deliver);

}

return (deliver);

}

sudo systemctl restart varnish

7.2.4. Инвалидация кэша Varnish

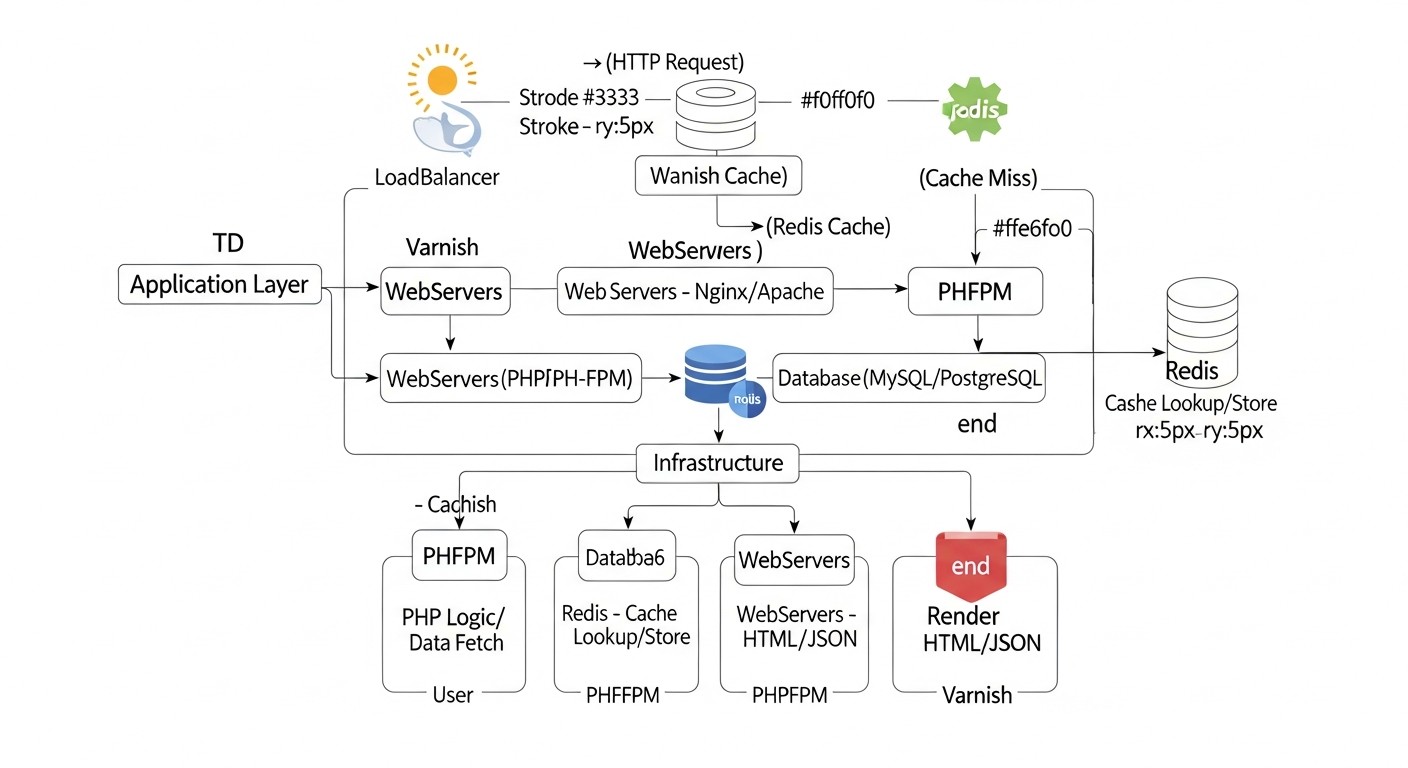

7.3. Комбинированная стратегия кэширования

Идеальная стратегия — это многоуровневое кэширование:

- Браузерный кэш: HTTP-заголовки

Cache-Control, Expires, ETag для статики и редко меняющихся страниц.

- Varnish (обратный прокси/HTTP-акселератор): Кэширование полных HTTP-ответов для неперсонализированного контента и статики.

- Redis (объектный кэш): Кэширование результатов запросов к БД, сессий, промежуточных вычислений в приложении.

- Кэш в приложении (in-memory): Для очень часто используемых, но редко меняющихся данных (например, конфигурация, справочники).

- Кэш СУБД: (например, pgBouncer, MySQL query cache, хотя последний часто не рекомендуется).

Каждый уровень кэширования должен иметь свою стратегию инвалидации и время жизни, соответствующее частоте изменения данных. Например, данные в Redis могут иметь TTL 5-30 минут, в то время как Varnish может кэшировать публичные страницы на 1-2 часа, а статику — на дни или недели.

Пример потока запроса:

- Клиент запрашивает

your_domain.com/products.

- Nginx терминирует SSL и передает запрос в Varnish (порт 80).

- Varnish проверяет свой кэш:

- HIT: Varnish мгновенно отдает кэшированный ответ клиенту.

- MISS: Varnish передает запрос на бэкенд (порт 8000).

- Приложение (бэкенд) получает запрос:

- Пытается получить данные из Redis (например, список продуктов).

- Если данные в Redis (HIT), использует их.

- Если данные не в Redis (MISS), делает запрос к БД.

- Полученные из БД данные кэширует в Redis и возвращает ответ Varnish.

- Varnish получает ответ от бэкенда, кэширует его (если разрешено VCL) и отдает клиенту.

Такой подход обеспечивает максимальную производительность, снижая нагрузку на каждый последующий уровень стека.

8. Типичные ошибки при кэшировании и как их избежать

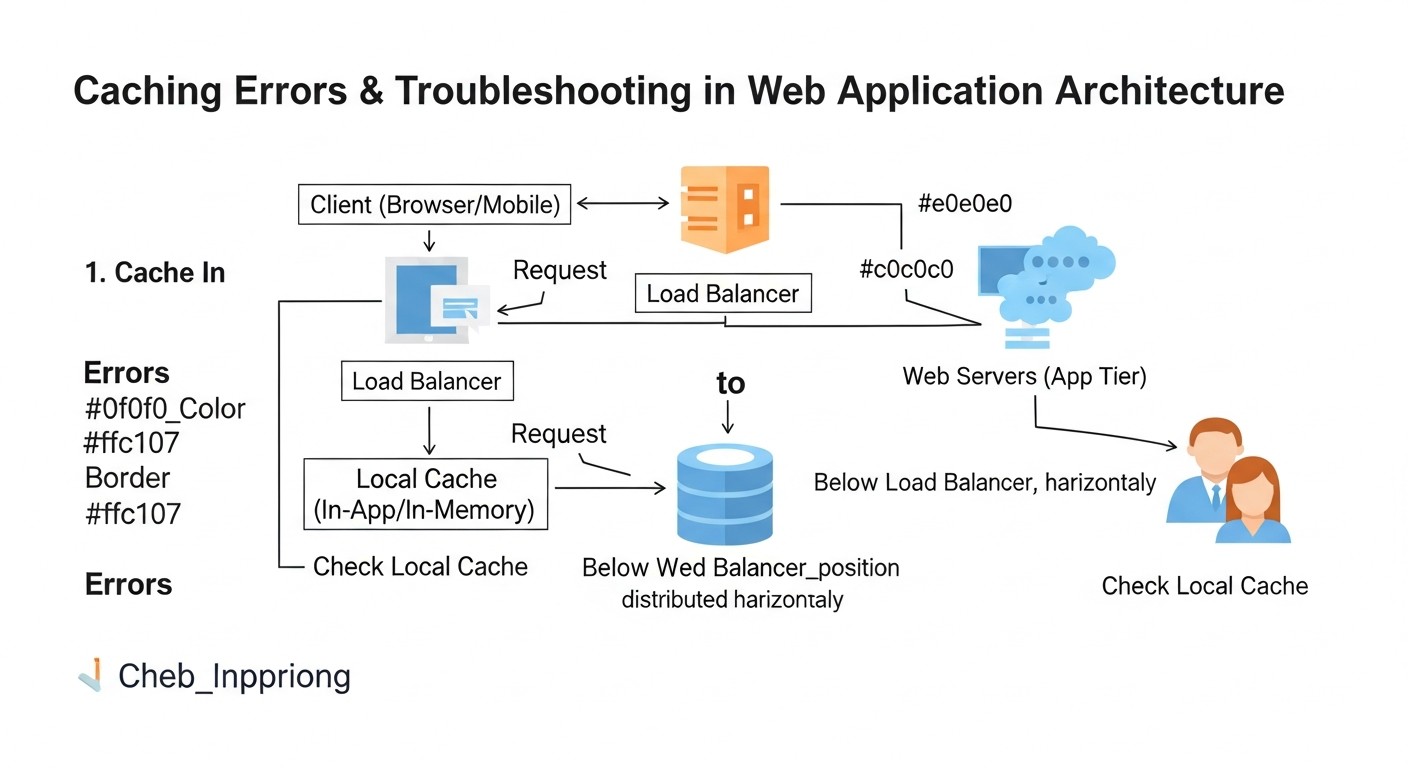

Схема: 8. Типичные ошибки при кэшировании и как их избежать

Схема: 8. Типичные ошибки при кэшировании и как их избежать

Кэширование — мощный инструмент, но его неправильное применение может привести к серьезным проблемам, от выдачи устаревших данных до снижения производительности. Вот 5 типичных ошибок и способы их предотвращения:

8.1. Кэширование персонализированного контента

Ошибка: Попытка кэшировать страницы, содержащие данные, специфичные для конкретного пользователя (например, корзина покупок, личный кабинет), без должного разделения. Это приводит к тому, что один пользователь видит данные другого.

Как избежать:

- Для Varnish: Полностью пропускайте кэширование запросов с куками сессии (

unset req.http.Cookie; return (pass); в VCL) или используйте ESI (Edge Side Includes) для кэширования только общих частей страницы. Никогда не кэшируйте заголовки Authorization.

- Для Redis: Всегда используйте уникальные ключи для персонализированных данных, включающие ID пользователя (например,

user:123:profile).

Последствия: Утечка конфиденциальных данных, нарушение приватности, некорректная работа приложения, юридические риски (особенно в контексте GDPR/CCPA).

8.2. Неэффективная или отсутствующая инвалидация кэша

Ошибка: Данные в кэше устаревают, а пользователи продолжают видеть неактуальную информацию. Либо, наоборот, кэш очищается слишком часто, что сводит на нет все преимущества кэширования.

Как избежать:

- TTL (Time To Live): Устанавливайте адекватный срок жизни для каждого объекта кэша в Redis и Varnish (

SETEX для Redis, beresp.ttl для Varnish).

- Проактивная инвалидация: При любом изменении данных в источнике (БД), отправляйте команды на очистку соответствующего кэша (

DEL для Redis, PURGE/BAN для Varnish). Интегрируйте это в ORM-хуки или сервисы, отвечающие за запись.

- Использование Pub/Sub: Для распределенных систем Redis Pub/Sub может оповещать все бэкенды о необходимости очистить локальный кэш или определенные ключи в Redis.

Последствия: Пользователи видят устаревшие данные, что приводит к недовольству, ошибкам в заказах, неправильным отчетам. Низкий Cache Hit Ratio.

8.3. Кэширование ошибок или нежелательного контента

Ошибка: Varnish или Redis кэшируют страницы с ошибками (404, 500) или перенаправления (3xx), которые затем отдаются всем пользователям.

Как избежать:

- В VCL: Явно указывайте, какие статусы HTTP можно кэшировать (

if (beresp.status == 200) { set beresp.ttl = ... }). Не кэшируйте 4xx, 5xx.

- В приложении: Убедитесь, что ваш код кэширования в Redis не сохраняет ошибочные результаты запросов к БД.

- Health Checks: Настройте

.probe в Varnish для бэкенда, чтобы Varnish знал, когда бэкенд неисправен, и мог использовать grace или отдавать ошибки без кэширования.

Последствия: Пользователи постоянно видят ошибки, даже если бэкенд уже исправлен. Снижение доверия к сервису.

8.4. Недостаточный объем памяти для кэша

Ошибка: Выделение слишком малого объема RAM для Redis или Varnish, что приводит к постоянному вытеснению данных и низкому коэффициенту попаданий в кэш.

Как избежать:

- Мониторинг: Регулярно отслеживайте метрики использования памяти (

redis-cli INFO memory, varnishstat) и Cache Hit Ratio.

- Планирование: Оцените объем данных, которые вы планируете кэшировать. Для Varnish это зависит от размера страниц и ожидаемого количества уникальных URL. Для Redis — от объема данных, которые вы хотите хранить.

- Политики вытеснения: Для Redis используйте адекватные

maxmemory-policy (например, allkeys-lru или volatile-lru).

- Апгрейд: При необходимости рассмотрите апгрейд VPS/Dedicated сервера на больший объем RAM или вынос Redis/Varnish на отдельные инстансы.

Последствия: Кэш работает неэффективно, большая часть запросов все равно идет на бэкенд/БД. Повышается нагрузка на CPU и I/O, снижается общая производительность.

8.5. Отсутствие мониторинга метрик кэширования

Ошибка: Внедрение кэширования без последующего отслеживания его эффективности и влияния на систему.

Как избежать:

- Инструменты: Используйте Prometheus/Grafana для сбора и визуализации метрик

varnishstat, redis-cli INFO, а также метрик вашего приложения (Cache Hit/Miss).

- Alerting: Настройте оповещения о критическом снижении Cache Hit Ratio, высоком потреблении памяти или ошибках в работе кэширующих систем.

- Регулярный анализ: Периодически анализируйте логи Varnish (

varnishlog) и Redis, чтобы выявить неэффективные правила кэширования или проблемные запросы.

Последствия: Невозможность оценить реальный эффект от кэширования, пропуск деградации производительности, трудности в отладке и оптимизации. Вы не знаете, работает ли ваша система кэширования так, как должна.

9. Чеклист для практического применения

Этот пошаговый алгоритм поможет вам внедрить и оптимизировать стратегии кэширования с Redis и Varnish.

- Анализ текущей производительности:

- Измерьте текущее время отклика (TTFB), пропускную способность (RPS) и утилизацию ресурсов (CPU, RAM, I/O) вашего приложения без кэширования.

- Определите самые медленные запросы и наиболее часто запрашиваемые данные/страницы.

- Используйте инструменты вроде Apache JMeter, k6 или Locust для проведения нагрузочного тестирования.

- Планирование архитектуры кэширования:

- Определите, какие данные будут кэшироваться в Redis (сессии, объекты БД, счетчики), а какие — в Varnish (HTTP-ответы, статика, публичные API).

- Спроектируйте стратегию инвалидации для каждого типа данных.

- Оцените необходимый объем RAM для Redis и Varnish.

- Подготовка сервера:

- Убедитесь, что на вашем VPS/Dedicated достаточно RAM и CPU для запуска Redis и Varnish, помимо вашего приложения и базы данных.

- Настройте фаервол (UFW, iptables) для ограничения доступа к портам Redis (6379) и Varnish (80, 6081) только с необходимых IP-адресов.

- Установка и базовая настройка Redis:

- Установите

redis-server.

- Отредактируйте

/etc/redis/redis.conf: установите maxmemory, maxmemory-policy, requirepass, bind.

- Перезапустите Redis и убедитесь, что он работает.

- Интеграция Redis в приложение:

- Установите клиентскую библиотеку Redis для вашего языка (

redis для Python, ioredis для Node.js).

- Внедрите кэширование сессий, результатов запросов к БД, счетчиков.

- Реализуйте механизмы инвалидации кэша (TTL, проактивная очистка при изменении данных).

- Установка и базовая настройка Varnish:

- Установите

varnish.

- Сконфигурируйте Varnish для прослушивания порта 80, изменив системный юнит или

/etc/default/varnish.

- Отредактируйте

/etc/varnish/default.vcl: определите бэкенд, базовые правила кэширования для vcl_recv и vcl_backend_response, обработку PURGE/BAN.

- Перезапустите Varnish.

- Настройка Nginx как SSL-терминатора перед Varnish:

- Измените конфигурацию Nginx, чтобы он слушал порт 443 (HTTPS) и проксировал трафик на Varnish (порт 80) по HTTP.

- Убедитесь, что Nginx передает правильные заголовки

X-Real-IP и X-Forwarded-For.

- Перезапустите Nginx.

- Тестирование кэширования:

- Проверьте, что Varnish кэширует страницы (заголовок

X-Cache: HIT).

- Проверьте, что Redis используется приложением (

redis-cli INFO keyspace_hits).

- Проведите нагрузочное тестирование с включенным кэшированием и сравните результаты с исходными метриками.

- Убедитесь, что инвалидация кэша работает корректно.

- Настройка мониторинга и алертинга:

- Установите Prometheus и Grafana.

- Настройте экспортеры для Redis (

redis_exporter) и Varnish (varnish_exporter).

- Создайте дашборды для отслеживания Cache Hit Ratio, использования памяти, CPU, RPS.

- Настройте оповещения на критические метрики (например, низкий Hit Ratio, переполнение памяти).

- Непрерывная оптимизация:

- Регулярно анализируйте логи Varnish (

varnishlog) и Redis.

- Оптимизируйте VCL-правила и логику кэширования в приложении на основе реальных данных.

- Рассмотрите использование ESI для более тонкого кэширования.

- Следите за обновлениями Redis и Varnish, используйте актуальные версии.

10. Расчет стоимости / Экономика кэширования

Схема: 10. Расчет стоимости / Экономика кэширования

Схема: 10. Расчет стоимости / Экономика кэширования

Внедрение Redis и Varnish на VPS/Dedicated серверах, хотя и требует начальных усилий, в долгосрочной перспективе приносит существенную экономию. К 2026 году стоимость облачных ресурсов продолжает расти, делая оптимизацию на собственных серверах еще более привлекательной. Основная идея: кэширование позволяет "выжать" больше производительности из меньшего количества или менее мощных серверов.

10.1. Прямая экономия

- Снижение потребности в CPU: Меньше запросов доходит до бэкенда и базы данных, что снижает нагрузку на CPU. Это позволяет использовать менее мощные (и дешевые) VPS или отсрочить апгрейд до следующего тарифного плана.

- Снижение потребности в RAM: Хотя Redis и Varnish сами потребляют RAM, они позволяют БД и приложению работать с меньшим количеством данных в памяти, так как многие запросы обслуживаются кэшем.

- Уменьшение I/O операций: Меньше запросов к диску (БД) означает меньшую нагрузку на дисковую подсистему, что критично для производительности и долговечности SSD.

- Снижение сетевого трафика (для внешних БД/API): Если Redis кэширует ответы от внешних сервисов или удаленной БД, снижается объем исходящего/входящего трафика, что может сократить счета за передачу данных.

10.2. Косвенная экономия и выгода

- Улучшение пользовательского опыта: Быстрый сайт = довольные пользователи = выше конверсия = больше доход.

- Улучшение SEO: Google и другие поисковики предпочитают быстрые сайты, что повышает позиции в выдаче.

- Снижение рисков простоя: Varnish с graceful degradation может отдавать старый контент даже при падении бэкенда. Redis Sentinel обеспечивает высокую доступность для данных кэша.

- Упрощение масштабирования: Бэкенд-серверы становятся "легче", их проще горизонтально масштабировать, добавляя новые инстансы.

- Снижение затрат на поддержку: Менее нагруженные серверы работают стабильнее, требуют меньше вмешательств и быстрее восстанавливаются после сбоев.

10.3. Скрытые расходы

- Время разработчиков/DevOps: Первоначальная настройка и интеграция требуют времени и экспертизы. Это самый значительный "скрытый" расход.

- Мониторинг: Внедрение и поддержка системы мониторинга (Prometheus, Grafana) тоже требует ресурсов.

- Сложность архитектуры: Добавление новых компонентов увеличивает сложность системы, что может затруднить отладку.

- "Холодный старт" кэша: После перезапуска Varnish или Redis кэш пуст, что временно повышает нагрузку на бэкенд, пока кэш не заполнится.

10.4. Примеры расчетов для разных сценариев (2026 год)

Предположим, стоимость VPS/Dedicated серверов (CPU, RAM, Disk) в 2026 году следующая:

- Базовый VPS (2 vCPU, 4 GB RAM, 80 GB SSD): $25/месяц

- Средний VPS (4 vCPU, 8 GB RAM, 160 GB SSD): $50/месяц

- Мощный VPS (8 vCPU, 16 GB RAM, 320 GB SSD): $100/месяц

- Dedicated Server (16 vCPU, 32 GB RAM, 1 TB SSD): $300/месяц

Сценарий 1: Небольшой SaaS-проект (до 1000 RPS)

Изначально: Один средний VPS ($50/мес) с Nginx + Backend + PostgreSQL. Нагрузка достигает 80% CPU.

Без кэширования:

- Производительность: ~1000 RPS

- Стоимость: $50/мес

- Риск: При росте трафика до 1200 RPS потребуется апгрейд до мощного VPS ($100/мес).

С кэшированием (Varnish + Redis на том же VPS):

- Дополнительные затраты: 1-2 дня работы DevOps (например, $500).

- Результат: Load на бэкенд снижается на 60%, CPU падает до 30%.

- Производительность: Тот же средний VPS теперь может обрабатывать до 2500 RPS.

- Стоимость: Все те же $50/мес.

- Экономия: $50/мес (отсрочка апгрейда) + улучшение UX/SEO. Окупаемость за 10 месяцев.

Сценарий 2: Средний интернет-магазин (до 5000 RPS)

Изначально: Два мощных VPS ($100/мес каждый, итого $200/мес) с балансировщиком, Nginx + Backend + PostgreSQL (на отдельном VPS). Нагрузка на бэкенды 70-85% CPU.

Без кэширования:

- Производительность: ~5000 RPS

- Стоимость: $200/мес (2x мощных VPS) + $50 (PostgreSQL VPS) = $250/мес.

- Риск: При росте трафика до 7000 RPS потребуется третий мощный VPS (+ $100/мес).

С кэшированием (Varnish на фронте, Redis на бэкендах):

- Дополнительные затраты: 3-5 дней работы DevOps (например, $1000).

- Архитектура:

- 1 мощный VPS для Varnish (может быть совмещен с Nginx).

- 2 средних VPS для бэкенда (с Redis).

- 1 средний VPS для PostgreSQL.

- Результат: Varnish кэширует 80% запросов, Redis снижает нагрузку на БД на 70%.

- Производительность: Общая система легко справляется с 10000+ RPS.

- Стоимость: $100 (Varnish) + $100 (2x средних VPS) + $50 (PostgreSQL) = $250/мес.

- Экономия: Возможно, не прямая экономия в деньгах, но значительно увеличивается запас по прочности и масштабируемость без увеличения текущих расходов. Отсрочка апгрейда на гораздо больший срок.

Таблица с примерами расчетов (упрощенно):

| Параметр |

Без кэширования |

С кэшированием (Varnish+Redis) |

Выгода/Экономия |

| Требуемое кол-во мощных VPS |

2 |

1 (для Varnish) + 2 средних (для бэкенда) |

Снижение зависимости от дорогих мощных серверов |

| Общая стоимость VPS/мес |

$200 (2x мощных) |

$200 (1x мощный + 2x средних) |

Тот же бюджет, но значительно выше RPS/запас прочности |

| Макс. RPS (примерно) |

5000 |

10000+ |

Увеличение пропускной способности в 2 раза и более |

| % CPU на бэкенде |

70-85% |

20-40% |

Значительное снижение нагрузки, больше запас |

| Окупаемость инвестиций (DevOps время) |

N/A |

3-6 месяцев (за счет отсрочки апгрейда и роста доходов) |

Быстрый возврат инвестиций в экспертизу |

Как видно из примеров, инвестиции в кэширование на VPS/Dedicated серверах оправдываются очень быстро, особенно при росте проекта. Это не просто техническая оптимизация, а стратегическое бизнес-решение.

11. Кейсы и примеры из реальной практики

Схема: 11. Кейсы и примеры из реальной практики

Схема: 11. Кейсы и примеры из реальной практики

Личный опыт и наблюдения за проектами показывают, что комбинация Redis и Varnish является одним из самых эффективных инструментов для повышения производительности и стабильности веб-приложений. Вот несколько реалистичных сценариев.

11.1. Кейс 1: Высоконагруженный новостной портал на Python/Django

Проблема: Новостной портал с миллионами просмотров в месяц, работающий на Django, испытывал серьезные проблемы с производительностью во время пиковых нагрузок (например, при выходе срочных новостей). Среднее время отклика достигало 800-1200 мс, серверы бэкенда (несколько VPS) постоянно работали на 90%+ CPU, а база данных (PostgreSQL) была перегружена запросами. Часто наблюдались 502/504 ошибки.

Решение:

- Varnish Cache на фронте: Перед каждым Nginx (который терминировал SSL) был установлен Varnish. VCL был настроен на кэширование всех новостных страниц, страниц категорий и статических файлов с TTL от 5 минут до 1 часа. Была реализована система PURGE-запросов из админки Django при публикации или обновлении новости.

- Redis для кэширования объектов Django: В Django был настроен Redis Cache Backend для кэширования результатов сложных запросов к БД (например, списка популярных новостей, комментариев, агрегированных данных), а также для хранения пользовательских сессий. TTL для этих данных варьировался от 1 до 15 минут.

- Graceful Degradation: В Varnish была настроена политика

grace, позволяющая отдавать устаревший контент из кэша, если бэкенд не отвечает, что значительно повысило отказоустойчивость во время деплоев или временных сбоев.

Результаты:

- Время отклика: Среднее время отклика для кэшированных страниц снизилось до 50-100 мс. Даже для некэшированных страниц оно сократилось до 300-400 мс за счет снижения нагрузки на БД.

- Нагрузка на CPU: Нагрузка на серверы бэкенда упала до 20-40% в обычное время и до 60-70% в пиковые моменты.

- Cache Hit Ratio: Varnish достигал 85-90% Cache Hit Ratio для страниц новостей, Redis — 70-80% для объектного кэша.

- Экономия: Отпала необходимость в срочном апгрейде серверов. Фактически, удалось отложить покупку более мощных Dedicated серверов на полтора года, сэкономив десятки тысяч долларов.

- Стабильность: Количество ошибок 5xx снизилось практически до нуля, сайт стал значительно более устойчивым к пиковым нагрузкам.

11.2. Кейс 2: SaaS-платформа для управления проектами на Node.js/Express

Проблема: SaaS-платформа, активно использующая API для взаимодействия фронтенда (React) с бэкендом (Node.js/Express). Хотя большинство данных персонализированы, некоторые API-эндпоинты (списки проектов, пользователей, справочники) имели публичную или частично публичную природу. Нагрузка на API-серверы и MongoDB была высокой, особенно при загрузке дашбордов с большим количеством виджетов.

Решение:

- Varnish для публичных и частично публичных API: Varnish был настроен перед Nginx (который терминировал SSL). В VCL были прописаны строгие правила кэширования для API-эндпоинтов, возвращающих справочные данные или списки, которые обновляются нечасто. Для авторизованных запросов Varnish пропускал их, но для публичных или кэшируемых на основе ID проекта/пользователя (с помощью ESI) он активно использовался.

- Redis для сессий и объектного кэширования: Redis использовался для хранения всех пользовательских сессий, что позволило легко масштабировать Node.js-серверы. Кроме того, в Redis кэшировались результаты сложных агрегаций из MongoDB (например, статистика по проекту за месяц), которые были дорогими для пересчета.

- Pub/Sub для инвалидации: При изменении ключевых данных (например, статуса проекта, добавления нового пользователя), Node.js-сервер публиковал событие в Redis Pub/Sub. Другие Node.js-серверы, подписанные на этот канал, получали уведомление и инвалидировали соответствующие ключи в Redis или отправляли PURGE-запросы в Varnish.

Результаты:

- Производительность API: Время ответа для кэшированных API-запросов снизилось с 200-500 мс до 10-30 мс. Общая производительность дашбордов значительно улучшилась.

- Нагрузка на MongoDB: Количество запросов к MongoDB снизилось на 40-50%, что позволило избежать дорогостоящего горизонтального масштабирования базы данных.

- Масштабируемость бэкенда: Благодаря централизованным сессиям в Redis, добавление новых Node.js-серверов стало тривиальной задачей.

- Устойчивость: Система стала более устойчивой к "флеш-мобам", когда большое количество пользователей одновременно заходило на платформу.

Эти кейсы демонстрируют, что Redis и Varnish, при правильной интеграции, могут решить широкий спектр проблем производительности и масштабируемости, обеспечивая при этом высокую доступность и экономию ресурсов.

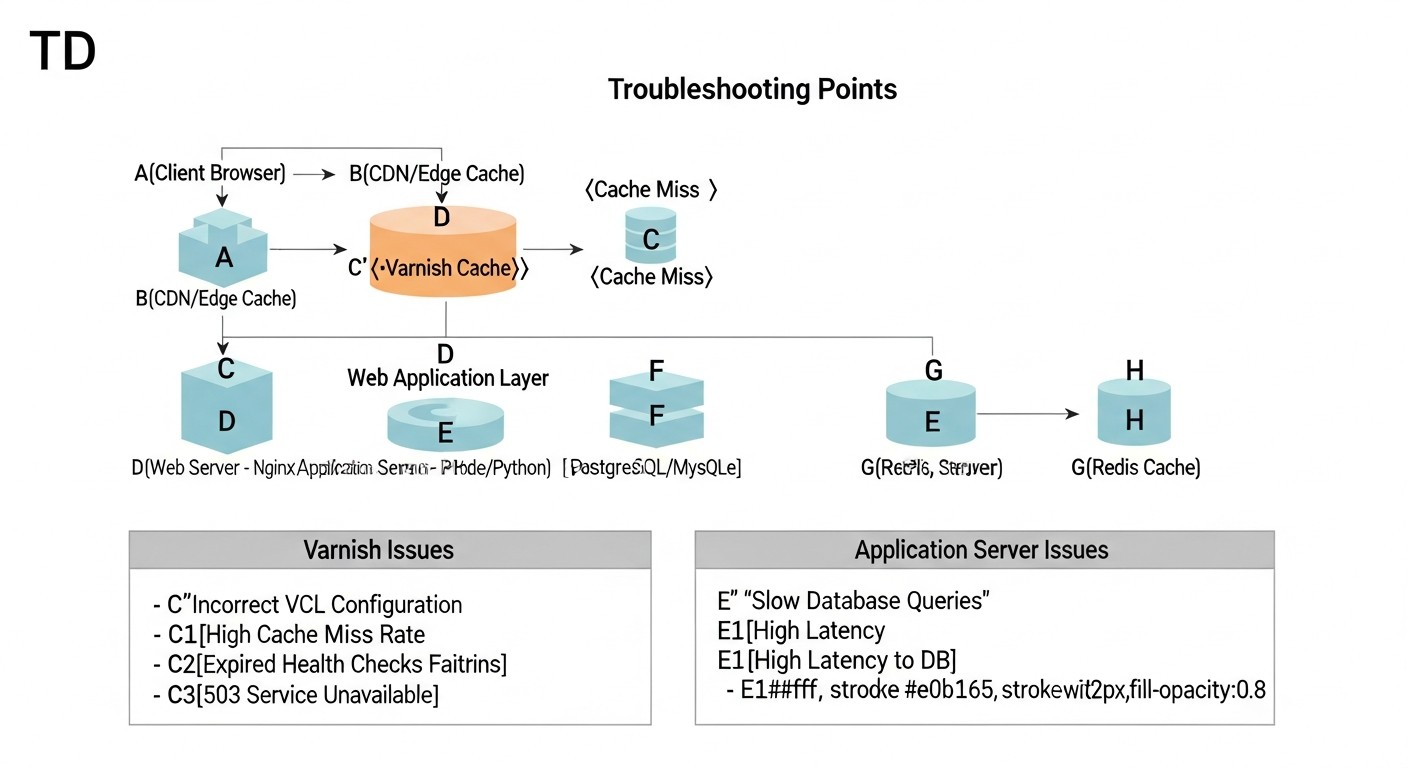

13. Troubleshooting: Решение проблем

Схема: 13. Troubleshooting: Решение проблем

Схема: 13. Troubleshooting: Решение проблем

Внедрение и поддержка систем кэширования не обходятся без проблем. Вот типичные сценарии и подходы к их решению.

13.1. Varnish не кэширует контент (Always MISS)

- Причина 1: Заголовки

Cache-Control или Set-Cookie. Ваш бэкенд может отправлять Cache-Control: private, no-cache, no-store или Set-Cookie, что по умолчанию запрещает Varnish кэшировать.

Решение:

- Проверьте заголовки ответа бэкенда с помощью

curl -I http://127.0.0.1:8000/ (где 8000 — порт вашего бэкенда).

- В VCL (

vcl_backend_response) явно удалите Set-Cookie, если он не нужен для кэшируемых страниц: unset beresp.http.Set-Cookie;.

- Переопределите

Cache-Control, если бэкенд отдает неправильные значения: set beresp.http.Cache-Control = "public, max-age=300";.

- Причина 2: Неправильные методы HTTP. Varnish по умолчанию кэширует только

GET и HEAD запросы.

Решение: Убедитесь, что вы пытаетесь кэшировать именно GET/HEAD. Для POST и других методов используйте return (pass); в vcl_recv.

- Причина 3: Проблемы с бэкендом. Varnish может не кэшировать, если бэкенд постоянно возвращает ошибки (5xx).

Решение: Проверьте логи бэкенда, убедитесь, что он стабилен и возвращает 200 OK. Настройте .probe в VCL для бэкенда.

- Причина 4: Отсутствие TTL. В VCL не установлен

beresp.ttl или он слишком мал.

Решение: В vcl_backend_response установите адекватный set beresp.ttl = 5m;.

13.2. Varnish отдает устаревший контент

- Причина 1: Некорректная инвалидация. Вы не отправляете PURGE/BAN запросы или они настроены неправильно.

Решение:

- Проверьте логи Varnish (

varnishlog) на наличие PURGE/BAN запросов и их успешное выполнение.

- Убедитесь, что IP-адрес, с которого отправляются PURGE/BAN, разрешен в VCL.

- Проверьте, что регулярные выражения в BAN запросах корректны.

- Причина 2: Слишком большой TTL. Время жизни кэша слишком велико для часто меняющегося контента.

Решение: Уменьшите beresp.ttl для этого типа контента.

13.3. Высокое потребление RAM Redis / Varnish

- Причина 1: Недостаточно

maxmemory (для Redis) или -s malloc (для Varnish). Кэш растет, а места нет, что приводит к вытеснению данных.

Решение:

- Redis: Увеличьте значение

maxmemory в redis.conf.

- Varnish: Увеличьте значение

-s malloc,2G (например, до 4G) в параметрах запуска Varnish.

- Мониторинг: Используйте

redis-cli INFO memory и varnishstat для отслеживания потребления памяти.

- Причина 2: Неэффективные политики вытеснения (для Redis).

Решение: Убедитесь, что maxmemory-policy установлен на allkeys-lru или volatile-lru для кэша.

- Причина 3: Хранение слишком больших объектов.

Решение: Пересмотрите, что вы кэшируете. Возможно, некоторые очень большие объекты не стоит кэшировать целиком.

13.4. Ошибки подключения к Redis из приложения

- Причина 1: Неправильный IP/порт/пароль.

Решение:

- Проверьте

bind и port в redis.conf.

- Убедитесь, что приложение использует правильные данные для подключения.

- Проверьте

requirepass в redis.conf и соответствующий пароль в приложении.

- Причина 2: Фаервол блокирует порт.

Решение: Проверьте правила фаервола (sudo ufw status или sudo iptables -L). Разрешите доступ к порту 6379 с IP-адреса вашего приложения.

- Причина 3: Redis не запущен.

Решение: sudo systemctl status redis-server. Если не запущен, sudo systemctl start redis-server и проверьте логи /var/log/redis/redis-server.log.

13.5. Когда обращаться в поддержку

- Проблемы с ОС: Если сервер постоянно падает, наблюдаются системные ошибки, не связанные напрямую с Redis/Varnish.

- Сетевые проблемы: Если есть подозрения на проблемы с сетевой картой или маршрутизацией на уровне хостинга.

- Непонятные сбои: Если логи Redis или Varnish указывают на внутренние ошибки, которые вы не можете интерпретировать после изучения документации.

- Лицензированные версии: Если вы используете коммерческую версию Varnish Enterprise или Redis Enterprise, смело обращайтесь к их поддержке при любых неясных проблемах.

Всегда начинайте с проверки логов (journalctl -u varnish, journalctl -u redis-server, varnishlog) и метрик (varnishstat, redis-cli INFO). В большинстве случаев это позволяет быстро локализовать и решить проблему.

14. FAQ: Часто задаваемые вопросы

14.1. Можно ли использовать только Redis или только Varnish?

Да, можно. Redis отлично подходит для кэширования данных приложения (сессии, объекты БД), а Varnish — для кэширования HTTP-ответов и статики. Однако максимальная производительность и гибкость достигаются при их совместном использовании, так как они дополняют друг друга, создавая многоуровневую систему кэширования. Redis работает ближе к приложению, Varnish — ближе к пользователю.

14.2. Как Varnish обрабатывает HTTPS-трафик?

Varnish сам по себе не умеет терминировать SSL/TLS. Для работы с HTTPS перед Varnish всегда должен стоять SSL-терминирующий прокси, такой как Nginx или HAProxy. Nginx принимает HTTPS-запрос от клиента, расшифровывает его, а затем передает обычный HTTP-запрос в Varnish. Varnish обрабатывает его и возвращает HTTP-ответ обратно в Nginx, который снова шифрует его и отправляет клиенту.

14.3. Какую политику вытеснения памяти выбрать для Redis?

Для кэша наиболее популярны политики allkeys-lru (Least Recently Used) или volatile-lru. allkeys-lru вытесняет наименее используемые ключи из всего набора, а volatile-lru — только те, у которых установлен TTL. Если Redis используется исключительно как кэш, allkeys-lru часто является хорошим выбором. Важно установить maxmemory, чтобы Redis не потреблял всю доступную RAM.

14.4. Как обеспечить высокую доступность Redis?

Для высокой доступности Redis используйте Redis Sentinel. Sentinel — это система мониторинга, которая следит за мастер-инстансом Redis и автоматически переключает на реплику в случае сбоя мастера. Для горизонтального масштабирования и шардинга используйте Redis Cluster, который распределяет данные по нескольким узлам и обеспечивает отказоустойчивость на уровне кластера.

14.5. Можно ли кэшировать API-запросы с Varnish?

Да, Varnish отлично подходит для кэширования API-запросов, особенно если они возвращают неперсонализированные данные или данные, которые меняются редко (например, справочники, публичные ленты новостей). Важно тщательно настроить VCL, чтобы не кэшировать персонализированные или чувствительные данные, и обеспечить адекватную инвалидацию кэша при изменении данных в источнике.

14.6. Как избежать "холодного старта" кэша Varnish после перезапуска?

После перезапуска Varnish его кэш пуст. Для минимизации эффекта "холодного старта" можно использовать:

- Warm-up скрипты: Скрипты, которые после перезапуска Varnish автоматически "пробегаются" по самым популярным URL, заполняя кэш.

- Graceful Restart: Varnish поддерживает "graceful restart", позволяя новому процессу заполнять кэш, пока старый продолжает обслуживать запросы.

- Persistent Varnish: Хотя Varnish по своей природе неперсистентен, существуют экспериментальные или коммерческие решения, позволяющие сохранять кэш на диск, но это добавляет сложности.

14.7. Насколько безопасно хранить сессии в Redis?

Хранить сессии в Redis безопасно при соблюдении следующих мер:

- Пароль: Всегда используйте

requirepass.

- Брандмауэр: Ограничьте доступ к порту Redis (6379) только с IP-адресов вашего приложения.

- SSL/TLS: Если Redis находится на отдельном сервере, используйте stunnel или VPN для шифрования трафика между приложением и Redis.

- Изоляция: Не используйте тот же Redis-инстанс для хранения критически важных данных и менее важных кэшей.

14.8. Могут ли Redis и Varnish быть на одном сервере с приложением и БД?

Для небольших и средних проектов на VPS это вполне распространенная и экономически выгодная практика. Однако, если проект растет, рекомендуется выносить Redis и/или Varnish на отдельные, специализированные VPS/Dedicated серверы. Это улучшает изоляцию, безопасность и упрощает масштабирование каждого компонента независимо. Главное — следить за потреблением RAM и CPU.

14.9. Как отлаживать VCL-конфигурацию?

Используйте varnishlog с фильтрами, чтобы видеть, как Varnish обрабатывает каждый запрос и почему он принимает те или иные решения (HIT/MISS/PASS). Также полезно добавлять свои отладочные сообщения в VCL с помощью std.log("My Debug Message: " + req.url);. vcl_lint поможет проверить синтаксис VCL перед загрузкой.

14.10. Какие есть альтернативы Redis и Varnish?

Для Redis: Memcached (проще, но меньше функционала), Tarantool (высокопроизводительный, с SQL и Lua-скриптами), KeyDB (форк Redis с многопоточностью).

Для Varnish: Nginx (с модулем кэширования), Apache Traffic Server, Cloudflare (CDN, но не на VPS/Dedicated), Akamai (CDN). Однако для VPS/Dedicated и максимального контроля Varnish остается одним из лучших решений для HTTP-кэширования.

15. Заключение

В условиях 2026 года, когда требования к скорости и отзывчивости веб-приложений достигают беспрецедентного уровня, эффективное кэширование перестает быть опцией и становится обязательным элементом любой высокопроизводительной инфраструктуры. Комбинация Redis и Varnish на VPS/Dedicated серверах представляет собой мощное и экономически эффективное решение, способное значительно улучшить пользовательский опыт, снизить операционные расходы и повысить общую стабильность ваших сервисов.

Мы рассмотрели, как Redis, с его многофункциональным хранилищем данных в оперативной памяти, оптимизирует работу бэкенда, кэшируя результаты запросов к базам данных, управляя сессиями и обеспечивая быстрый доступ к временным данным. В то же время Varnish Cache, выступая в роли высокопроизводительного HTTP-акселератора, снимает основную нагрузку с веб-сервера и приложения, мгновенно отдавая статический и часто запрашиваемый динамический контент.

Ключ к успеху лежит не только в установке этих инструментов, но и в их грамотной конфигурации, глубокой интеграции с приложением и, что особенно важно, в разработке продуманных стратегий инвалидации кэша. Без точной и своевременной очистки кэша все преимущества скорости могут быть нивелированы выдачей устаревших данных, что нанесет ущерб репутации и функциональности вашего сервиса.

Не менее важным аспектом является непрерывный мониторинг. Инструменты вроде Prometheus и Grafana позволяют в реальном времени отслеживать эффективность кэширования, выявлять узкие места и принимать обоснованные решения для дальнейшей оптимизации. Помните, что производительность — это не одноразовая задача, а постоянный процесс совершенствования.

Следующие шаги для читателя:

- Проведите аудит: Оцените текущую производительность вашего приложения, идентифицируйте самые медленные участки и данные, которые можно кэшировать.

- Начните с малого: Внедряйте кэширование поэтапно. Начните с Redis для сессий или Varnish для статики, затем расширяйте функционал.

- Тестируйте: Каждое изменение в конфигурации кэша должно сопровождаться нагрузочным тестированием для подтверждения положительного эффекта.

- Мониторьте: Установите и настройте систему мониторинга для отслеживания ключевых метрик кэширования.

- Изучайте: Глубокое понимание VCL для Varnish и всех возможностей Redis позволит вам создавать по-настоящему гибкие и производительные решения.

В конечном итоге, мастерское владение стратегиями кэширования с Redis и Varnish не только превратит ваше веб-приложение в молниеносный сервис, но и даст вам конкурентное преимущество на рынке 2026 года, обеспечивая стабильность и масштабируемость вашего бизнеса.