Расцвет генеративного ИИ и Stable Diffusion в 2025 году

Stable Diffusion закрепила за собой позицию преобразующей технологии в области генеративного ИИ, позволяя художникам, дизайнерам и разработчикам создавать потрясающие визуальные образы из текстовых запросов. В 2025 году ее применение значительно расширилось за пределы простой генерации изображений, охватывая все: от быстрого прототипирования в разработке игр и архитектурной визуализации до генерации разнообразных наборов данных для исследований в области машинного обучения. Однако вычислительные требования этих моделей, особенно с продвинутыми версиями, такими как SDXL 1.0 и ее преемники, требуют мощных и экономически эффективных ресурсов GPU.

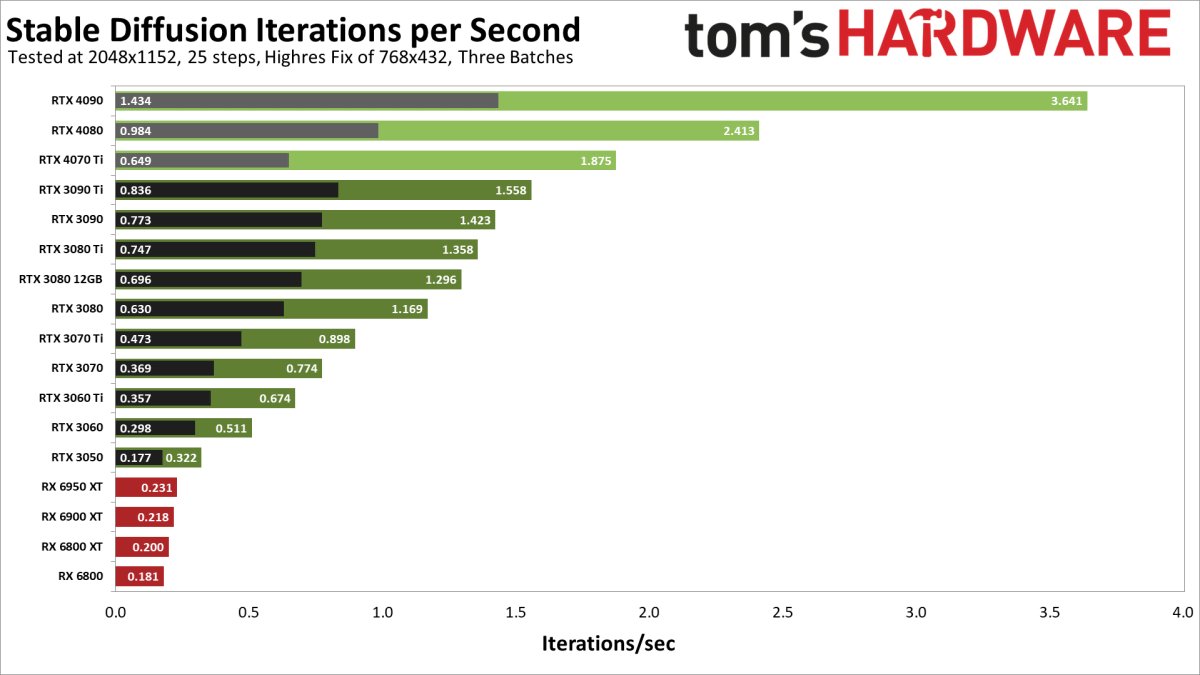

Для многих проблема заключается в навигации по сложной экосистеме облачных провайдеров GPU. С множеством вариантов, предлагающих различные GPU NVIDIA – от корпоративных H100 и A100 до чрезвычайно популярного потребительского уровня RTX 4090 – выбор оптимальной конфигурации требует детального анализа производительности и цен. Этот бенчмарк призван прояснить ситуацию, предоставляя конкретные данные для принятия решений.

Развивающийся ландшафт облачных вычислений GPU для ИИ

Рынок облачных GPU динамичнее, чем когда-либо. Движимые ненасытным спросом на вычислительные мощности ИИ, провайдеры постоянно обновляют свое оборудование, оптимизируют инфраструктуру и вводят новые модели ценообразования. В 2025 году мы наблюдаем:

- Увеличение доступности топовых GPU: Хотя H100 изначально были дефицитными, их доступность значительно улучшилась, сделав их более доступными для различных проектов.

- Конкурентное ценообразование: Конкуренция между провайдерами, такими как RunPod, Vast.ai, Lambda Labs и Vultr, привела к более агрессивному ценообразованию, особенно для спотовых инстансов и долгосрочных обязательств.

- Сложные программные стеки: Облачные среды теперь поставляются предварительно настроенными с оптимизированными драйверами, версиями CUDA и фреймворками ИИ, сокращая время настройки и максимизируя производительность.

- Фокус на масштабируемость и гибкость: Сервисы разработаны для обеспечения бесшовного масштабирования ресурсов, что критически важно для крупномасштабного обучения моделей или задач инференса с большим объемом.

Понимание этих тенденций жизненно важно, прежде чем углубляться в сравнение конкретного оборудования, поскольку экосистема провайдера может значительно повлиять на ваш общий опыт и операционные расходы.

Методология бенчмаркинга: Как мы тестировали Stable Diffusion

Для предоставления точных и применимых данных мы разработали строгую методологию тестирования, предназначенную для имитации реальных рабочих нагрузок Stable Diffusion. Нашей целью было оценить производительность различных архитектур GPU и облачных провайдеров в согласованных условиях.

Конфигурация оборудования

Мы выбрали три выдающиеся архитектуры GPU NVIDIA, представляющие различные уровни производительности и экономической эффективности:

- NVIDIA H100 (80GB HBM3): Нынешний король для рабочих нагрузок ИИ в центрах обработки данных, известный своей беспрецедентной вычислительной мощностью, большим объемом памяти и специализированными Tensor Cores для операций FP8/FP16.

- NVIDIA A100 (80GB HBM2): Высокопроизводительный предшественник H100, все еще широко доступный и предлагающий отличную производительность для большинства задач ИИ.

- NVIDIA RTX 4090 (24GB GDDR6X): Топовый потребительский GPU, известный своим невероятным соотношением цены и производительности, что делает его фаворитом для индивидуальных художников и небольших проектов.

Каждый GPU тестировался на инстансах с достаточным количеством ядер CPU (обычно 8-16 vCPU) и системной оперативной памяти (64GB+), чтобы гарантировать, что GPU не будет ограничен другими системными ресурсами.

Программный стек

Согласованность программной среды имеет первостепенное значение для справедливых сравнений. Наш стандартизированный стек включал:

- Операционная система: Ubuntu 22.04 LTS

- Версия CUDA: 12.3 (или последняя стабильная версия, поддерживаемая конкретным облачным провайдером)

- Драйверы NVIDIA: Последние проприетарные драйверы для каждого GPU (например, 545.23.08)

- Python: 3.10

- PyTorch: 2.2.0 с поддержкой CUDA

- Библиотека Hugging Face Diffusers: Последняя стабильная версия (например, 0.26.3)

- Модель Stable Diffusion: SDXL 1.0 Base и Refiner для генерации изображений 1024x1024.

- Оптимизации: xFormers (где поддерживается и включено), FlashAttention 2.0 (где применимо) и инференс с половинной точностью (FP16).

Тестовые случаи и метрики

Мы сосредоточились на распространенной и вычислительно интенсивной рабочей нагрузке Stable Diffusion:

- Задача: Генерация текста в изображение (SDXL 1.0 Base + Refiner)

- Разрешение изображения: 1024x1024 пикселей

- Шаги сэмплирования: 50 шагов

- Сэмплер: DPM++ 2M Karras

- Размер пакета: 1 (генерация одного изображения для измерения чистой пропускной способности)

- Промпт: Детальный, сложный промпт, разработанный для задействования всех аспектов модели.

- Метрика: Изображений в секунду (IPS) – рассчитывается как общее количество сгенерированных изображений, деленное на общее время, затраченное на генерацию, усредненное по 100 последовательным запускам для минимизации дисперсии.

Включенные облачные провайдеры

Наш бенчмарк включал выбор популярных облачных провайдеров GPU, известных своими сильными предложениями в области ИИ:

- RunPod: Известен своим разнообразным предложением GPU, конкурентоспособными ценами и удобным интерфейсом.

- Vast.ai: Децентрализованный рынок GPU, предлагающий высококонкурентные цены на спотовые инстансы.

- Lambda Labs: Специализируется на высокопроизводительных инстансах GPU, часто предпочитаемых для нужд выделенных серверов.

- Vultr: Облачный провайдер общего назначения с растущим присутствием в сегменте GPU, предлагающий сбалансированный подход.

Данные о ценах были собраны на момент тестирования (начало 2025 года) и представляют собой типичные почасовые тарифы по требованию, признавая, что спотовые цены (Vast.ai) или зарезервированные инстансы (Lambda Labs) могут предлагать дополнительные скидки.

Результаты бенчмарка Stable Diffusion 2025

Наши тесты выявили значительные различия в производительности и экономической эффективности между различными GPU и провайдерами. Ниже приведено краткое изложение наших выводов, сосредоточенное на критической метрике "Изображений в секунду" (IPS) для генерации SDXL 1024x1024, а также почасовой стоимости и рассчитанной стоимости за 1000 изображений.

Производительность NVIDIA H100: Непревзойденная скорость для корпоративных рабочих нагрузок

NVIDIA H100 постоянно демонстрировала самый высокий IPS, подтверждая свой статус лучшего выбора для требовательных рабочих нагрузок ИИ. Ее передовые Tensor Cores и огромная пропускная способность памяти значительно ускоряют генерацию Stable Diffusion. Хотя почасовая стоимость является самой высокой, ее чистая скорость часто приводит к конкурентоспособной стоимости за изображение для высокообъемных задач.

Производительность NVIDIA A100: Рабочая лошадка ИИ

A100 остается грозным GPU, предлагая отличную производительность по более доступной цене, чем H100. Это золотая середина для многих ML-инженеров, которым нужна значительная мощность без премиум-класса самого нового оборудования. Различия в производительности между провайдерами для A100 были минимальными, что указывает на согласованную базовую инфраструктуру.

Производительность NVIDIA RTX 4090: Чемпион по экономической эффективности

Для индивидуальных художников, небольших студий или проектов с ограниченным бюджетом RTX 4090 выделяется. Хотя ее чистый IPS ниже, чем у ее аналогов для центров обработки данных, значительно более низкая почасовая стоимость делает ее невероятно привлекательной, часто достигая самой низкой стоимости за 1000 изображений. Ее 24GB VRAM достаточно для большинства задач SDXL.

Сравнительная таблица производительности и цен

В следующей таблице приведены основные метрики для протестированных GPU и провайдеров. Все значения IPS указаны для SDXL 1.0 Base + Refiner, разрешения 1024x1024, 50 шагов, размера пакета 1.

| Тип GPU | Провайдер | IPS (SDXL 1024x1024) | Цена/час (USD) | Стоимость/1000 изображений (USD) |

|---|---|---|---|---|

| NVIDIA H100 | RunPod | 28 | $3.20 | $31.75 |

| NVIDIA H100 | Vast.ai | 27 | $2.80 | $28.81 |

| NVIDIA H100 | Lambda Labs | 29 | $3.50 | $33.52 |

| NVIDIA A100 | RunPod | 18 | $2.00 | $30.86 |

| NVIDIA A100 | Vast.ai | 17 | $1.70 | $27.78 |

| NVIDIA A100 | Vultr | 17 | $1.90 | $31.05 |

| NVIDIA RTX 4090 | RunPod | 10 | $0.70 | $19.44 |

| NVIDIA RTX 4090 | Vast.ai | 9 | $0.55 | $16.98 |

| NVIDIA RTX 4090 | Vultr | 9 | $0.65 | $20.06 |

Реальные последствия и анализ ценности

Чистые цифры рассказывают лишь часть истории, но понимание их реальных последствий является ключом к принятию наилучшего решения для вашего конкретного случая использования.

Для высокообъемного производства и корпоративных рабочих нагрузок

Если ваша основная цель — быстрая, крупномасштабная генерация изображений для коммерческих приложений, расширения наборов данных или непрерывного инференса, то NVIDIA H100 (и в меньшей степени A100) — ваш лучший выбор. Провайдеры, такие как Lambda Labs и RunPod, предлагают надежные инстансы H100, подходящие для длительных рабочих нагрузок. Хотя почасовая ставка выше, превосходный IPS минимизирует общее время генерации, что может быть критически важно для соблюдения сроков и масштабирования операций. Vast.ai может предлагать отличные цены на H100, но характер спотового рынка может привести к рискам прерывания для очень долгих, непрерывных задач.

Для прототипирования, разработки и индивидуальных художников

Для ML-инженеров, прототипирующих новые модели, специалистов по данным, экспериментирующих с различными промптами, или индивидуальных художников, создающих ИИ-искусство, NVIDIA RTX 4090 предлагает беспрецедентное соотношение цены и качества. Низкая стоимость за 1000 изображений означает, что вы можете генерировать огромное количество изображений для экспериментов, не разоряясь. Vast.ai часто предлагает самые низкие цены на RTX 4090, что делает его идеальным для пользователей с ограниченным бюджетом, готовых управлять потенциальными прерываниями. RunPod и Vultr также предоставляют стабильные инстансы RTX 4090 с хорошим временем безотказной работы.

Экономическая эффективность: IPS за доллар

Наш анализ ценности ясно показывает, что RTX 4090 на Vast.ai лидирует по чистой экономической эффективности для инференса Stable Diffusion, предоставляя изображения примерно за $16.98 за 1000. Это делает его отличным выбором для тех, кто отдает приоритет бюджету, а не абсолютной скорости. Для тех, кому нужна большая скорость, но при этом важна ценность, A100 на Vast.ai или RunPod предлагает хороший баланс. H100, будучи самым быстрым, имеет более высокую стоимость за изображение, что оправдано только тогда, когда время выполнения является критическим фактором.

Специфические особенности провайдеров

- RunPod: Предлагает отличный баланс производительности, разнообразных вариантов GPU (включая H100, A100, RTX 4090) и удобную платформу. Часто является выбором по умолчанию для надежности и простоты использования.

- Vast.ai: Непревзойденный по ценам на спотовом рынке, особенно для RTX 4090 и A100. Если вы можете терпеть потенциальные прерывания и вам комфортен более практический подход, Vast.ai обеспечивает значительную экономию средств.

- Lambda Labs: Отличается предоставлением выделенных, высокопроизводительных инстансов, особенно для A100 и H100. Идеально подходит для долгосрочных проектов, корпоративных клиентов или тех, кто требует гарантированного времени безотказной работы и специфических конфигураций.

- Vultr: Серьезный конкурент с конкурентоспособными ценами на A100 и RTX 4090. Его интегрированная облачная экосистема (хранилище, сеть) может быть полезна для проектов, требующих большего, чем просто чистые вычислительные мощности GPU.

За пределами Stable Diffusion: Другие рабочие нагрузки ИИ

Хотя этот бенчмарк был сосредоточен на Stable Diffusion, наблюдаемые здесь характеристики производительности в целом применимы к другим рабочим нагрузкам ИИ:

- Инференс LLM: GPU с большим объемом VRAM (H100, A100 80GB) критически важны для загрузки и инференса больших языковых моделей. Более высокая вычислительная мощность H100 напрямую приводит к более быстрой генерации токенов.

- Обучение и дообучение моделей: Для обучения больших фундаментальных моделей или дообучения существующих, производительность FP8/FP16 H100, огромный объем памяти и возможности NVLink делают его превосходным выбором. A100 по-прежнему очень эффективны для многих задач обучения.

- Генеративный ИИ за пределами изображений: Будь то генерация видео, создание 3D-моделей или генерация синтетических данных, применяются те же принципы балансировки мощности GPU, VRAM и стоимости.

Выбор GPU для Stable Diffusion часто является хорошим индикатором ваших потребностей в более широком спектре задач генеративного ИИ и машинного обучения.

Будущие тенденции в облачных GPU для ИИ

Заглядывая вперед, в 2025 год и далее, мы ожидаем несколько ключевых тенденций:

- Архитектуры следующего поколения: Преемники серий NVIDIA Blackwell (B100/B200) и AMD MI300 продолжат расширять границы производительности, вероятно, делая нынешние H100 более доступными.

- Улучшенные программные оптимизации: Продолжающиеся достижения во фреймворках, таких как PyTorch, JAX, и библиотеках, таких как FlashAttention, еще больше повысят эффективность всех типов GPU.

- Бессерверные функции GPU: Рост бессерверных платформ GPU предложит еще более точный контроль затрат, оплачивая только фактическое время инференса, а не почасовое время работы инстанса.

- Гибридные облачные стратегии: Многие организации будут применять гибридные подходы, используя локальные GPU для конфиденциальных данных или непрерывного обучения, и облачные GPU для пиковых нагрузок или специализированного оборудования.

Быть в курсе этих разработок будет крайне важно для поддержания конкурентного преимущества в разработке ИИ.