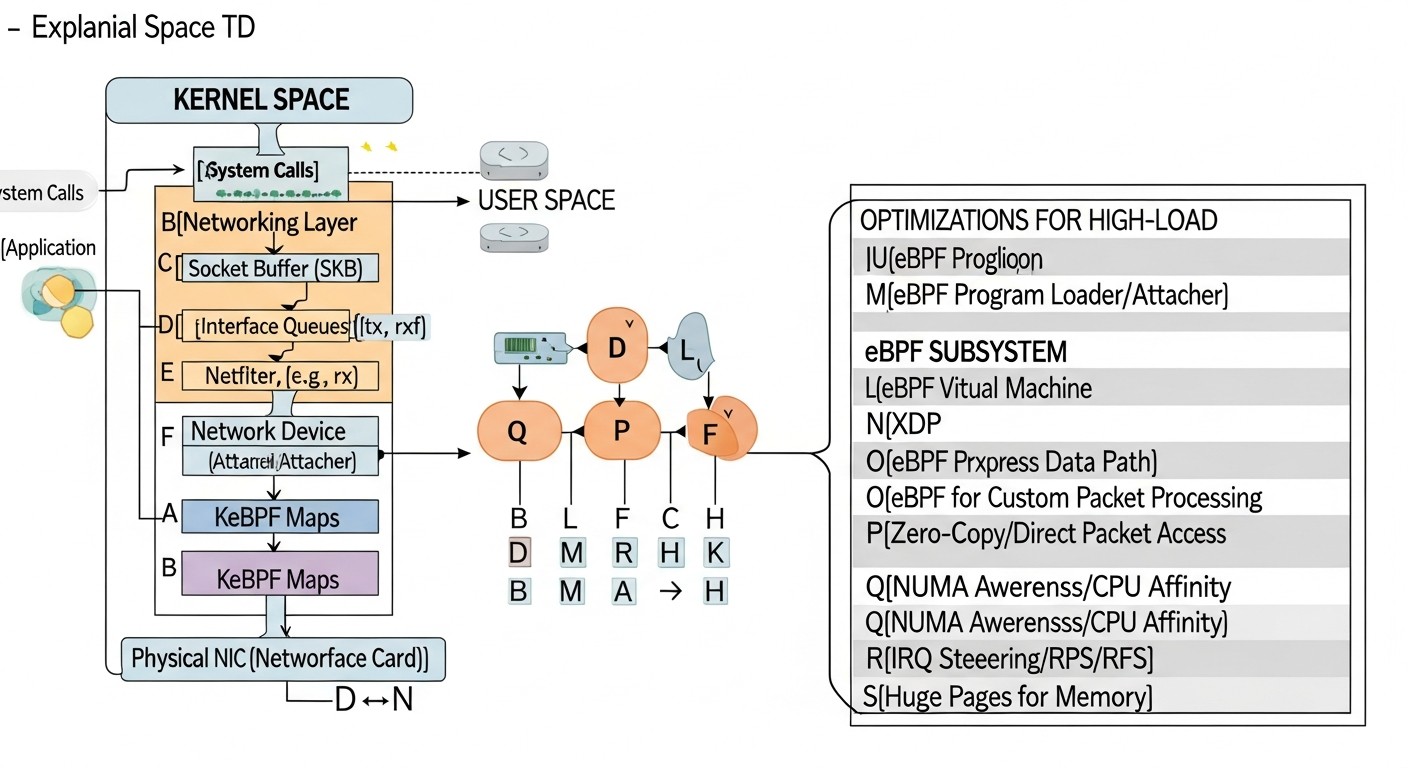

Оптимизация сетевого стека Linux для высоконагруженных приложений: от ядра до eBPF

TL;DR

- Комплексный подход: Оптимизация сетевого стека для высоконагруженных систем требует внимания ко всем уровням – от драйверов сетевых карт (NIC) и параметров ядра до пользовательских пространств и продвинутых технологий, таких как eBPF.

- Измерение – ключ к успеху: Перед внесением любых изменений необходимо установить базовые метрики производительности и постоянно мониторить влияние оптимизаций, используя такие инструменты, как

iperf3,netstat,ss,perfиbcc-tools. - Тонкая настройка ядра: Параметры

sysctl(например,net.core.somaxconn,net.ipv4.tcp_tw_reuse,net.ipv4.tcp_rmem/wmem) критически важны для управления соединениями, буферами и поведением TCP, но требуют осторожного подхода. - Использование возможностей NIC: Современные сетевые карты предлагают аппаратные разгрузки (TSO, GSO, GRO, RSS, LRO), которые значительно снижают нагрузку на CPU, и их активация через

ethtoolявляется первым шагом к повышению производительности. - eBPF как революционный инструмент: Extended Berkeley Packet Filter (eBPF) позволяет программировать сетевой стек на уровне ядра без его перекомпиляции, предоставляя беспрецедентные возможности для фильтрации пакетов (XDP), балансировки нагрузки, мониторинга и создания кастомных сетевых функций с минимальными накладными расходами.

- Важность стратегии TCP-перегрузки: Выбор алгоритма управления перегрузкой TCP (BBR, CUBIC) может существенно влиять на пропускную способность и задержку, особенно в сетях с высокой задержкой или потерями.

- Итеративный подход и тестирование: Применяйте изменения постепенно, тестируйте их под реальной нагрузкой и будьте готовы к откату. Неправильная оптимизация может привести к нестабильности или снижению производительности.

Введение

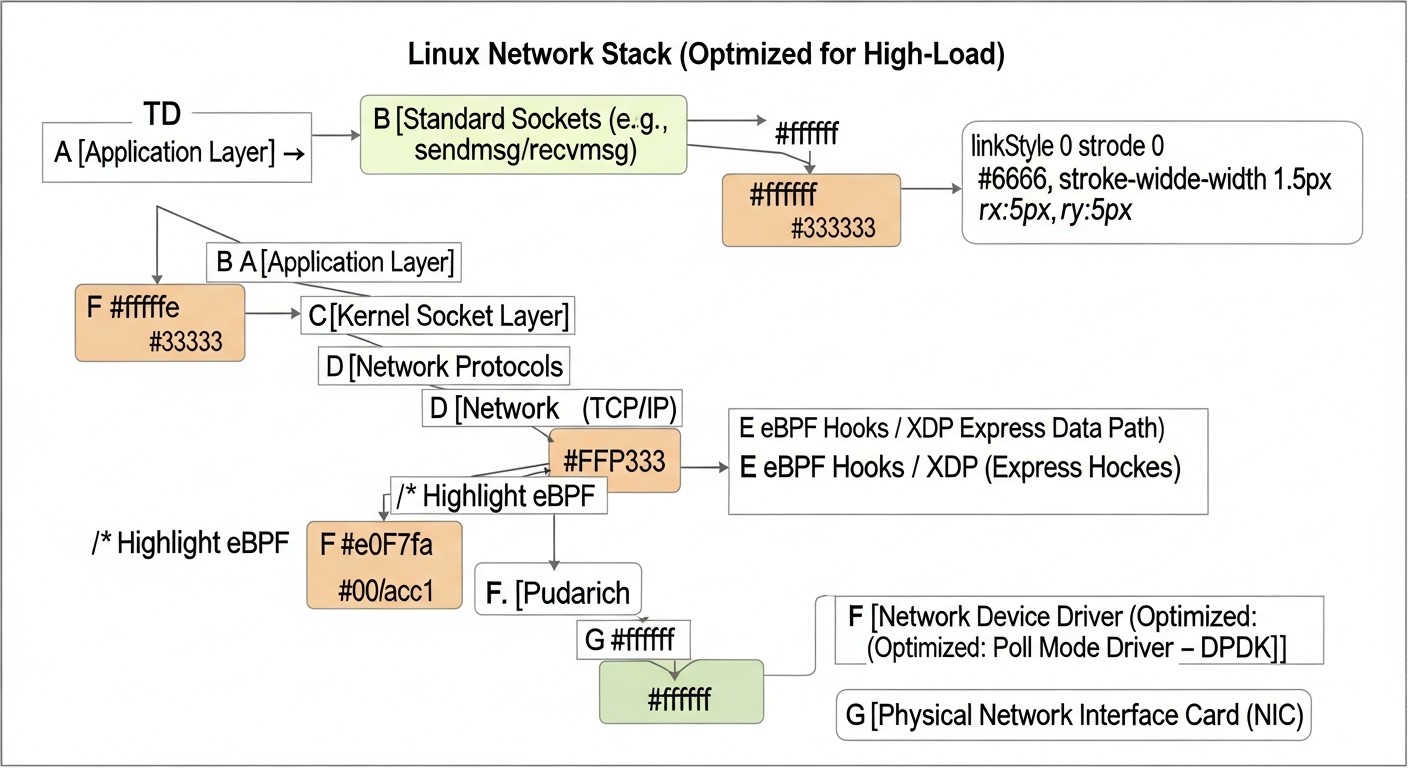

В стремительно развивающемся мире 2026 года, где доминируют облачные технологии, микросервисная архитектура, искусственный интеллект, машинное обучение и повсеместный IoT, производительность сетевого стека Linux становится не просто важным аспектом, а критическим фактором успеха для любого высоконагруженного приложения. Отзывчивость API-шлюзов, скорость обработки транзакций в финансовых системах, плавность потоковой передачи данных в реальном времени, эффективность работы баз данных и распределенных систем — все это напрямую зависит от того, насколько эффективно Linux справляется с сетевым трафиком. Стандартные настройки ядра, разработанные для широкого спектра задач, зачастую не способны обеспечить оптимальную производительность в условиях экстремальных нагрузок, характерных для современных SaaS-проектов, высокомасштабируемых бэкендов и инфраструктур DevOps.

Эта статья призвана стать исчерпывающим руководством для DevOps-инженеров, бэкенд-разработчиков, фаундеров SaaS-проектов, системных администраторов и технических директоров стартапов. Мы погрузимся в глубины сетевого стека Linux, начиная с базовых параметров ядра и аппаратных возможностей сетевых карт (NIC), и заканчивая передовыми технологиями, такими как eBPF. Цель — предоставить не просто набор команд, а глубокое понимание принципов работы, конкретные примеры, практические советы и реальные кейсы, которые позволят вам принимать обоснованные решения и достигать максимальной производительности своих систем.

Мы рассмотрим, как правильно диагностировать узкие места, какие параметры ядра Linux можно и нужно настраивать, как использовать аппаратные разгрузки сетевых карт, и как eBPF открывает новые горизонты для динамической, безопасной и высокопроизводительной манипуляции сетевым трафиком непосредственно в ядре. Ответим на вопросы, связанные с выбором стратегий управления перегрузками TCP, оптимизацией буферов, масштабированием обработки прерываний и многим другим. В 2026 году, когда каждая миллисекунда задержки и каждый процент использования CPU могут стоить реальных денег или репутации, понимание и применение этих техник является не роскошью, а необходимостью. Приготовьтесь к глубокому погружению в мир высокопроизводительных сетей Linux.

Основные критерии и факторы оптимизации

Прежде чем приступать к оптимизации, необходимо четко понимать, какие метрики и факторы определяют производительность сетевого стека и как их оценивать. Без этого любые изменения будут случайными и могут принести больше вреда, чем пользы. В 2026 году, с учетом экспоненциального роста объемов данных и требований к низкой задержке, эти критерии становятся еще более актуальными.

1. Задержка (Latency)

Задержка — это время, необходимое пакету данных для прохождения от отправителя к получателю и обратно (Round Trip Time, RTT) или в одну сторону (One-Way Latency). В контексте сетевого стека Linux, это время, которое требуется ядру для обработки входящего пакета и отправки исходящего. Высокая задержка напрямую влияет на отзывчивость приложений, особенно для интерактивных сервисов, игровых платформ, финансовых транзакций и любых систем, чувствительных ко времени отклика. Для SaaS-проектов, где важен пользовательский опыт, каждая миллисекунда задержки может приводить к потере конверсии или оттоку клиентов. Например, исследование Google показало, что увеличение задержки на 500 мс приводит к падению трафика на 20%.

- Почему важна: Влияет на UX, производительность распределенных систем, скорость транзакций.

- Как оценивать: Инструменты

ping,traceroute,hping3, а также специализированные мониторинговые системы, собирающие RTT для TCP-соединений. Важно измерять задержку не только до внешних ресурсов, но и внутри кластера, между микросервисами. - Оптимизация: Минимизация обработки пакетов в ядре, использование аппаратных разгрузок, правильная настройка буферов, XDP.

2. Пропускная способность (Throughput)

Пропускная способность — это объем данных, который может быть передан за единицу времени (например, мегабиты в секунду, Мбит/с или гигабиты в секунду, Гбит/с). Это критический фактор для приложений, работающих с большими объемами данных: стриминговые сервисы, системы резервного копирования, аналитические платформы, базы данных. В 2026 году, с появлением 400GbE и даже 800GbE сетевых карт, способность ядра эффективно обрабатывать такие потоки данных становится ключевой. Недостаточная пропускная способность может привести к "голоданию" приложений по данным, увеличению времени обработки задач и снижению общей производительности системы.

- Почему важна: Определяет скорость передачи больших объемов данных, влияет на время выполнения пакетных задач.

- Как оценивать: Инструменты

iperf3,netperf, а также метрики сетевых интерфейсов (rx_bytes_per_sec,tx_bytes_per_sec) из/proc/net/devили систем мониторинга. - Оптимизация: Увеличение буферов TCP/UDP, активация Jumbo Frames, использование TSO/GSO/GRO, правильная настройка IRQ балансировки и RSS.

3. Потери пакетов (Packet Loss)

Потери пакетов происходят, когда пакеты данных не достигают места назначения. Это может быть вызвано переполнением буферов, ошибками в сети, проблемами с аппаратным обеспечением или неправильной конфигурацией. Потери пакетов катастрофически влияют на производительность, поскольку приводят к повторной передаче данных (retransmissions), что увеличивает задержку, снижает пропускную способность и нагружает CPU. Для протоколов реального времени (VoIP, видеоконференции) потери пакетов приводят к ухудшению качества связи. В сценариях IoT или Edge Computing, где стабильность соединения критична, потери пакетов могут быть недопустимы.

- Почему важна: Приводит к повторной передаче данных, увеличивает задержку, снижает пропускную способность, нагружает CPU.

- Как оценивать: Метрики

rx_dropped,tx_droppedиз/proc/net/dev,ss -s(потери для TCP),netstat -s,tcpdumpдля анализа retransmissions. - Оптимизация: Увеличение буферов (

net.core.netdev_max_backlog,tcp_rmem/wmem), управление очередями (QoS), XDP для быстрой отбраковки нежелательного трафика.

4. Использование CPU (CPU Utilization)

Обработка сетевого трафика в Linux требует ресурсов CPU. Это включает обработку прерываний (IRQs), копирование данных между пользовательским и ядерным пространством, выполнение сетевых протоколов (TCP/IP), маршрутизацию и фильтрацию. Высокая нагрузка на CPU, особенно в контексте ksoftirqd или kworker, часто указывает на узкие места в сетевом стеке. Чрезмерное использование CPU сетью отнимает ресурсы у приложений, что снижает их производительность и общую эффективность сервера. В 2026 году, когда стоимость каждого ядра CPU в облаке продолжает расти, эффективное использование CPU становится прямым фактором экономии.

- Почему важна: Влияет на доступность CPU для приложений, общую производительность системы.

- Как оценивать: Инструменты

top,htop,perf,mpstatдля мониторинга использования CPU, особенно в режимахsoftirqиsi. - Оптимизация: Аппаратные разгрузки NIC (TSO, GSO, GRO, RSS), RPS/RFS, XDP, eBPF для смещения логики из пользовательского пространства в ядро с минимальными накладными расходами.

5. Использование памяти (Memory Usage)

Сетевой стек использует память для буферов (сокетные буферы, буферы сетевых карт), таблиц маршрутизации, ARP-кэша и других структур данных. Недостаток памяти для буферов может привести к потерям пакетов, особенно при пиковых нагрузках. Избыточное выделение памяти может быть неэффективным, но чаще всего проблемой является именно недостаток. Для высоконагруженных систем с большим количеством одновременных соединений или высокой пропускной способностью, правильная настройка буферов памяти критична для предотвращения потерь и поддержания стабильной производительности. В контейнеризированных и бессерверных средах 2026 года, где ресурсы часто ограничены, эффективное управление памятью для сетевых операций имеет первостепенное значение.

- Почему важна: Недостаток буферов приводит к потерям пакетов, избыток — к неэффективному использованию ресурсов.

- Как оценивать:

/proc/meminfo(Buffers,Cached), метрики сокетов (ss -m),vmstat. - Оптимизация: Настройка

net.core.rmem_max,net.core.wmem_max,net.ipv4.tcp_rmem,net.ipv4.tcp_wmem,net.core.netdev_max_backlog.

6. Масштабируемость (Scalability)

Масштабируемость сетевого стека означает его способность эффективно обрабатывать растущее количество соединений, пакетов или пропускной способности без деградации производительности. Это включает в себя эффективное распределение нагрузки между ядрами CPU, управление большим количеством файловых дескрипторов и оптимизацию структур данных ядра для параллельной обработки. Для современных микросервисных архитектур и распределенных систем, где количество сетевых взаимодействий может исчисляться миллионами в секунду, масштабируемость сетевого стека является основой стабильности и отзывчивости всей системы. Способность обрабатывать "взрывной" трафик и адаптироваться к изменяющимся нагрузкам — это краеугольный камень надежной инфраструктуры в 2026 году.

- Почему важна: Позволяет системе справляться с возрастающими нагрузками без деградации.

- Как оценивать: Тестирование под нагрузкой с увеличением количества клиентов/соединений, мониторинг метрик CPU, памяти и задержки при росте нагрузки.

- Оптимизация: RSS/RPS/RFS,

net.core.somaxconn,net.ipv4.tcp_max_syn_backlog,net.ipv4.ip_local_port_range, eBPF для более эффективного распределения трафика.

7. Джиттер (Jitter)

Джиттер — это вариация задержки пакетов. Даже если средняя задержка низкая, высокая вариативность может быть проблемой, особенно для приложений реального времени (VoIP, видео, онлайн-игры) или высокочастотного трейдинга. Непредсказуемые задержки могут приводить к буферизации, пропускам кадров или ошибкам синхронизации. В 2026 году, с ростом популярности интерактивных и AR/VR приложений, минимизация джиттера становится все более критичной для обеспечения бесшовного пользовательского опыта.

- Почему важна: Влияет на качество приложений реального времени, стабильность потоков данных.

- Как оценивать: Специализированные инструменты для измерения RTT с отслеживанием вариаций, анализ распределения задержек.

- Оптимизация: Приоритизация трафика (QoS), минимизация очередей, стабильность обработки прерываний, eBPF для более точного управления потоками.

8. Влияние на безопасность (Security Implications)

Любые изменения в сетевом стеке могут иметь последствия для безопасности. Например, ослабление некоторых параметров TCP для повышения производительности может сделать систему более уязвимой к SYN-флуду или другим видам атак. Активация определенных функций (например, tcp_tw_reuse без должного понимания) может привести к нежелательным последствиям. Использование eBPF, хотя и безопасно по своей природе (программы верифицируются ядром), требует внимательности при написании кода, чтобы избежать логических уязвимостей или непреднамеренных побочных эффектов. В 2026 году, когда угрозы становятся все более изощренными, безопасность должна быть неотъемлемой частью любой стратегии оптимизации.

- Почему важна: Оптимизация не должна приводить к созданию новых уязвимостей.

- Как оценивать: Аудит изменений, тестирование на проникновение, анализ векторов атак.

- Оптимизация: Внимательное изучение документации, использование проверенных практик, eBPF для реализации фаерволов и систем обнаружения вторжений на уровне ядра.

Сравнительная таблица методов оптимизации

Выбор подходящего метода оптимизации сетевого стека Linux зависит от конкретных требований приложения, аппаратной конфигурации и бюджета. В этой таблице мы сравним ключевые подходы, актуальные для 2026 года, по нескольким важным критериям. Цены и характеристики являются ориентировочными и могут варьироваться.

| Критерий | Тонкая настройка sysctl | Аппаратные разгрузки NIC | RSS/RPS/RFS | eBPF (XDP/TC) | Userspace Networking (DPDK) | TCP Congestion Control (BBR) |

|---|---|---|---|---|---|---|

| Сложность внедрения | Низкая-Средняя | Низкая-Средняя | Средняя | Высокая | Очень Высокая | Низкая |

| Потенциальный прирост производительности (2026) | 5-20% (зависит от сценария) | 10-30% снижение CPU нагрузки | До 20% увеличение PPS | До 70% снижение CPU для L3/L4, 10-30% общая | 100-300% увеличение PPS (обход ядра) | 10-50% увеличение пропускной способности на WAN |

| Влияние на CPU | Снижает/перераспределяет | Значительно снижает | Перераспределяет, снижает softirq | Значительно снижает (особенно XDP) | Полностью обходит CPU ядра | Минимальное |

| Влияние на задержку | Может снизить | Снижает | Снижает | Значительно снижает (XDP) | Значительно снижает | Может снизить (BBR) |

| Требования к оборудованию | Стандартный Linux сервер | Современная NIC с поддержкой offload | Многоядерный CPU | Ядро Linux 4.x+ (лучше 5.x+), современный CPU | Специализированная NIC, многоядерный CPU, поддержка IOMMU | Стандартный Linux сервер |

| Типичные сценарии использования | Веб-серверы, базы данных, прокси | Любые высоконагруженные сетевые приложения | Высокопроизводительные сетевые шлюзы, балансировщики | DDoS-защита, кастомные фаерволы, балансировщики, мониторинг, телеметрия | Телеком, HFT, NFV, высокоскоростная пакетная обработка | WAN-оптимизация, облачные среды, CDN |

| Примерная стоимость внедрения (Dev Time) | Низкая (часы) | Низкая (часы) | Средняя (дни) | Высокая (недели/месяцы) | Очень высокая (месяцы) | Низкая (минуты) |

| Риски/Побочные эффекты | Неправильная настройка может ухудшить | Конфликты с драйверами, несовместимость | Неправильная настройка может вызвать дисбаланс | Сложность отладки, риск нестабильности при ошибках | Полный обход ядра, требует специализированных приложений | Может быть агрессивным в некоторых сетях |

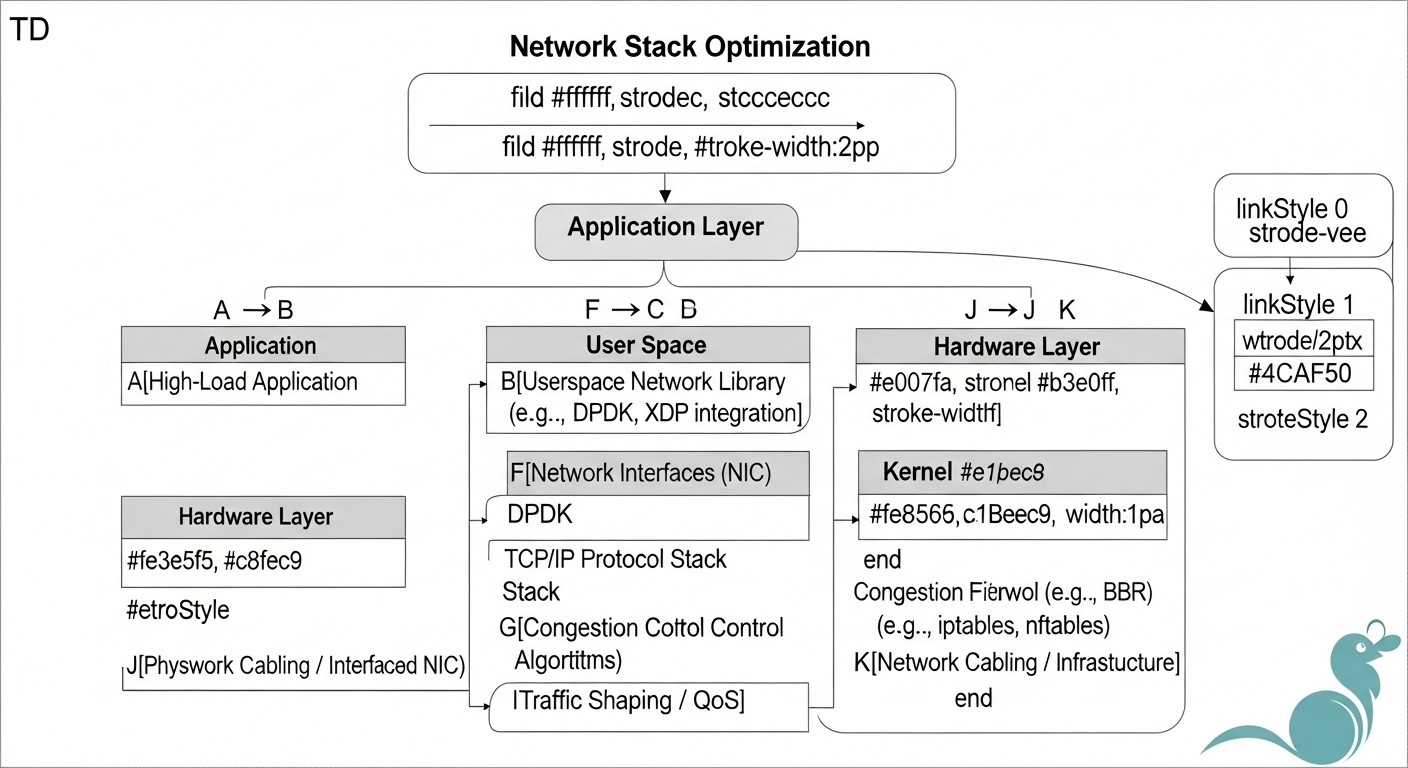

Детальный обзор каждого пункта/варианта

Каждый метод оптимизации сетевого стека Linux имеет свои особенности, преимущества и недостатки. Понимание этих нюансов позволяет выбрать наиболее подходящие инструменты для конкретной задачи и достичь максимальной эффективности.

1. Тонкая настройка параметров ядра (sysctl)

Параметры ядра Linux, доступные через интерфейс sysctl, являются первым и наиболее доступным уровнем оптимизации. Они позволяют настроить поведение сетевого стека, управляя размерами буферов, таймаутами, механизмами управления перегрузками и другими аспектами. Несмотря на кажущуюся простоту, их настройка требует глубокого понимания, поскольку неверные значения могут привести к деградации производительности или даже к нестабильности системы. В 2026 году, когда большинство систем работают в контейнерах или виртуальных машинах, эти параметры остаются актуальными, хотя некоторые из них могут быть ограничены средой.

net.core.somaxconn: Определяет максимальное количество соединений, которые могут находиться в состоянии LISTEN-backlog. Для высоконагруженных веб-серверов или балансировщиков нагрузки, обрабатывающих тысячи новых соединений в секунду, значение по умолчанию (обычно 128) часто недостаточно. Его увеличение до 4096 или даже 65535 может значительно снизить количество сброшенных соединений (connection refused) под пиковой нагрузкой. Например, для API-шлюза, принимающего 10 000 RPS, увеличениеsomaxconnс 128 до 8192 может предотвратить до 5% ошибок соединения в пиковые моменты, улучшая пользовательский опыт и стабильность сервиса.net.ipv4.tcp_tw_reuseиnet.ipv4.tcp_fin_timeout:tcp_tw_reuseпозволяет повторно использовать сокеты в состоянииTIME_WAITдля новых исходящих соединений. Это критически важно для клиентов, которые быстро открывают и закрывают множество соединений. В сочетании сtcp_fin_timeout(уменьшение времени нахождения в состоянииFIN_WAIT2), это помогает предотвратить исчерпание портов и снижает нагрузку на систему при интенсивном создании/закрытии соединений. Однакоtcp_tw_reuseследует использовать с осторожностью на серверах, поскольку это может привести к проблемам при взаимодействии с некоторыми NAT-устройствами, отправляющими пакеты с устаревшими номерами последовательности. Для исходящих прокси или микросервисов, инициирующих множество запросов, активацияtcp_tw_reuseможет сократить количество портов в состоянииTIME_WAITна 30-50%, высвобождая ресурсы.net.core.rmem_max/net.core.wmem_maxиnet.ipv4.tcp_rmem/net.ipv4.tcp_wmem: Эти параметры контролируют максимальные размеры буферов получения и отправки для всех сокетов (net.core.) и для TCP-сокетов (net.ipv4.tcp_). Увеличение этих значений позволяет TCP-окнам быть больше, что особенно важно для высокоскоростных сетей с большой задержкой (High-Bandwidth Delay Product, BDP). Для серверов, передающих большие файлы или работающих с высокоскоростными базами данных, увеличение буферов до 16MB (16777216) или даже 32MB может значительно повысить пропускную способность, снижая количество повторных передач и улучшая эффективность использования канала. Например, на канале 10 Гбит/с с RTT 50 мс, оптимальный размер буфера составляет около 625 КБ. Если буфер меньше, канал будет недоиспользован.net.ipv4.tcp_max_syn_backlog: Максимальное количество TCP-соединений, для которых получены пакеты SYN, но еще не завершен трехсторонний рукопожатие. Увеличение этого значения (например, до 8192 или 16384) помогает защититься от SYN-флуда и предотвращает потерю соединений при высокой нагрузке на установление соединений.net.ipv4.tcp_timestamps: Включение временных меток TCP (RFC 1323) помогает ядру более точно измерять RTT и защищает от устаревших сегментов, но добавляет 12 байт к каждому TCP-заголовку. Для высокоскоростных LAN с очень большим количеством маленьких пакетов это может быть накладным. В большинстве случаев для WAN его стоит оставить включенным.

Плюсы: Легкость применения, не требует изменения кода приложения, универсальность.

Минусы: Требует перезагрузки для некоторых параметров, может привести к нестабильности при неправильной настройке, не решает фундаментальных проблем производительности на очень высоких нагрузках.

Для кого подходит: Большинство серверов, где требуется общая оптимизация производительности сети без глубоких изменений архитектуры.

Примеры: Увеличение somaxconn для веб-серверов, настройка буферов для файловых серверов, оптимизация tcp_tw_reuse для клиентских приложений или прокси.

2. Аппаратные разгрузки сетевых карт (NIC Offloads)

Современные сетевые карты (NIC) — это не просто трансиверы, а мощные сопроцессоры, способные выполнять часть сетевой обработки, которая традиционно ложится на CPU ядра. Использование этих аппаратных разгрузок (offloads) позволяет значительно снизить нагрузку на центральный процессор, высвобождая его для выполнения прикладных задач, и тем самым повысить общую производительность системы. В 2026 году, с повсеместным распространением 10/25/40/100GbE NIC, активация этих функций является обязательным первым шагом.

- TSO (TCP Segmentation Offload) / GSO (Generic Segmentation Offload): Позволяют ядру отправлять очень большие TCP-сегменты (до 64 КБ) драйверу NIC, который затем самостоятельно делит их на пакеты, соответствующие MTU сети. Это значительно снижает количество операций, выполняемых CPU, так как ядро обрабатывает меньше пакетов, но больше данных за один раз. Особенно полезно для высокоскоростной передачи больших файлов.

- GRO (Generic Receive Offload) / LRO (Large Receive Offload): Обратная сторона TSO/GSO. NIC или драйвер объединяет несколько входящих пакетов в один большой сегмент перед передачей его ядру. Это уменьшает количество прерываний и количество пакетов, которые ядро должно обрабатывать, тем самым снижая нагрузку на CPU. GRO является более универсальной версией LRO и предпочтительна.

- RSS (Receive Side Scaling): Позволяет распределять обработку входящих сетевых прерываний и пакетов между несколькими ядрами CPU. NIC использует хеш-функцию для определения, какое ядро должно обрабатывать конкретный пакет, тем самым предотвращая перегрузку одного ядра и повышая общую пропускную способность. Для многоядерных систем с высокоскоростными NIC это критически важно. Например, 100GbE NIC без RSS может привести к тому, что одно ядро CPU будет полностью загружено обработкой сетевого трафика, в то время как остальные простаивают.

- RPS (Receive Packet Steering) / RFS (Receive Flow Steering): Программные реализации RSS, когда NIC не поддерживает аппаратный RSS или когда требуется более тонкое управление. RPS распределяет пакеты между ядрами CPU после того, как они были приняты NIC. RFS дополнительно пытается направить пакеты на то ядро, где работает приложение, которое будет их обрабатывать, улучшая кэш-эффективность.

- SR-IOV (Single Root I/O Virtualization): Технология виртуализации, которая позволяет виртуальным машинам напрямую получать доступ к аппаратным функциям NIC, минуя гипервизор. Это обеспечивает почти нативную производительность сети для ВМ, значительно снижая задержку и увеличивая пропускную способность. Критически важно для NFV (Network Function Virtualization) и высокопроизводительных облачных инстансов.

Плюсы: Значительное снижение нагрузки на CPU, увеличение пропускной способности и уменьшение задержки, не требует изменения кода приложения.

Минусы: Зависит от аппаратной поддержки NIC и драйверов, может быть сложным в настройке (особенно SR-IOV), иногда может вызывать проблемы с совместимостью или отладкой.

Для кого подходит: Любые высоконагруженные серверы, особенно с 10GbE+ NIC, виртуализированные среды.

Примеры: Активация TSO/GSO/GRO для файловых серверов, настройка RSS для балансировщиков нагрузки, использование SR-IOV для виртуальных сетевых функций.

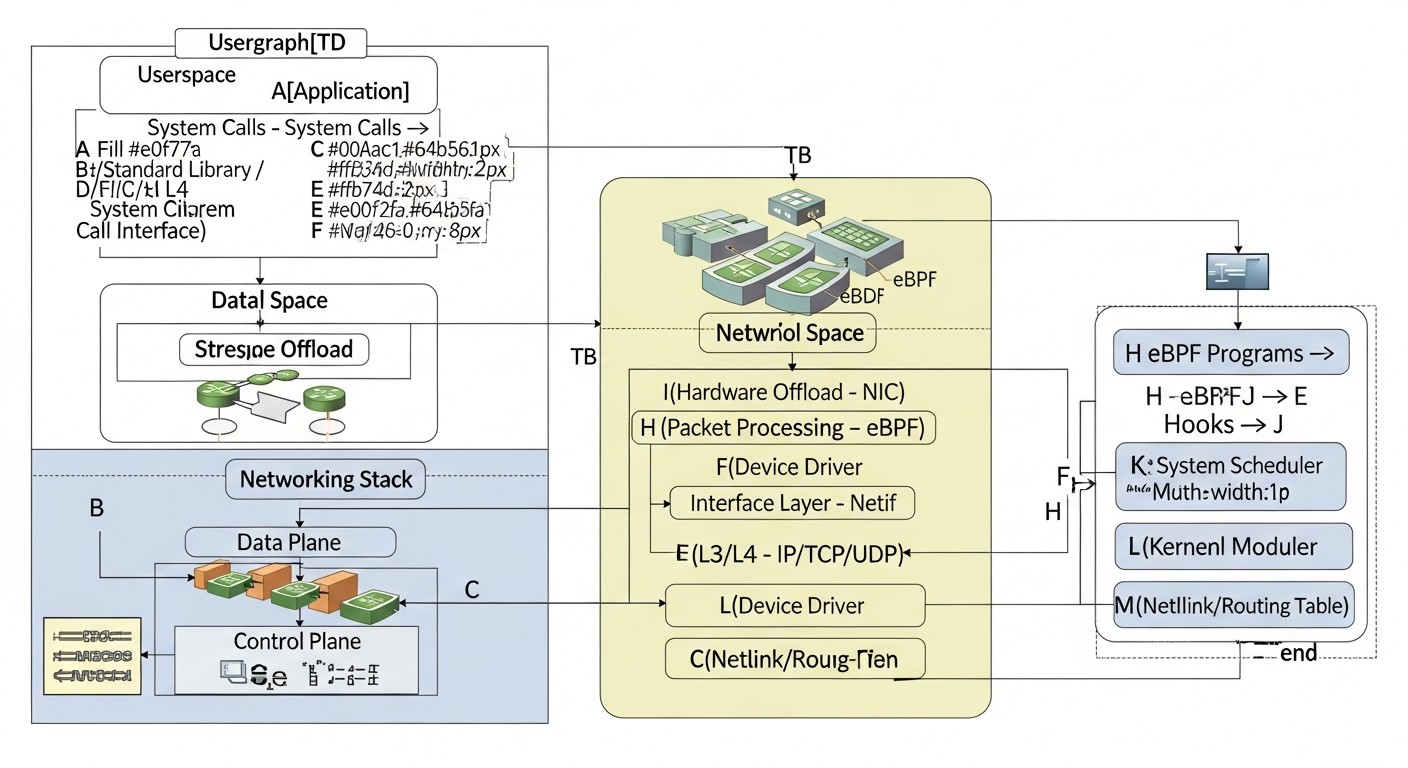

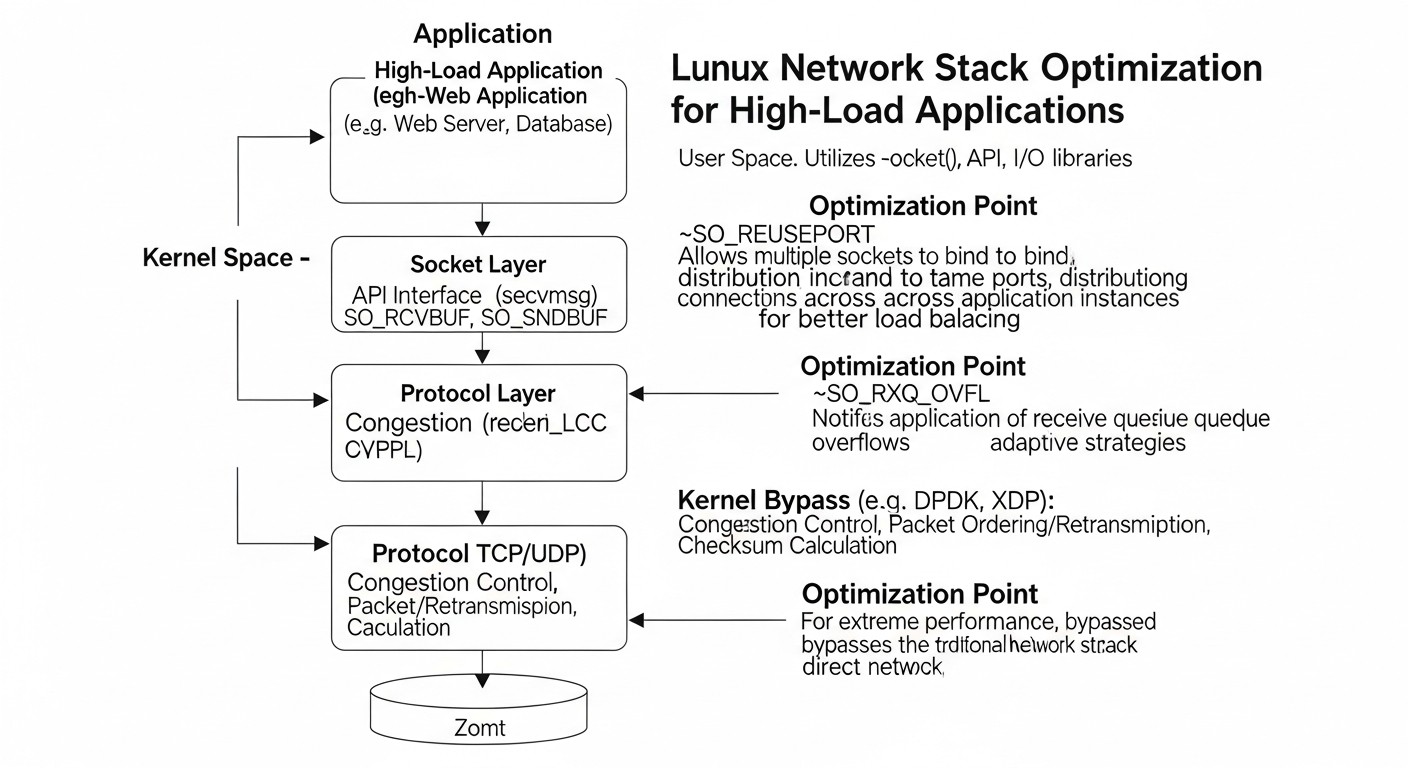

3. eBPF (Extended Berkeley Packet Filter)

eBPF — это революционная технология, которая позволяет выполнять программы на уровне ядра Linux без необходимости его перекомпиляции или загрузки модулей. Эти программы, написанные на ограниченном подмножестве C и скомпилированные в байткод, верифицируются ядром на безопасность и затем запускаются в изолированной песочнице. eBPF предоставляет беспрецедентные возможности для мониторинга, трассировки, безопасности и, что особенно важно для нас, для высокопроизводительной сетевой обработки. В 2026 году eBPF является одним из самых мощных инструментов для оптимизации сетевого стека, позволяя реализовывать логику, которая ранее была возможна только в пользовательском пространстве или требовала модификации ядра.

- XDP (eXpress Data Path): Самый быстрый путь обработки пакетов в Linux. XDP-программы запускаются непосредственно в драйвере сетевой карты, до того как пакет попадает в обычный сетевой стек. Это позволяет выполнять такие операции, как фильтрация DDoS-трафика, балансировка нагрузки, быстрая маршрутизация или перенаправление пакетов с минимальной задержкой и нагрузкой на CPU. XDP позволяет отбросить нежелательный трафик или перенаправить его на другие интерфейсы/CPU до того, как он будет полностью обработан ядром. В реальных кейсах XDP может обрабатывать миллионы пакетов в секунду на одном ядре CPU, снижая нагрузку на CPU на 50-70% по сравнению с традиционными методами для определенных задач.

- TC eBPF (Traffic Control eBPF): Программы eBPF, прикрепляемые к точкам входа в подсистеме управления трафиком Linux. Они позволяют реализовывать более сложные политики фильтрации, классификации и модификации пакетов, чем XDP, но с немного большей задержкой, поскольку они работают глубже в стеке. TC eBPF используется для создания продвинутых фаерволов, QoS-политик, сетевых функций, таких как проксирование или туннелирование, и даже для реализации части SDN-контроллеров.

- Socket Filters: eBPF-программы, прикрепляемые к сокетам. Они позволяют фильтровать входящие пакеты до того, как они будут доставлены приложению. Это может быть использовано для реализации кастомных протоколов, оптимизации обработки специфического трафика или для более тонкой безопасности на уровне приложения.

- Cilium, Calico и другие: В 2026 году eBPF активно используется в облачных и контейнерных средах для реализации сетевых политик, балансировки нагрузки и обеспечения безопасности. Проекты вроде Cilium полностью перестроены на eBPF, предоставляя высокопроизводительную и безопасную сеть для Kubernetes.

Плюсы: Беспрецедентная производительность и гибкость, выполнение кода на уровне ядра без его модификации, безопасность (верификатор ядра), мощные возможности для мониторинга и отладки, активное развитие сообществом.

Минусы: Высокий порог входа (требует знаний C, специфического API eBPF), сложность отладки, не все драйверы NIC поддерживают XDP, программы ограничены по размеру и сложности.

Для кого подходит: DevOps-инженеры и разработчики, работающие с экстремально высокими нагрузками, требующие кастомной логики обработки пакетов, DDoS-защиты, высокопроизводительной балансировки нагрузки, продвинутого мониторинга.

Примеры: XDP для отбрасывания DDoS-трафика, TC eBPF для создания кастомных балансировщиков L4, eBPF для глубокой телеметрии сетевого трафика.

4. Пользовательское пространство (Userspace Networking - DPDK)

Для самых экстремальных нагрузок, когда даже XDP недостаточно, существуют решения, полностью обходящие сетевой стек ядра и обрабатывающие пакеты непосредственно в пользовательском пространстве. Самым известным из них является DPDK (Data Plane Development Kit). DPDK предоставляет набор библиотек и драйверов, которые позволяют приложениям напрямую взаимодействовать с сетевой картой, минуя ядро Linux. Это достигается за счет использования режима "poll mode driver" (PMD), где CPU постоянно опрашивает NIC на предмет новых пакетов, избегая накладных расходов на прерывания. DPDK требует выделения ядер CPU и больших страниц памяти, но взамен предлагает производительность, измеряемую десятками миллионов пакетов в секунду (Mpps) на одном ядре.

- Принцип работы: DPDK-приложения получают эксклюзивный доступ к NIC. Драйверы DPDK работают в пользовательском пространстве и постоянно опрашивают очереди NIC на наличие пакетов. Это устраняет переключения контекста, копирование данных между ядром и пользовательским пространством, а также обработку прерываний, которые являются основными источниками накладных расходов в традиционном сетевом стеке.

- Применение: Используется в телекоммуникационной индустрии (NFV), высокочастотном трейдинге (HFT), специализированных маршрутизаторах, фаерволах, IDS/IPS системах, где требуется максимальная пропускная способность и минимальная задержка.

Плюсы: Максимальная производительность (десятки Mpps), минимальная задержка, полный контроль над обработкой пакетов.

Минусы: Крайне высокая сложность разработки и внедрения (требует переписывания или адаптации приложений), полный обход сетевого стека ядра (теряются стандартные функции Linux), требует выделенных ядер CPU и специфичной конфигурации, нет стандартных утилит.

Для кого подходит: Только для самых требовательных сценариев, где стандартный сетевой стек (даже с eBPF) не справляется, и есть ресурсы для глубокой разработки.

Примеры: Коммерческие NFV-решения (виртуальные маршрутизаторы, фаерволы), HFT-платформы, специализированные сетевые устройства.

5. Алгоритмы управления перегрузками TCP

Алгоритм управления перегрузками TCP определяет, как TCP-соединение реагирует на перегрузку сети, контролируя размер окна перегрузки. Выбор правильного алгоритма может существенно повлиять на пропускную способность, задержку и справедливость распределения полосы пропускания. В 2026 году, когда сети становятся все более разнообразными (от высокоскоростных дата-центров до спутниковых каналов), выбор алгоритма имеет большое значение.

- CUBIC: Алгоритм по умолчанию в большинстве современных ядер Linux. Хорошо работает в высокоскоростных сетях с высокой задержкой, но может быть менее агрессивным и медленнее реагировать на изменения, чем некоторые другие алгоритмы.

- BBR (Bottleneck Bandwidth and RTT): Разработан Google, BBR фокусируется на измерении пропускной способности "бутылочного горлышка" и минимальной задержки RTT для определения оптимального окна перегрузки. В отличие от CUBIC, который реагирует на потери пакетов (что часто является поздним индикатором перегрузки), BBR активно ищет свободную полосу пропускания, что часто приводит к значительному увеличению пропускной способности и снижению задержки, особенно на каналах с высокой задержкой и/или потерями. Для облачных сред, межрегиональных соединений и CDN BBR часто демонстрирует превосходные результаты. Его использование может увеличить пропускную способность на 10-50% и снизить задержку на 5-10% в определенных сценариях.

- Reno/NewReno: Более старые алгоритмы, которые по-прежнему используются, но обычно уступают CUBIC и BBR в современных высокоскоростных сетях.

Плюсы: Легко настраивается (sysctl), значительный прирост производительности для BBR в WAN-сетях.

Минусы: BBR может быть слишком агрессивным в некоторых сетях, что может привести к вытеснению трафика, использующего другие алгоритмы.

Для кого подходит: Все серверы, особенно те, которые взаимодействуют через WAN или облачные сети. BBR рекомендуется для большинства сценариев.

Примеры: Активация BBR для веб-серверов, CDN-нод, файловых серверов, работающих через интернет.

6. Балансировка прерываний (IRQ Balancing)

Сетевые карты генерируют прерывания (IRQs) для каждого принятого или отправленного пакета. На высокоскоростных NIC количество прерываний может быть огромным, что приводит к значительной нагрузке на CPU, если все они обрабатываются одним ядром. Балансировка прерываний распределяет эти IRQs между несколькими ядрами CPU, что позволяет параллельно обрабатывать сетевой трафик и предотвращать перегрузку отдельных ядер.

irqbalance: Демон, который автоматически распределяет IRQs между доступными ядрами CPU. Это простое решение для большинства систем.- Ручная настройка

/proc/irq/<IRQ_NUMBER>/smp_affinity: Для максимальной производительности и предсказуемости, особенно в выделенных системах, можно вручную привязать IRQs сетевых карт к определенным ядрам CPU. Это позволяет избежать конкуренции с другими процессами и оптимизировать кэш-эффективность. Например, для 100GbE NIC с 16 очередями, можно привязать каждую очередь к отдельному ядру CPU, обеспечивая максимальное распараллеливание.

Плюсы: Снижает нагрузку на CPU, улучшает масштабируемость и пропускную способность.

Минусы: Ручная настройка может быть сложной, требует понимания топологии NUMA.

Для кого подходит: Любые многоядерные серверы с высокоскоростными NIC, особенно сетевые шлюзы и балансировщики нагрузки.

Примеры: Настройка irqbalance на стандартных серверах, ручная привязка IRQs для высокопроизводительных сетевых устройств.

Практические советы и рекомендации

Применение теоретических знаний на практике требует конкретных шагов и команд. Ниже представлены пошаговые инструкции и примеры конфигураций, которые помогут вам оптимизировать сетевой стек Linux в реальных условиях 2026 года.

1. Установка базовых метрик и мониторинг

Прежде чем что-либо менять, измерьте текущую производительность. Это позволит вам оценить эффект от внесенных изменений.

- Использование

iperf3для измерения пропускной способности:

# На сервере (принимающая сторона)

iperf3 -s

# На клиенте (отправляющая сторона)

iperf3 -c <server_ip> -t 60 -P 10 # 60 секунд, 10 параллельных потоков

# Общая статистика сетевых интерфейсов

ip -s link show eth0

# Статистика TCP/UDP сокетов

ss -s

# Детальная статистика по сетевым протоколам

netstat -s

# Мониторинг использования CPU, особенно softirq

mpstat -P ALL 1

# Проверка дропов пакетов в драйвере NIC

ethtool -S eth0 | grep "drop"

2. Настройка параметров ядра (sysctl)

Изменения через sysctl применяются немедленно, но не сохраняются после перезагрузки. Для постоянства их нужно добавить в /etc/sysctl.conf или в файлы в /etc/sysctl.d/.

- Пример конфигурации

/etc/sysctl.d/99-network-optimizations.conf:

# Увеличиваем backlog для LISTEN-сокетов

net.core.somaxconn = 65535

net.ipv4.tcp_max_syn_backlog = 16384

# Увеличиваем размеры буферов для всех сокетов

net.core.rmem_max = 33554432

net.core.wmem_max = 33554432

net.core.rmem_default = 16777216

net.core.wmem_default = 16777216

# Увеличиваем размеры буферов для TCP-сокетов

# Формат: min default max

net.ipv4.tcp_rmem = 4096 87380 33554432

net.ipv4.tcp_wmem = 4096 65536 33554432

# Разрешаем переиспользование сокетов в состоянии TIME_WAIT

net.ipv4.tcp_tw_reuse = 1

# Уменьшаем таймаут для FIN-WAIT2

net.ipv4.tcp_fin_timeout = 30

# Используем алгоритм управления перегрузками BBR

net.ipv4.tcp_congestion_control = bbr

# Увеличиваем максимальное количество портов для исходящих соединений

net.ipv4.ip_local_port_range = 1024 65535

# Отключаем SACK (Selective Acknowledgement) - может быть полезно в некоторых случаях, но чаще лучше оставить включенным

# net.ipv4.tcp_sack = 0

# Отключаем TCP Slow Start после простоя (может быть полезно для коротких соединений)

net.ipv4.tcp_slow_start_after_idle = 0

# Увеличиваем очередь входящих пакетов на уровне драйвера

net.core.netdev_max_backlog = 16384

sudo sysctl -p /etc/sysctl.d/99-network-optimizations.conf

3. Настройка аппаратных разгрузок NIC

Используйте ethtool для проверки и настройки возможностей вашей сетевой карты. Замените eth0 на имя вашего интерфейса.

- Проверка текущих возможностей:

sudo ethtool -k eth0

sudo ethtool -K eth0 rx on tx on sg on tso on gso on gro on lro off

# lro часто конфликтует с gro, поэтому лучше оставить gro

# Проверить количество очередей и их распределение

sudo ethtool -l eth0

# Установить максимальное количество очередей RX/TX, доступное для NIC (если NIC поддерживает)

sudo ethtool -L eth0 rx 16 tx 16

Для автоматической балансировки IRQs убедитесь, что служба irqbalance запущена:

sudo systemctl enable irqbalance

sudo systemctl start irqbalance

Для ручной привязки IRQs (для продвинутых сценариев):

# Определить IRQ номера для eth0

grep eth0 /proc/interrupts

# Пример: привязать IRQ 123 (первая очередь eth0) к CPU 1

echo 2 > /proc/irq/123/smp_affinity_list

# (2 в битовой маске соответствует CPU 1. Для CPU 0 это 1, для CPU 0 и 1 это 3 и т.д.)

4. Настройка eBPF (XDP)

Настройка eBPF обычно включает написание C-программы и загрузку ее в ядро с помощью утилит из bcc-tools или libbpf. Это более сложный процесс.

- Пример простейшей XDP-программы (отбрасывание всего трафика):

#include <linux/bpf.h>

#include <bpf/bpf_helpers.h>

SEC("xdp")

int xdp_drop_all(struct xdp_md *ctx)

{

// Эта программа просто отбрасывает все входящие пакеты

// Реальные XDP программы имеют сложную логику фильтрации

return XDP_DROP;

}

char _license[] SEC("license") = "GPL";

ip link):

# Скомпилировать C-код в объектный файл (требует clang и llvm)

clang -O2 -target bpf -c xdp_drop_all.c -o xdp_drop_all.o

# Загрузить XDP-программу на интерфейс eth0

sudo ip link set dev eth0 xdp obj xdp_drop_all.o section xdp

# Проверить статус XDP

sudo ip link show dev eth0

# Отключить XDP

sudo ip link set dev eth0 xdp off

Примечание: Использование eBPF требует глубокого понимания и осторожности. Начните с изучения bcc-tools и примеров на GitHub bcc и XDP Tutorial.

5. Настройка Jumbo Frames

Если вся ваша сеть (NIC, коммутаторы, маршрутизаторы) поддерживает Jumbo Frames (MTU > 1500), их активация может значительно повысить пропускную способность за счет уменьшения количества пакетов. Типичное значение для Jumbo Frames — 9000 байт.

- Изменение MTU:

sudo ip link set dev eth0 mtu 9000

Важно: Все устройства на пути должны поддерживать и быть настроены на использование Jumbo Frames. В противном случае это приведет к фрагментации и снижению производительности.

6. Рекомендации по выбору стека TCP/IP

- IPv6 First: В 2026 году IPv6 становится стандартом. Убедитесь, что ваши приложения и инфраструктура полностью поддерживают IPv6. Иногда это может дать небольшие преимущества в производительности за счет более эффективной маршрутизации и отсутствия NAT.

- TCP Fast Open (TFO): Для коротких, частых TCP-соединений TFO может значительно сократить задержку, позволяя отправлять данные в первом SYN-пакете. Активируйте его на сервере и клиенте:

net.ipv4.tcp_fastopen = 3 # 1 для клиента, 2 для сервера, 3 для обоих

Применяйте эти рекомендации и команды постепенно, тестируя каждый шаг и наблюдая за метриками производительности. Документируйте все изменения и будьте готовы к откату, если что-то пойдет не так.

Типичные ошибки при оптимизации сетевого стека

Оптимизация сетевого стека — это тонкое искусство, и ошибки могут стоить дорого. В 2026 году, когда системы становятся все более сложными и взаимосвязанными, последствия неправильной настройки могут быть катастрофическими. Вот пять наиболее распространенных ошибок, которых следует избегать:

1. Оптимизация без предварительного измерения и бенчмаркинга

Ошибка: Применение "общих" рекомендаций по оптимизации (например, из статьи в интернете или от коллеги) без понимания текущих узких мест и без измерения базовой производительности.

Как избежать: Всегда начинайте с тщательной диагностики. Используйте iperf3, netstat, ss, mpstat, ethtool для сбора метрик до любых изменений. Создайте нагрузочные тесты, имитирующие реальное поведение вашего приложения. Только так вы сможете точно определить, что именно нуждается в оптимизации, и оценить эффективность ваших действий. Без базовых метрик вы не сможете доказать, что оптимизация сработала, или понять, что она ухудшила ситуацию.

Пример последствий: Увеличение net.core.somaxconn до 65535 на сервере, который никогда не испытывал проблем с LISTEN-backlog, не принесет никакой пользы, но может создать ложное чувство оптимизации. В то же время, если реальной проблемой является нехватка буферов TCP, а вы настраиваете irqbalance, вы не только не решите проблему, но и потратите время впустую.

2. Слепое копирование конфигураций без понимания контекста

Ошибка: Применение настроек, найденных в интернете или используемых в другой системе, без учета специфики вашей инфраструктуры, приложения и аппаратного обеспечения.

Как избежать: Понимайте, что делает каждый параметр. Параметры, оптимальные для одного типа нагрузки (например, высокоскоростной передача файлов), могут быть совершенно неэффективны или даже вредны для другого (например, множество коротких HTTP-запросов). Учитывайте тип NIC, количество ядер CPU, топологию NUMA, версию ядра Linux и специфику сетевой среды (LAN/WAN).

Пример последствий: Активация tcp_tw_reuse на публичном сервере без понимания его взаимодействия с NAT-устройствами клиентов может привести к ошибочному приему "старых" пакетов и нестабильности соединений для части пользователей. Или, например, отключение tcp_timestamps для "экономии" 12 байт заголовка может негативно сказаться на точности измерения RTT и защите от устаревших сегментов, что более критично для WAN-соединений.

3. Игнорирование аппаратных возможностей NIC

Ошибка: Попытки оптимизировать сетевой стек исключительно программными методами, игнорируя аппаратные разгрузки, предоставляемые современной сетевой картой.

Как избежать: Всегда проверяйте возможности вашей NIC с помощью ethtool -k <interface> и ethtool -S <interface>. Убедитесь, что TSO, GSO, GRO, RSS и другие поддерживаемые разгрузки активированы. Для высокоскоростных NIC (10GbE и выше) это критически важно.

Пример последствий: Загрузка CPU на 50% из-за обработки сетевых прерываний на 25GbE NIC, в то время как аппаратный RSS отключен. Активация RSS могла бы снизить эту нагрузку до 5-10%, высвобождая CPU для приложений и значительно увеличивая пропускную способность без каких-либо изменений в ядре или приложении.

4. Недостаточное тестирование под нагрузкой и отсутствие мониторинга после изменений

Ошибка: Внесение изменений в продакшн без предварительного тестирования в тестовой среде, имитирующей реальную нагрузку, или отсутствие постоянного мониторинга после внедрения изменений.

Как избежать: Всегда тестируйте изменения в изолированной среде, которая максимально приближена к продакшну. Используйте инструменты для нагрузочного тестирования (wrk, locust, JMeter) и убедитесь, что система стабильна и производительность улучшилась. После развертывания в продакшне, внимательно следите за ключевыми метриками (CPU, память, задержка, потери пакетов, ошибки) с помощью систем мониторинга (Prometheus, Grafana, ELK).

Пример последствий: Изменение параметра net.ipv4.tcp_max_orphans на очень большое значение может привести к тому, что система будет держать слишком много "сиротских" сокетов, что в конечном итоге может исчерпать память и вызвать падение сервера при определенных пиковых нагрузках, которые не были учтены в тестовой среде.

5. Игнорирование влияния на безопасность и стабильность

Ошибка: Фокусировка исключительно на производительности, забывая о потенциальных рисках для безопасности и общей стабильности системы.

Как избежать: Некоторые оптимизации могут ослабить защитные механизмы ядра. Например, некоторые параметры, направленные на сокращение времени ожидания или повторного использования соединений, могут быть использованы злоумышленниками. Всегда оценивайте риски безопасности. При работе с eBPF, убедитесь, что программы тщательно протестированы и верифицированы, чтобы избежать непреднамеренных ошибок или уязвимостей. Всегда планируйте стратегию отката.

Пример последствий: Отключение SYN Cookies (net.ipv4.tcp_syncookies = 0) для повышения производительности установления соединений под очень высокой нагрузкой может сделать сервер крайне уязвимым к SYN-флуд атакам, что приведет к полной недоступности сервиса.

Чеклист для практического применения

Этот пошаговый чеклист поможет вам систематизировать процесс оптимизации сетевого стека Linux для ваших высоконагруженных приложений. Следуйте ему, чтобы обеспечить всесторонний и безопасный подход.

- Определите цель оптимизации:

- Что именно вы хотите улучшить? (Снизить задержку, увеличить пропускную способность, уменьшить использование CPU, предотвратить потери пакетов, улучшить масштабируемость?)

- Каковы ваши текущие лимиты и узкие места?

- Установите базовые метрики производительности:

- Проведите нагрузочное тестирование в текущей конфигурации.

- Зафиксируйте ключевые показатели: RTT, пропускная способность (

iperf3), PPS (pktgen), использование CPU (mpstat,top), ошибки и дропы пакетов (netstat -s,ss -s,ethtool -S). - Создайте графики в вашей системе мониторинга (Prometheus/Grafana) для отслеживания этих метрик.

- Проверьте аппаратные возможности NIC:

- Выполните

sudo ethtool -k <interface>иsudo ethtool -l <interface>. - Убедитесь, что TSO, GSO, GRO, RSS активированы, если поддерживаются.

- Настройте максимальное количество очередей RX/TX, если это применимо (

sudo ethtool -L <interface> rx <N> tx <N>). - Рассмотрите использование Jumbo Frames, если вся сеть поддерживает (

sudo ip link set dev <interface> mtu 9000).

- Выполните

- Оптимизируйте параметры ядра (sysctl):

- Создайте или отредактируйте файл

/etc/sysctl.d/99-network-optimizations.conf. - Установите адекватные значения для

net.core.somaxconn,net.ipv4.tcp_max_syn_backlog,net.core.rmem_max,net.core.wmem_max,net.ipv4.tcp_rmem,net.ipv4.tcp_wmem. - Включите

net.ipv4.tcp_tw_reuse = 1(если применимо для вашей роли сервера). - Установите

net.ipv4.tcp_congestion_control = bbr. - Примените изменения:

sudo sysctl -p /etc/sysctl.d/99-network-optimizations.conf.

- Создайте или отредактируйте файл

- Настройте балансировку прерываний (IRQ Balancing):

- Убедитесь, что служба

irqbalanceзапущена и активна. - Для экстремальных нагрузок рассмотрите ручную привязку IRQs к CPU (

/proc/irq/<IRQ_NUMBER>/smp_affinity_list), особенно для NUMA-систем.

- Убедитесь, что служба

- Рассмотрите применение eBPF:

- Изучите возможности XDP для фильтрации DDoS, быстрой маршрутизации или балансировки нагрузки.

- Используйте

bcc-toolsдля мониторинга и трассировки сетевого стека. - Если требуется кастомная логика, разработайте и протестируйте eBPF-программы.

- Проведите тестирование после каждого этапа оптимизации:

- Повторите нагрузочные тесты и сравните результаты с базовыми метриками.

- Оцените влияние на CPU, память, задержку и пропускную способность.

- Убедитесь в стабильности системы.

- Проверьте влияние на безопасность:

- Убедитесь, что оптимизации не открыли новые векторы атак или не ослабили существующие защиты.

- Проведите аудит изменений, особенно если они затрагивают фаервол или сетевые политики.

- Документируйте все изменения:

- Записывайте все внесенные изменения, их обоснование и результаты.

- Сохраняйте конфигурации в системе контроля версий.

- Планируйте стратегию отката:

- Всегда имейте четкий план действий на случай, если оптимизации приведут к проблемам.

- Убедитесь, что вы можете быстро вернуться к предыдущей рабочей конфигурации.

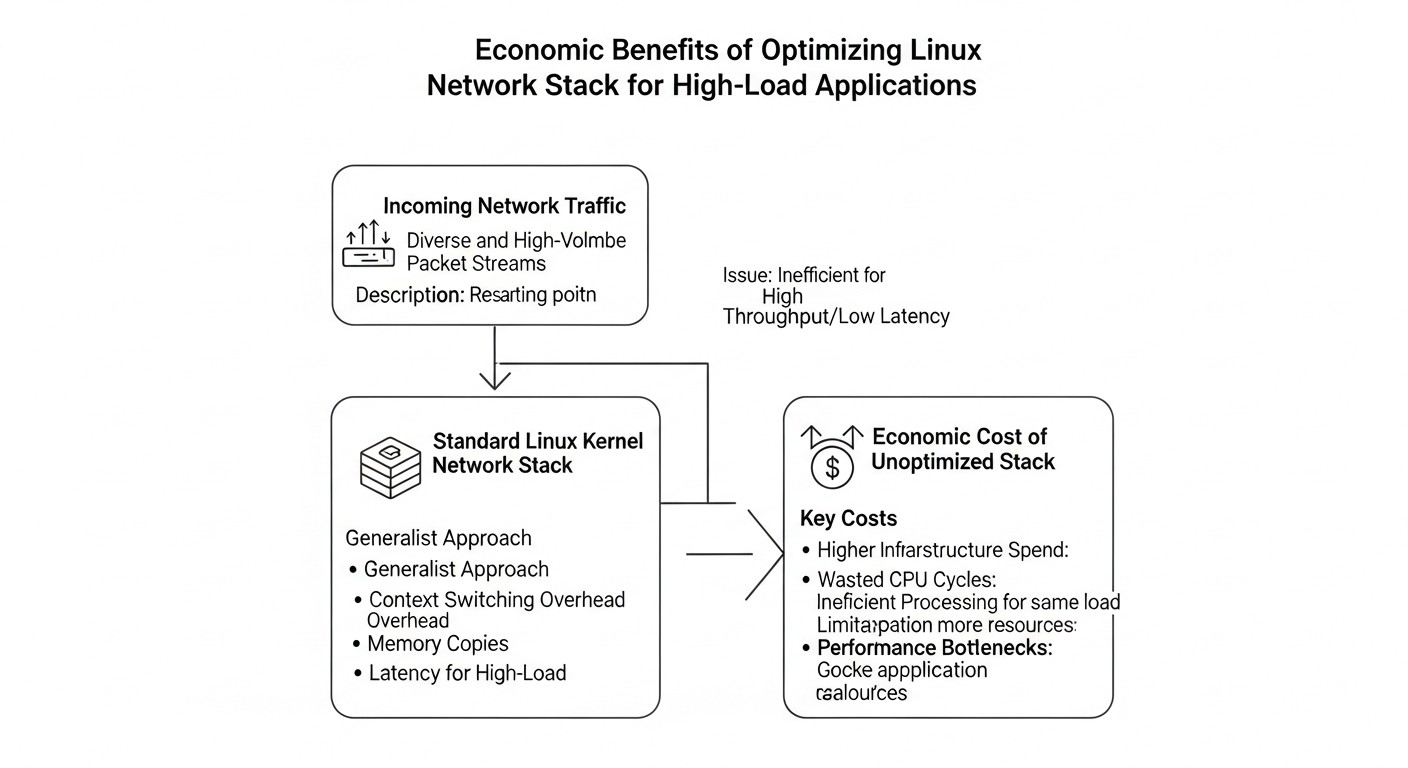

Расчет стоимости / Экономика оптимизации

Оптимизация сетевого стека Linux — это не просто техническая задача, но и экономическое решение. В 2026 году, когда облачные ресурсы становятся все дороже, а требования к производительности растут, правильная оптимизация может принести существенную экономию и повысить конкурентоспособность. Однако она также требует инвестиций. Давайте рассмотрим основные экономические аспекты.

Прямые и скрытые расходы

- Стоимость аппаратного обеспечения:

- NIC с продвинутыми разгрузками: Современные 25/50/100GbE NIC с поддержкой SR-IOV, расширенными offload-функциями и более мощными аппаратными хешированием могут стоить от $300 до $2000+ за карту. Это значительные инвестиции, но они окупаются снижением нагрузки на CPU.

- CPU: Иногда для обработки очень высоких PPS требуется более мощный CPU или сервер с большим количеством ядер. Однако цель оптимизации часто состоит в том, чтобы избежать покупки более мощного CPU за счет эффективного использования существующего.

- Стоимость инженерного времени:

- Изучение и планирование: Время, затраченное на изучение документации, бенчмаркинг, анализ узких мест.

- Внедрение и тестирование: Настройка

sysctl,ethtool, написание и отладка eBPF-программ, проведение нагрузочного тестирования. Это может быть от нескольких часов для базовых настроек до нескольких недель или даже месяцев для сложных eBPF-решений или DPDK. - Поддержка и мониторинг: Постоянный мониторинг производительности и адаптация настроек к меняющимся нагрузкам.

- Стоимость инструментов:

- Большинство инструментов (

iperf3,netstat,bcc-tools) бесплатны и с открытым исходным кодом. - Системы мониторинга (Prometheus, Grafana) также бесплатны, но их развертывание и поддержка требуют ресурсов.

- Большинство инструментов (

- Скрытые расходы неоптимизированной системы:

- Увеличенные облачные счета: Неэффективное использование CPU из-за сетевого стека означает, что вы платите за неиспользуемые мощности или вынуждены масштабировать инстансы раньше, чем это необходимо. Например, если сетевой стек потребляет 30% CPU, это эквивалентно 30% переплаты за CPU.

- Потери дохода из-за низкой производительности: Высокая задержка или низкая пропускная способность могут привести к ухудшению пользовательского опыта, оттоку клиентов, снижению конверсии или пропущенным бизнес-возможностям (например, в HFT).

- Потери из-за нестабильности: Перегрузки, потери пакетов и падения сервисов из-за неоптимизированной сети приводят к простоям и репутационным потерям.

- Дополнительные расходы на ПО: Иногда неоптимизированный сетевой стек вынуждает покупать более дорогие лицензии на сетевое ПО или балансировщики нагрузки, которые могли бы быть заменены eBPF-решениями.

Примеры расчетов для разных сценариев (2026)

Предположим, стоимость часа работы квалифицированного DevOps-инженера составляет $100.

| Сценарий | Метод оптимизации | Инвестиции (Dev Time) | Инвестиции (Hardware) | Потенциальная экономия/прибыль | ROI (окупаемость) |

|---|---|---|---|---|---|

| Малый SaaS (1000 RPS) | Базовые sysctl, BBR, проверка offloads |

4-8 часов ($400-$800) | $0 (использование текущих NIC) | Снижение CPU на 5-10%, экономия $50-$100/мес на облаке, улучшение UX. | 1-2 месяца |

| Средний Backend (100k RPS) | Продвинутые sysctl, RSS/RPS, ethtool, irqbalance |

20-40 часов ($2000-$4000) | $0-$600 (обновление NIC) | Снижение CPU на 10-20%, экономия $200-$500/мес на облаке, повышение стабильности. | 2-6 месяцев |

| Крупный Data Center (1M+ PPS) | eBPF (XDP/TC), SR-IOV, DPDK (если необходимо), глубокая настройка ядра | 80-320 часов ($8000-$32000) | $1000-$5000 (высокопроизводительные NIC) | Снижение CPU на 20-50%, возможность консолидации серверов (экономия $1000-$5000/мес), новые возможности (DDoS-защита, кастомный LB). | 3-12 месяцев (зависит от сложности) |

| HFT/Real-time (микросекунды) | DPDK, специализированные NIC, CPU affinity, kernel bypass | 320+ часов ($32000+) | $5000-$10000+ (спец. NIC, FPGA) | Минимальная задержка (мкс), конкурентное преимущество, прямые финансовые выгоды. | 1-3 месяца (за счет прямых доходов) |

Как оптимизировать затраты

- Начните с простого: Сначала примените самые дешевые и простые методы (

sysctl,ethtool). Они часто дают значительный прирост. - Используйте Open Source: Большинство инструментов и технологий (Linux, eBPF, Prometheus, Grafana) бесплатны, что снижает стоимость ПО.

- Постепенное внедрение: Не пытайтесь внедрить все и сразу. Итерационный подход с постоянным мониторингом позволяет избежать дорогостоящих ошибок.

- Обучение команды: Инвестиции в обучение инженеров eBPF и глубокому пониманию сетевого стека окупятся многократно, снижая зависимость от внешних консультантов.

- Автоматизация: Используйте Ansible, Terraform или другие инструменты IaC для автоматизации развертывания и управления конфигурациями, что снижает ручные ошибки и время на внедрение.

Экономика оптимизации сетевого стека — это баланс между инвестициями в инженерное время и оборудование, и потенциальной экономией на облачных ресурсах, повышением доходов за счет лучшего UX и снижением рисков простоя. В 2026 году этот баланс все больше смещается в сторону активной оптимизации, поскольку стоимость неэффективности растет.

Кейсы и примеры из реальной практики

Теория важна, но реальные примеры применения оптимизаций демонстрируют их истинную ценность. Вот несколько сценариев из практики 2026 года, показывающих, как различные подходы к оптимизации сетевого стека Linux помогают решать конкретные бизнес-задачи.

Кейс 1: Оптимизация API-шлюза для облачного SaaS-сервиса

Проблема: Крупный SaaS-сервис, предоставляющий API для мобильных и веб-приложений, столкнулся с высокой задержкой и случайными ошибками Connection Refused под пиковой нагрузкой (до 50 000 RPS). Мониторинг показал, что CPU API-шлюзов (на основе Nginx и Envoy) был загружен на 70-80%, а в логах ядра появлялись сообщения о переполнении LISTEN-backlog. Серверы работали на инстансах AWS c5n.xlarge (4 vCPU, 10 Gbps NIC).

Решение:

- Настройка

sysctl:- Увеличен

net.core.somaxconnс 128 до 16384, аnet.ipv4.tcp_max_syn_backlogс 1024 до 8192. Это позволило ядру обрабатывать больше одновременных попыток соединения. - Активирован

net.ipv4.tcp_tw_reuse = 1и уменьшенnet.ipv4.tcp_fin_timeout = 30, чтобы быстрее очищать порты после коротких HTTP-соединений. - Установлен

net.ipv4.tcp_congestion_control = bbrдля лучшей производительности через WAN.

- Увеличен

- Аппаратные разгрузки NIC:

- Проверены и активированы TSO, GSO, GRO с помощью

ethtool -K eth0 rx on tx on sg on tso on gso on gro on. Это значительно снизило нагрузку на CPU, связанную с сегментацией и сборкой пакетов. - Настроена балансировка IRQ с помощью

irqbalanceи дополнительно вручную привязаны очереди RSS к разным vCPU, чтобы равномерно распределить обработку прерываний.

- Проверены и активированы TSO, GSO, GRO с помощью

- XDP для DDoS-защиты:

- Развернута простая XDP-программа, которая на уровне драйвера NIC отбрасывает пакеты с известными сигнатурами DDoS-атак (например, SYN-флуд с аномальными флагами или источниками) до того, как они достигнут основного сетевого стека и Nginx.

Результаты:

- Ошибки

Connection Refusedполностью исчезли. - Средняя задержка API снизилась на 15% (с 40 мс до 34 мс).

- Использование CPU на API-шлюзах упало с 70-80% до 40-50% под той же нагрузкой, что позволило обрабатывать на 30% больше RPS на одном инстансе.

- Экономия на облачных ресурсах составила около $1500 в месяц за счет сокращения количества необходимых инстансов.

Кейс 2: Оптимизация платформы для потоковой обработки данных в реальном времени

Проблема: Компания, занимающаяся анализом финансовых данных в реальном времени, использовала Kafka-кластер для приема и обработки огромных объемов данных (до 20 Гбит/с входящего трафика на ноду). Возникали проблемы с потерей пакетов, что приводило к задержкам в обработке и неточностям в аналитике. Мониторинг показывал высокие значения rx_dropped и net.core.netdev_max_backlog переполнения.

Решение:

- Увеличение буферов ядра:

- Значительно увеличены

net.core.netdev_max_backlogдо 65535, а такжеnet.core.rmem_maxиnet.ipv4.tcp_rmemдо 32 МБ. Это позволило ядру буферизовать больше входящих пакетов в пиковые моменты, предотвращая их потерю. - Настроены

net.ipv4.tcp_wmemдля Kafka-продюсеров для обеспечения более эффективной отправки.

- Значительно увеличены

- Оптимизация NIC:

- Использованы 100GbE NIC с поддержкой SR-IOV для виртуальных машин, на которых работали Kafka-брокеры, что обеспечило почти нативную производительность сети.

- Настроены очереди RSS на максимальное количество, соответствующее количеству ядер CPU, и вручную привязаны IRQs, чтобы избежать конкуренции.

- eBPF для кастомной маршрутизации:

- Разработана TC eBPF-программа, которая на основе заголовков сообщений Kafka (или других метаданных) перенаправляла определенные потоки данных на специализированные Kafka-топики или даже на другие узлы кластера, минуя стандартную маршрутизацию ядра для "горячих" данных. Это позволило снизить нагрузку на CPU стандартного сетевого стека и обеспечить более прямой путь для критически важного трафика.

Результаты:

- Потери пакетов сократились практически до нуля.

- Пропускная способность кластера увеличилась на 25%, что позволило обрабатывать пиковые нагрузки без деградации.

- Задержка обработки данных снизилась на 10%, что критически важно для финансовых приложений.

- Уменьшилось количество ретрансмиссий TCP, что снизило нагрузку на CPU Kafka-брокеров.

Кейс 3: Снижение стоимости инфраструктуры для CDN-провайдера

Проблема: Крупный CDN-провайдер столкнулся с постоянно растущими расходами на инфраструктуру из-за необходимости масштабировать количество серверов для обслуживания пикового трафика. Основная нагрузка приходилась на выдачу статического контента (видео, изображения), что требовало высокой пропускной способности и эффективного использования CPU для обслуживания большого количества одновременных соединений.

Решение:

- Выбор алгоритма TCP-перегрузки:

- На всех CDN-нодах был активирован

net.ipv4.tcp_congestion_control = bbr. Это позволило значительно улучшить пропускную способность и снизить задержку для клиентов, находящихся на больших расстояниях или использующих сети с высокой задержкой, что особенно важно для CDN.

- На всех CDN-нодах был активирован

- Оптимизация буферов и

TIME_WAIT:- Буферы TCP были настроены на оптимальные значения для каждого типа серверов (для файловых серверов - большие, для прокси - средние).

net.ipv4.tcp_tw_reuse = 1был активирован на всех прокси-серверах и серверах-источниках, чтобы избежать исчерпания портов.

- Jumbo Frames:

- Внутри дата-центра, где это было возможно, настроены Jumbo Frames (MTU 9000) на всех сетевых интерфейсах и коммутаторах. Это позволило передавать больше данных за один пакет, снижая накладные расходы на заголовки и количество пакетов, обрабатываемых CPU.

- eBPF для L4-балансировки:

- Вместо использования дорогих аппаратных балансировщиков нагрузки или более ресурсоемких программных решений на основе Nginx, была разработана XDP-программа для L4-балансировки входящего трафика. Эта программа, работающая на граничных маршрутизаторах, распределяла входящие соединения по внутренним CDN-нодам с минимальными накладными расходами и задержкой.

Результаты:

- Общая пропускная способность CDN увеличилась на 20-30% без добавления новых серверов.

- Количество серверов, необходимых для обслуживания пиковой нагрузки, сократилось на 15%, что привело к прямой экономии на облачных/колокейшн расходах в размере $5000-$8000 в месяц.

- Средняя задержка доставки контента для конечных пользователей снизилась.

- Значительно снизилась нагрузка на CPU на граничных серверах, использующих XDP-балансировку.

Эти кейсы демонстрируют, что комплексный подход к оптимизации сетевого стека Linux, включающий настройку ядра, использование аппаратных разгрузок и применение eBPF, может привести к значительным улучшениям производительности и существенной экономии ресурсов в самых разных сценариях.

Инструменты и ресурсы для оптимизации и мониторинга

Для успешной оптимизации сетевого стека Linux необходим правильный набор инструментов для диагностики, тестирования, мониторинга и отладки. В 2026 году существует множество мощных утилит, многие из которых являются частью стандартного дистрибутива Linux или доступны как Open Source проекты.

Утилиты для диагностики и настройки

ip(iproute2): Современная заменаifconfigиroute. Позволяет управлять сетевыми интерфейсами, маршрутами, ARP-таблицами, а также просматривать детальную статистику.ip a show eth0 # Показать информацию об интерфейсе ip -s link show eth0 # Показать статистику интерфейса (ошибки, дропы) ip route show # Показать таблицу маршрутизацииss(socket statistics): Более быстрая и мощная заменаnetstatдля просмотра информации о сокетах.ss -s # Общая статистика по сокетам ss -tuna # Все TCP/UDP сокеты, слушающие и установленные ss -tuna | grep ESTAB # Только установленные TCP соединения ss -tuna | grep TIME-WAIT # Сокеты в состоянии TIME_WAIT ss -m # Показать статистику по памяти, используемой сокетамиnetstat: Классический инструмент для сетевой статистики. Хотяssпредпочтительнее для новых систем,netstat -sпредоставляет обширную статистику по протоколам (TCP, UDP, IP).netstat -s # Общая статистика по протоколамethtool: Утилита для управления параметрами сетевых карт, включая аппаратные разгрузки, скорость, дуплекс, RSS и другие.ethtool eth0 # Общая информация о NIC ethtool -k eth0 # Состояние аппаратных разгрузок ethtool -S eth0 # Статистика драйвера NIC (включая ошибки и дропы) ethtool -L eth0 # Количество RX/TX очередейsysctl: Утилита для просмотра и изменения параметров ядра Linux.sysctl -a | grep net.ipv4 # Все параметры net.ipv4 sysctl -w net.core.somaxconn=4096 # Установить параметрmpstat/top/htop: Для мониторинга использования CPU, особенно категорийsoftirq(si) иsystem, которые часто указывают на сетевую активность ядра.mpstat -P ALL 1 # Использование CPU по ядрам, каждую секундуtcpdump/wireshark: Для захвата и анализа сетевого трафика на уровне пакетов. Незаменимы для глубокой диагностики.tcpdump -i eth0 -n -s 0 -w capture.pcap # Захват всего трафика на eth0

Инструменты для мониторинга и тестирования

iperf3: Стандарт для измерения пропускной способности TCP и UDP. Позволяет тестировать производительность между двумя точками.iperf3 -s # Сервер iperf3 -c <server_ip> -P 10 -t 30 # Клиент, 10 потоков, 30 секундnetperf: Более продвинутый инструмент для измерения производительности сети, включая запросы/ответы, транзакции и т.д.wrk/locust/JMeter: Инструменты для нагрузочного тестирования веб-приложений и API. Помогают имитировать реальную нагрузку и выявлять узкие места.hping3: Инструмент для создания и анализа TCP/IP пакетов, полезен для тестирования фаерволов, сканирования портов и измерения задержки.- Prometheus + Grafana: Стандартная связка для сбора, хранения и визуализации метрик. С помощью

node_exporterможно собирать все системные метрики, включая сетевые. - ELK Stack (Elasticsearch, Logstash, Kibana): Для сбора, анализа и визуализации логов, что помогает выявлять сетевые ошибки и аномалии.

Инструменты для eBPF

bcc-tools(BPF Compiler Collection): Набор мощных инструментов на основе eBPF для трассировки, мониторинга и отладки ядра Linux, включая сетевой стек. Позволяет видеть, что происходит с пакетами на разных уровнях.tcplife: Отображает время жизни TCP-соединений.tcpconnect/tcpaccept: Отслеживает установление TCP-соединений.dropwatch: Отслеживает, где ядро отбрасывает пакеты.xdp_stats: Статистика по XDP-программам.

bpftool: Официальная утилита для управления eBPF-программами, картами и объектами. Позволяет загружать, выгружать программы, просматривать их статус, получать статистику.bpftool prog show # Показать все загруженные eBPF-программы bpftool map show # Показать все eBPF-картыlibbpf: Библиотека для разработки eBPF-приложений, упрощает взаимодействие с ядром.

Полезные ссылки и документация

- Документация ядра Linux по сети: Официальные документы по сетевому стеку.

- IO Visor Project и eBPF.io: Основные ресурсы по eBPF, туториалы, примеры, документация.

- BCC GitHub Repository: Исходный код и примеры

bcc-tools. - LWN.net: Отличный ресурс для глубоких технических статей о развитии ядра Linux, включая сетевой стек и eBPF.

- TCP Documentation: Подробная информация о параметрах TCP в ядре.

- DPDK.org: Официальный сайт Data Plane Development Kit.

Использование этих инструментов и ресурсов позволит вам не только эффективно оптимизировать сетевой стек, но и глубоко понимать его поведение, что критически важно для поддержания высокопроизводительных систем в 2026 году.

Troubleshooting: решение типичных проблем

Даже с самыми тщательными настройками, проблемы в сетевом стеке могут возникнуть. Умение быстро диагностировать и устранять их — важнейший навык. В этом разделе мы рассмотрим типичные проблемы и предложим диагностические команды и решения, актуальные для 2026 года.

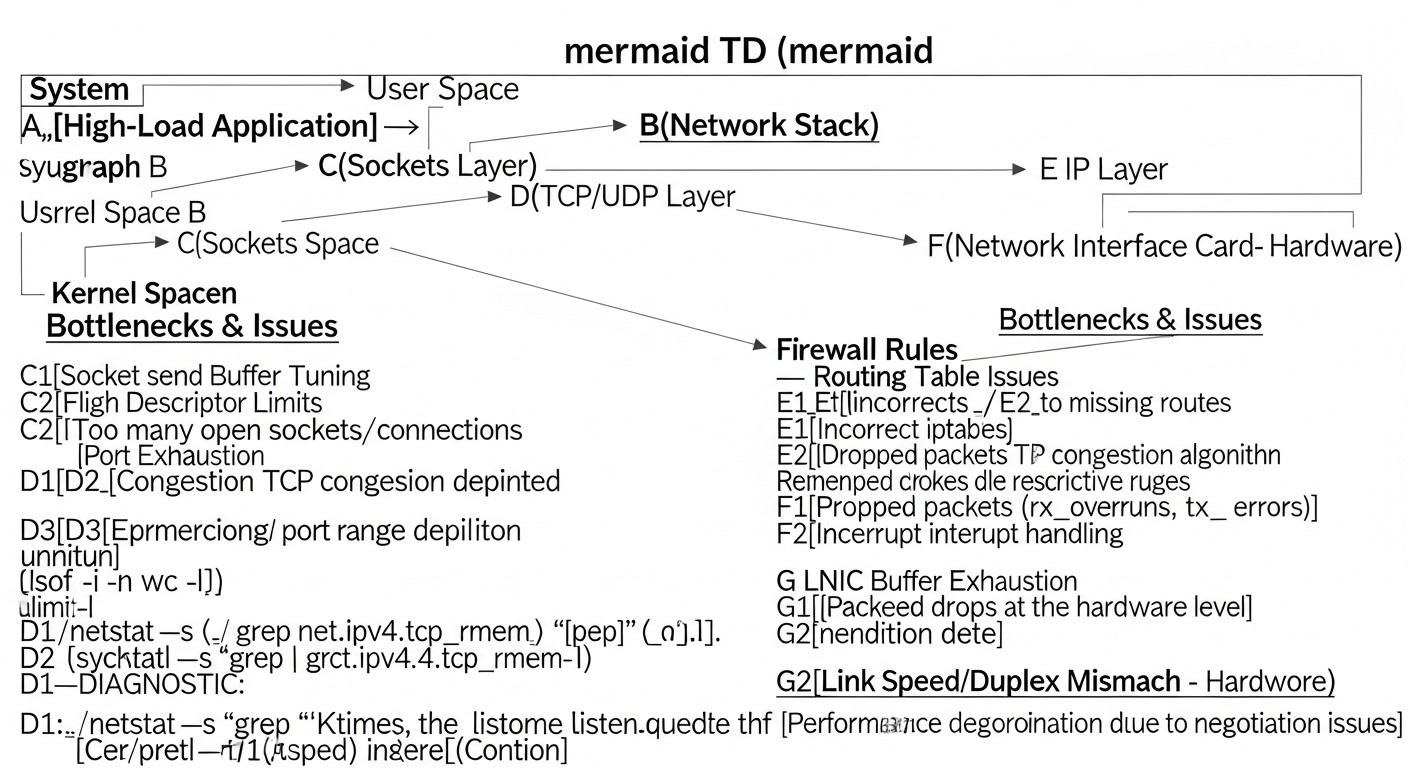

1. Высокая загрузка CPU (ksoftirqd / softirq)

Описание: Если top или mpstat показывают высокую загрузку CPU в категории si (softirq) или процесс ksoftirqd потребляет много ресурсов, это часто указывает на то, что ядро тратит много времени на обработку сетевых прерываний.

Диагностика:

mpstat -P ALL 1: Посмотреть загрузкуsoftirqпо каждому ядру. Если одно ядро сильно перегружено, это может указывать на проблему с балансировкой IRQ./proc/interrupts: Посмотреть распределение IRQ по ядрам. Ищите IRQ, связанные с вашей NIC.ethtool -S <interface> | grep rx_queue: Проверить количество пакетов, принятых каждой очередью RX. Если одна очередь принимает значительно больше пакетов, это проблема.

Решение:

- Активируйте RSS/RPS/RFS: Убедитесь, что аппаратный RSS включен на NIC (

ethtool -k <interface>). Если нет, или в дополнение, настройте RPS/RFS (/sys/class/net/<interface>/queues/rx-<N>/rps_cpus). - Настройте

irqbalance: Убедитесь, что службаirqbalanceзапущена. Для более точного контроля рассмотрите ручную привязку IRQ к CPU. - Проверьте offloads: Убедитесь, что TSO, GSO, GRO включены (

ethtool -k <interface>). - Рассмотрите XDP: Для очень высоких PPS, XDP может значительно снизить нагрузку на CPU, отбрасывая или перенаправляя трафик на ранней стадии.

2. Потери пакетов (Packet Drops)

Описание: Приложения сообщают о таймаутах, медленной работе, или netstat -s показывает растущие счетчики packet receive errors, dropped, overruns.

Диагностика:

ip -s link show <interface>: Проверить счетчикиrx_dropped,tx_dropped,overruns.netstat -s: Проверить статистику TCP (segments retransmited), UDP (packet receive errors).ss -s: Проверитьrecv-Qиsend-Qдля сокетов, а также глобальные счетчики.ethtool -S <interface>: Проверить счетчики ошибок и дропов на уровне драйвера NIC (например,rx_dropped_by_nic,rx_fifo_errors).dmesg | grep "tx ring": Поискать сообщения о переполнении буферов NIC.

Решение:

- Увеличьте буферы ядра:

net.core.netdev_max_backlog,net.core.rmem_max,net.ipv4.tcp_rmem,net.ipv4.tcp_wmem. - Увеличьте TX-очередь NIC:

ip link set dev <interface> txqueuelen <value>(например, 10000). - Проверьте физический слой: Неисправный кабель, порт коммутатора, или несовместимость скорости/дуплекса могут вызывать дропы.

- Устраните перегрузку CPU: Если дропы связаны с высокой загрузкой CPU, примените решения из пункта 1.

- XDP для раннего отбрасывания: Если дропы вызваны нежелательным трафиком (DDoS), XDP может отбрасывать его до переполнения буферов.

3. Медленные соединения или высокая задержка

Описание: Приложения отвечают медленно, ping показывает высокий RTT, traceroute выявляет задержки на сетевом пути.

Диагностика:

ping <destination>: Измерьте RTT.traceroute <destination>: Определите, на каком хосте/маршрутизаторе возникает задержка.ss -tin: Проверить RTT для установленных TCP-соединений.netstat -s | grep "retransmited": Высокое количество ретрансмиссий указывает на потери пакетов, которые увеличивают задержку.

Решение:

- Проверьте алгоритм управления перегрузками: Установите

net.ipv4.tcp_congestion_control = bbr, особенно для WAN-соединений. - Настройте буферы: Убедитесь, что

tcp_rmemиtcp_wmemдостаточно велики для вашей полосы пропускания и задержки. - Включите TCP Fast Open:

net.ipv4.tcp_fastopen = 3для сокращения задержки установления соединений. - Устраните потери пакетов: Если задержка вызвана ретрансмиссиями, решите проблему потерь пакетов.

- Проверьте MTU: Несогласованное MTU может приводить к фрагментации и снижению производительности.

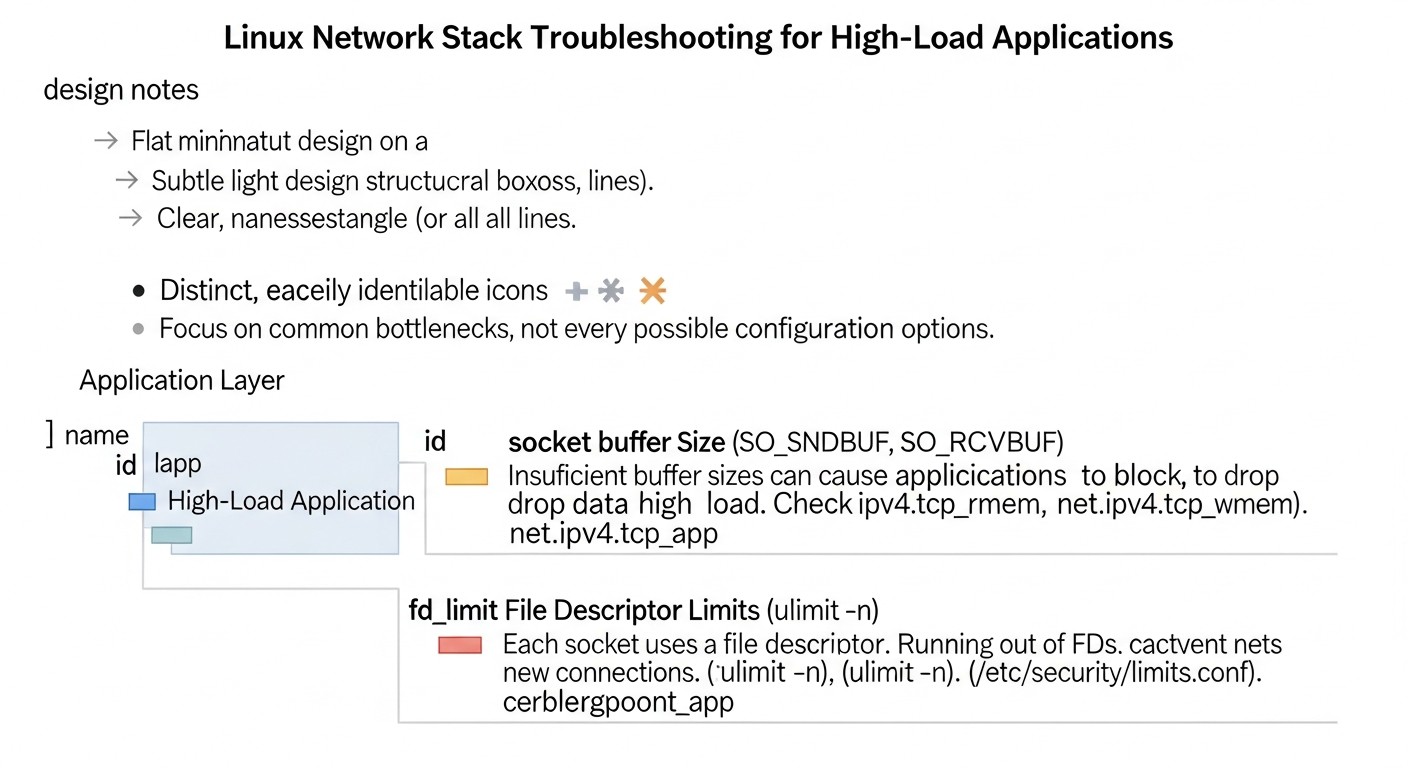

4. "Connection refused" или "Too many open files"

Описание: Приложения не могут установить новые соединения, серверы отказываются принимать соединения.

Диагностика:

ss -s | grep -i "listen": Проверить количество сокетов в состоянии LISTEN и их backlog.dmesg | grep "TCP: request_sock_TCP: dropped": Сообщения о сброшенных SYN-пакетах.ulimit -n: Проверить лимит на количество открытых файловых дескрипторов для процесса.cat /proc/sys/fs/file-nr: Общее количество открытых файловых дескрипторов в системе.

Решение:

- Увеличьте

somaxconnиtcp_max_syn_backlog:net.core.somaxconn,net.ipv4.tcp_max_syn_backlog. - Увеличьте лимит файловых дескрипторов: Настройте

ulimit -nдля пользователя/приложения и системный лимитfs.file-maxвsysctl. - Проверьте

TIME_WAITсокеты: Если много сокетов вTIME_WAIT, активируйтеnet.ipv4.tcp_tw_reuse = 1. - Проверьте фаервол: Убедитесь, что фаервол (

iptables,nftables) не блокирует входящие соединения.

5. Неэффективное использование CPU на NUMA-системах

Описание: На серверах с архитектурой NUMA (Non-Uniform Memory Access) наблюдается неравномерная загрузка CPU, или приложения испытывают задержки при доступе к памяти, хотя общая загрузка CPU невысока.

Диагностика:

numactl --hardware: Проверить топологию NUMA.numastat: Статистика использования памяти по NUMA-узлам.mpstat -N ALL: Загрузка CPU по NUMA-узлам.

Решение:

- Привязка IRQ к NUMA-узлам: Привяжите IRQ сетевой карты к CPU, находящимся на том же NUMA-узле, что и NIC.

- Привязка процессов к NUMA-узлам: Используйте

numactl --cpunodebind=<node> --membind=<node> <command>для запуска сетевых приложений на том же NUMA-узле, что и соответствующая NIC. - Настройка RPS/RFS с учетом NUMA: При настройке RPS/RFS убедитесь, что пакеты направляются на CPU, которые находятся на том же NUMA-узле, где и обработчик приложения.

Когда обращаться в поддержку:

- Если проблемы возникают после обновления ядра или драйвера NIC, и вы не можете найти решение.

- Если вы подозреваете аппаратную неисправность NIC, но не можете ее подтвердить.

- Если вы столкнулись с необъяснимыми падениями или зависаниями системы, связанными с сетевым стеком.

- Если вы не можете достичь ожидаемой производительности после всех примененных оптимизаций и исчерпали свои знания.

FAQ: Часто задаваемые вопросы

1. Является ли eBPF всегда лучшим решением для оптимизации сети?

Нет, не всегда. eBPF — это мощный инструмент, предлагающий беспрецедентную гибкость и производительность для определенных задач, таких как DDoS-защита, кастомная балансировка нагрузки или продвинутый мониторинг. Однако его внедрение требует высокой квалификации и значительных инженерных усилий. Для большинства стандартных высоконагруженных приложений, таких как веб-серверы или базы данных, достаточными и более простыми в реализации будут тонкая настройка sysctl, активация аппаратных разгрузок NIC и правильный выбор алгоритма TCP-перегрузки. eBPF следует рассматривать, когда другие методы исчерпаны или требуется очень специфичная, низкоуровневая логика обработки пакетов.

2. Стоит ли отключать все TCP-таймстампы (tcp_timestamps) для повышения производительности?

tcp_timestamps) для повышения производительности?В большинстве случаев нет. Хотя отключение tcp_timestamps экономит 12 байт в каждом TCP-заголовке, это несущественная экономия для современных высокоскоростных сетей. Временные метки играют важную роль в защите от устаревших сегментов (PAWS - Protection Against Wrapped Sequence numbers) и в более точном измерении RTT. Их отключение может привести к проблемам со стабильностью соединений, особенно в сетях с высокой задержкой или при очень быстром создании/закрытии соединений. Рекомендуется оставлять их включенными, если нет конкретных доказательств того, что они вызывают проблемы.

3. Как часто следует пересматривать настройки сетевого стека?

Настройки сетевого стека не являются статичными. Их следует пересматривать при значительных изменениях:

- Обновление ядра Linux: Новые версии могут приносить новые параметры или менять поведение существующих.

- Обновление аппаратного обеспечения: Новые NIC могут иметь другие возможности разгрузки.

- Изменение профиля нагрузки приложения: Рост трафика, изменение типов запросов, увеличение количества соединений.

- Возникновение новых сетевых проблем: Потери пакетов, высокая задержка, перегрузка CPU.

4. Каково влияние tcp_tw_reuse на безопасность?

tcp_tw_reuse на безопасность?tcp_tw_reuse позволяет повторно использовать сокеты в состоянии TIME_WAIT для новых исходящих соединений. Это безопасно для клиентов или прокси, которые инициируют множество соединений. Однако на сервере, принимающем входящие соединения, активация tcp_tw_reuse может быть рискованной, если этот сервер находится за NAT, который не соблюдает RFC 1323 (TCP Timestamps). В таком случае, сервер может принять пакет с устаревшим номером последовательности от нового соединения, ошибочно приняв его за часть старого, что может привести к повреждению данных или нестабильности. Поэтому tcp_tw_reuse обычно рекомендуется активировать только на клиентских машинах или на серверах, которые не находятся за NAT и не принимают входящие соединения.

5. Могут ли эти оптимизации нарушить работу моего приложения?

Да, неправильная оптимизация может привести к нестабильности, снижению производительности или даже падению системы. Например, слишком большие буферы могут привести к увеличению задержки (bufferbloat), а слишком маленькие — к потерям пакетов. Неправильная настройка IRQ или RSS может вызвать дисбаланс нагрузки на CPU. Именно поэтому крайне важен итеративный подход: вносите изменения по одному, тестируйте их в контролируемой среде, мониторьте эффект и будьте готовы к откату. Никогда не применяйте изменения в продакшн без предварительного тестирования.

6. Какова роль systemd-networkd и NetworkManager в контексте этих оптимизаций?

systemd-networkd и NetworkManager в контексте этих оптимизаций?systemd-networkd и NetworkManager — это службы, управляющие сетевыми интерфейсами и их конфигурацией на более высоком уровне. Они отвечают за назначение IP-адресов, настройку DNS, маршрутизацию и другие базовые сетевые параметры. Большинство описанных здесь оптимизаций (sysctl, ethtool) действуют на более низком уровне ядра или драйвера NIC и, как правило, не конфликтуют с этими службами. Однако важно убедиться, что эти службы не переопределяют ваши ручные настройки (например, MTU, или некоторые параметры ethtool). Для сохранения настроек ethtool после перезагрузки часто требуются дополнительные скрипты или конфигурационные файлы, специфичные для вашей системы инициализации.

7. Как облачные среды влияют на эти оптимизации?

В облачных средах (AWS, GCP, Azure) вы работаете с виртуализированным оборудованием. Некоторые аппаратные разгрузки NIC (например, SR-IOV) могут быть доступны только на определенных типах инстансов. Возможности настройки ядра остаются, но могут быть ограничения на изменение некоторых параметров в контейнерных средах (например, в Kubernetes, где некоторые sysctl могут быть заблокированы). Часто облачные провайдеры уже применяют базовые оптимизации на уровне гипервизора. Важно консультироваться с документацией вашего облачного провайдера относительно доступных сетевых функций и рекомендаций по оптимизации для их платформы.

8. Когда следует рассматривать пользовательское пространство (DPDK) вместо eBPF?

DPDK следует рассматривать только в самых экстремальных сценариях, когда даже XDP-оптимизации не обеспечивают требуемой производительности. Это обычно относится к телекоммуникационным системам, высокочастотному трейдингу (HFT), специализированным маршрутизаторам/фаерволам и NFV, где требуется обработка десятков миллионов пакетов в секунду с микросекундными задержками. Внедрение DPDK требует полного обхода сетевого стека ядра, что означает, что ваше приложение должно быть написано или переписано для работы с библиотеками DPDK. Это значительно увеличивает сложность разработки, поддержки и теряет преимущества стандартных сетевых утилит Linux.

9. Каково будущее сетевой оптимизации за пределами eBPF?

Будущее сетевой оптимизации в 2026 году и далее обещает быть захватывающим. Продолжится развитие eBPF, появятся новые типы программ и точки прикрепления, расширятся возможности аппаратных разгрузок. Мы увидим больше интеграции с искусственным интеллектом и машинным обучением для адаптивной оптимизации сети в реальном времени, предсказания перегрузок и автоматического применения настроек. Также будут развиваться технологии, такие как SmartNICs (программируемые сетевые карты с собственными CPU/FPGA), которые будут брать на себя еще больше сетевой логики. Квантовые сети и новые протоколы также могут внести свои коррективы, но базовые принципы эффективной обработки пакетов останутся актуальными.

10. Безопасно ли использовать BBR на продакшене?

Да, BBR считается безопасным для использования на продакшене и часто рекомендуется. Он был разработан Google и широко используется в их инфраструктуре, а также в многих CDN и облачных сервисах. BBR обычно обеспечивает лучшую пропускную способность и меньшую задержку по сравнению с CUBIC, особенно на WAN-соединениях. Однако, как и любой алгоритм управления перегрузками, BBR может быть более агрессивным в определенных сетевых условиях, что потенциально может вытеснять трафик, использующий более старые алгоритмы. В большинстве случаев это не является проблемой, но в очень специфичных, сильно перегруженных сетях с разнородным трафиком, может потребоваться дополнительный мониторинг.

Заключение

В условиях постоянно растущих требований к производительности и масштабируемости современных приложений, оптимизация сетевого стека Linux перестала быть опциональной задачей и превратилась в критически важный элемент успешной инфраструктуры. В 2026 году, когда каждый миллисекунда задержки и каждый процент использования CPU могут напрямую влиять на бизнес-метрики, глубокое понимание и умелое применение техник оптимизации являются конкурентным преимуществом.

Мы прошли путь от базовых настроек ядра с помощью sysctl, которые остаются фундаментом для большинства систем, до использования передовых аппаратных разгрузок сетевых карт, способных значительно снизить нагрузку на CPU. Особое внимание было уделено eBPF — технологии, которая революционизирует сетевую обработку, предоставляя беспрецедентные возможности для программирования ядра без его модификации, открывая двери для высокопроизводительных фаерволов, балансировщиков нагрузки и систем мониторинга, работающих со скоростью линии. Мы также рассмотрели экстремальные решения, такие как DPDK, для самых требовательных сценариев.

Ключевые выводы, которые вы должны усвоить:

- Измерение — это всё: Никогда не оптимизируйте вслепую. Всегда начинайте с бенчмаркинга и постоянно мониторьте влияние изменений.

- Комплексный подход: Оптимизация — это многоуровневый процесс, затрагивающий ядро, драйверы, аппаратное обеспечение и даже приложения.