El Auge de la IA Generativa y Stable Diffusion en 2025

Stable Diffusion ha consolidado su posición como una tecnología transformadora en el ámbito de la IA generativa, empoderando a artistas, diseñadores y desarrolladores para crear impresionantes imágenes a partir de indicaciones de texto. En 2025, sus aplicaciones se han expandido mucho más allá de la mera generación de imágenes, abarcando desde la creación rápida de prototipos en el desarrollo de juegos y la visualización arquitectónica hasta la generación de conjuntos de datos diversos para la investigación en aprendizaje automático. Sin embargo, las demandas computacionales de estos modelos, especialmente con versiones avanzadas como SDXL 1.0 y sus sucesores, requieren recursos de GPU potentes y rentables.

El desafío para muchos radica en navegar por el complejo ecosistema de proveedores de GPU en la nube. Con una plétora de opciones que ofrecen varias GPU NVIDIA –desde las de grado empresarial H100 y A100 hasta la muy popular RTX 4090 de nivel de consumidor–, elegir la configuración óptima requiere información detallada sobre el rendimiento y los precios. Este benchmark tiene como objetivo eliminar el ruido, proporcionando datos concretos para guiar sus decisiones.

El Paisaje Evolutivo de la Computación en la Nube con GPU para IA

El mercado de la nube con GPU es más dinámico que nunca. Impulsados por la insaciable demanda de computación de IA, los proveedores están constantemente actualizando su hardware, optimizando su infraestructura e introduciendo nuevos modelos de precios. En 2025, estamos viendo:

- Mayor Disponibilidad de GPU de Nivel Superior: Aunque las H100 eran escasas inicialmente, su disponibilidad ha mejorado significativamente, haciéndolas más accesibles para diversos proyectos.

- Precios Competitivos: La competencia entre proveedores como RunPod, Vast.ai, Lambda Labs y Vultr ha llevado a precios más agresivos, especialmente para instancias spot y compromisos a largo plazo.

- Pilas de Software Sofisticadas: Los entornos en la nube ahora vienen preconfigurados con controladores optimizados, versiones de CUDA y frameworks de IA, lo que reduce el tiempo de configuración y maximiza el rendimiento.

- Enfoque en la Escalabilidad y Flexibilidad: Los servicios están diseñados para permitir una escalabilidad fluida de los recursos, algo crítico para el entrenamiento de modelos a gran escala o tareas de inferencia de alto volumen.

Comprender estas tendencias es vital antes de sumergirse en comparaciones de hardware específicas, ya que el ecosistema del proveedor puede impactar significativamente su experiencia general y sus costos operativos.

Metodología de Benchmarking: Cómo Probamos Stable Diffusion

Para proporcionar datos precisos y accionables, desarrollamos una metodología de prueba rigurosa diseñada para simular cargas de trabajo de Stable Diffusion del mundo real. Nuestro objetivo fue evaluar el rendimiento en diferentes arquitecturas de GPU y proveedores de la nube bajo condiciones consistentes.

Configuración de Hardware

Seleccionamos tres arquitecturas de GPU NVIDIA prominentes que representan diferentes niveles de rendimiento y rentabilidad:

- NVIDIA H100 (80GB HBM3): El rey actual para cargas de trabajo de IA en centros de datos, conocido por su potencia de cómputo inigualable, gran memoria y Tensor Cores especializados para operaciones FP8/FP16.

- NVIDIA A100 (80GB HBM2): Un predecesor altamente capaz de la H100, todavía ampliamente disponible y que ofrece un excelente rendimiento para la mayoría de las tareas de IA.

- NVIDIA RTX 4090 (24GB GDDR6X): La GPU de consumo de gama alta, reconocida por su increíble relación precio-rendimiento, lo que la convierte en una favorita para artistas individuales y proyectos de menor escala.

Cada GPU se probó en instancias con amplios núcleos de CPU (típicamente 8-16 vCPUs) y RAM del sistema (64GB+) para asegurar que la GPU no estuviera limitada por otros recursos del sistema.

Pila de Software

La consistencia en el entorno de software es primordial para comparaciones justas. Nuestra pila estandarizada incluyó:

- Sistema Operativo: Ubuntu 22.04 LTS

- Versión de CUDA: 12.3 (o la última versión estable compatible con el proveedor de la nube específico)

- Controladores NVIDIA: Últimos controladores propietarios para cada GPU (ej., 545.23.08)

- Python: 3.10

- PyTorch: 2.2.0 con soporte CUDA

- Librería Hugging Face Diffusers: Última versión estable (ej., 0.26.3)

- Modelo Stable Diffusion: SDXL 1.0 Base y Refiner para generación de imágenes de 1024x1024.

- Optimizaciones: xFormers (donde sea compatible y esté habilitado), FlashAttention 2.0 (donde sea aplicable) e inferencia de media precisión (FP16).

Casos de Prueba y Métricas

Nos centramos en una carga de trabajo de Stable Diffusion común y computacionalmente intensiva:

- Tarea: Generación de Texto a Imagen (SDXL 1.0 Base + Refiner)

- Resolución de Imagen: 1024x1024 píxeles

- Pasos de Muestreo: 50 pasos

- Muestreador: DPM++ 2M Karras

- Tamaño de Lote: 1 (generación de una sola imagen para medir el rendimiento bruto)

- Prompt: Un prompt detallado y complejo diseñado para involucrar todos los aspectos del modelo.

- Métrica: Imágenes Por Segundo (IPS) – calculado como el número total de imágenes generadas dividido por el tiempo total de generación, promediado en 100 ejecuciones consecutivas para minimizar la varianza.

Proveedores de la Nube Incluidos

Nuestro benchmark incluyó una selección de proveedores de GPU en la nube populares conocidos por sus sólidas ofertas en el espacio de la IA:

- RunPod: Conocido por su diversa oferta de GPU, precios competitivos y una interfaz fácil de usar.

- Vast.ai: Un mercado de GPU descentralizado que ofrece precios de instancias spot altamente competitivos.

- Lambda Labs: Especializado en instancias de GPU de alto rendimiento, a menudo preferido para necesidades de servidores dedicados.

- Vultr: Un proveedor de la nube de propósito general con una creciente presencia en el segmento de GPU, que ofrece un enfoque equilibrado.

Los datos de precios se recopilaron en el momento de la prueba (principios de 2025) y representan las tarifas horarias típicas bajo demanda, reconociendo que los precios spot (Vast.ai) o las instancias reservadas (Lambda Labs) pueden ofrecer descuentos adicionales.

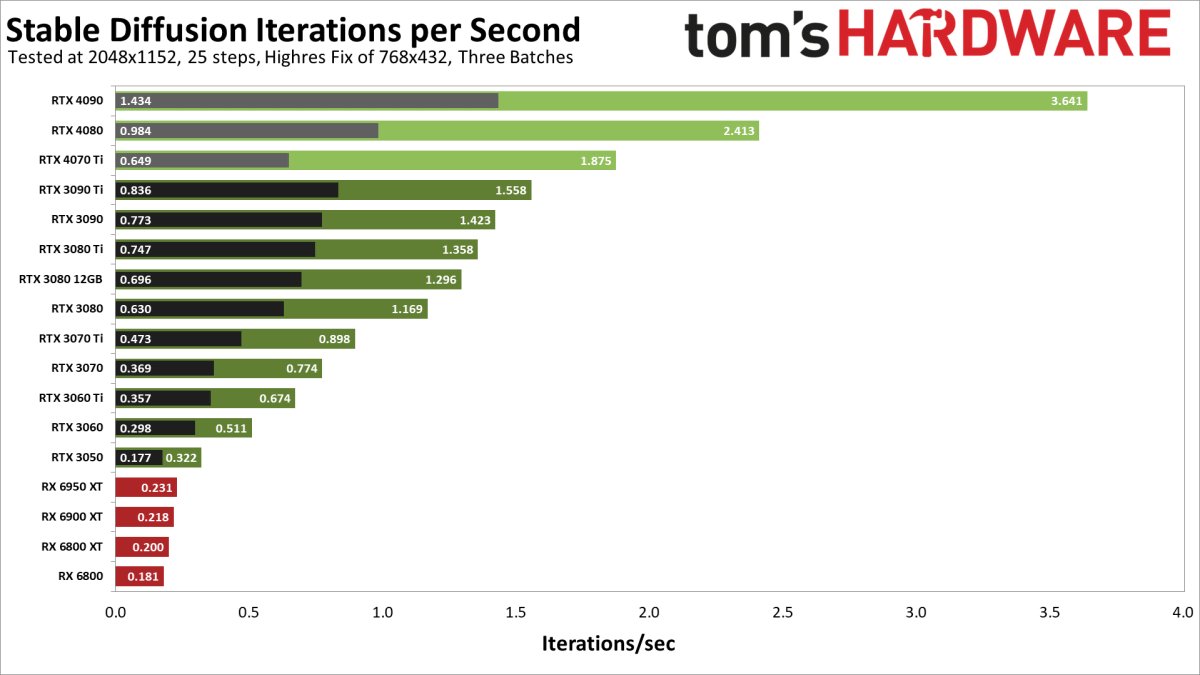

Resultados del Benchmark de Stable Diffusion 2025

Nuestras pruebas revelaron diferencias significativas en el rendimiento y la rentabilidad entre varias GPU y proveedores. A continuación, se presenta un resumen de nuestros hallazgos, centrándose en la métrica crítica de Imágenes Por Segundo (IPS) para la generación de SDXL 1024x1024, junto con el costo por hora y el costo calculado por cada 1000 imágenes.

Rendimiento de NVIDIA H100: Velocidad Inigualable para Cargas de Trabajo Empresariales

La NVIDIA H100 entregó consistentemente el IPS más alto, confirmando su estatus como la opción de primer nivel para cargas de trabajo de IA exigentes. Sus Tensor Cores avanzados y su enorme ancho de banda de memoria aceleran significativamente la generación de Stable Diffusion. Aunque el costo por hora es el más alto, su pura velocidad a menudo se traduce en un costo competitivo por imagen para tareas de alto volumen.

Rendimiento de NVIDIA A100: El Caballo de Batalla de la IA

La A100 sigue siendo una GPU formidable, ofreciendo un excelente rendimiento a un precio más accesible que la H100. Es un punto óptimo para muchos ingenieros de ML que necesitan una potencia sustancial sin la prima del hardware más reciente. Las diferencias de rendimiento entre proveedores para la A100 fueron mínimas, lo que sugiere una infraestructura subyacente consistente.

Rendimiento de NVIDIA RTX 4090: La Campeona en Rentabilidad

Para artistas individuales, pequeños estudios o proyectos con limitaciones presupuestarias, la RTX 4090 destaca. Aunque su IPS bruto es menor que el de sus contrapartes de centro de datos, su costo por hora significativamente más bajo la hace increíblemente atractiva, logrando a menudo el costo más bajo por cada 1000 imágenes. Sus 24GB de VRAM son amplios para la mayoría de las tareas de SDXL.

Tabla Comparativa de Rendimiento y Precios

La siguiente tabla resume las métricas clave de las GPU y proveedores probados. Todos los números de IPS son para SDXL 1.0 Base + Refiner, resolución 1024x1024, 50 pasos, tamaño de lote 1.

| Tipo de GPU | Proveedor | IPS (SDXL 1024x1024) | Precio/hr (USD) | Costo/1000 Imágenes (USD) |

|---|---|---|---|---|

| NVIDIA H100 | RunPod | 28 | $3.20 | $31.75 |

| NVIDIA H100 | Vast.ai | 27 | $2.80 | $28.81 |

| NVIDIA H100 | Lambda Labs | 29 | $3.50 | $33.52 |

| NVIDIA A100 | RunPod | 18 | $2.00 | $30.86 |

| NVIDIA A100 | Vast.ai | 17 | $1.70 | $27.78 |

| NVIDIA A100 | Vultr | 17 | $1.90 | $31.05 |

| NVIDIA RTX 4090 | RunPod | 10 | $0.70 | $19.44 |

| NVIDIA RTX 4090 | Vast.ai | 9 | $0.55 | $16.98 |

| NVIDIA RTX 4090 | Vultr | 9 | $0.65 | $20.06 |

Implicaciones en el Mundo Real y Análisis de Valor

Los números brutos cuentan parte de la historia, pero comprender sus implicaciones en el mundo real es clave para tomar la mejor decisión para su caso de uso específico.

Para Producción de Alto Volumen y Cargas de Trabajo Empresariales

Si su objetivo principal es la generación rápida y a gran escala de imágenes para aplicaciones comerciales, aumento de conjuntos de datos o inferencia continua, la NVIDIA H100 (y en menor medida, la A100) es su mejor opción. Proveedores como Lambda Labs y RunPod ofrecen instancias H100 robustas adecuadas para cargas de trabajo sostenidas. Si bien la tarifa por hora es más alta, el IPS superior minimiza el tiempo total de generación, lo que puede ser crítico para cumplir plazos y escalar operaciones. Vast.ai puede ofrecer excelentes precios para H100, pero la naturaleza del mercado spot podría introducir riesgos de interrupción para tareas muy largas e ininterrumpidas.

Para Prototipos, Desarrollo y Artistas Individuales

Para ingenieros de ML que prototipan nuevos modelos, científicos de datos que experimentan con diferentes prompts o artistas individuales que crean arte con IA, la NVIDIA RTX 4090 ofrece una propuesta de valor inigualable. Su bajo costo por cada 1000 imágenes significa que puede generar una gran cantidad de imágenes para experimentación sin arruinarse. Vast.ai frecuentemente tiene los precios más bajos para la RTX 4090, lo que la hace ideal para usuarios conscientes del presupuesto dispuestos a gestionar posibles interrupciones. RunPod y Vultr también proporcionan instancias estables de RTX 4090 con buena disponibilidad.

Rentabilidad: IPS por Dólar

Nuestro análisis de valor muestra claramente que la RTX 4090 en Vast.ai lidera en pura rentabilidad para la inferencia de Stable Diffusion, entregando imágenes a aproximadamente $16.98 por cada 1000. Esto la convierte en una excelente opción para cualquiera que priorice el presupuesto sobre la velocidad bruta absoluta. Para aquellos que necesitan más velocidad pero aún valoran la rentabilidad, la A100 en Vast.ai o RunPod ofrece un buen equilibrio. La H100, aunque es la más rápida, tiene un costo por imagen más alto, lo cual se justifica solo cuando el tiempo de finalización es un factor crítico.

Información Específica del Proveedor

- RunPod: Ofrece un gran equilibrio entre rendimiento, diversas opciones de GPU (incluyendo H100, A100, RTX 4090) y una plataforma fácil de usar. A menudo es una opción preferida por su fiabilidad y facilidad de uso.

- Vast.ai: Insuperable en precios de mercado spot, especialmente para RTX 4090 y A100. Si puede tolerar posibles interrupciones y se siente cómodo con un enfoque más práctico, Vast.ai proporciona ahorros de costos significativos.

- Lambda Labs: Destaca en la provisión de instancias dedicadas de alto rendimiento, particularmente para A100 y H100. Ideal para proyectos a largo plazo, clientes empresariales o aquellos que requieren tiempo de actividad garantizado y configuraciones específicas.

- Vultr: Un competidor sólido con precios competitivos para A100 y RTX 4090. Su ecosistema de nube integrado (almacenamiento, redes) puede ser beneficioso para proyectos que requieren más que solo computación GPU bruta.

Más Allá de Stable Diffusion: Otras Cargas de Trabajo de IA

Aunque este benchmark se centró en Stable Diffusion, las características de rendimiento observadas aquí son ampliamente aplicables a otras cargas de trabajo de IA:

- Inferencia de LLM: Las GPU con mayor VRAM (H100, A100 de 80GB) son cruciales para cargar e inferir grandes modelos de lenguaje. La mayor capacidad de cómputo de la H100 se traduce directamente en una generación de tokens más rápida.

- Entrenamiento y Ajuste Fino de Modelos: Para entrenar grandes modelos fundacionales o ajustar modelos existentes, el rendimiento FP8/FP16 de la H100, su enorme memoria y sus capacidades NVLink la convierten en la opción superior. Las A100 siguen siendo muy efectivas para muchas tareas de entrenamiento.

- IA Generativa Más Allá de las Imágenes: Ya sea generación de video, creación de modelos 3D o generación de datos sintéticos, se aplican los mismos principios de equilibrio entre potencia de GPU, VRAM y costo.

La elección de la GPU para Stable Diffusion es a menudo un buen indicador de sus necesidades en un espectro más amplio de tareas de IA generativa y aprendizaje automático.

Tendencias Futuras en la Nube con GPU para IA

Mirando hacia 2025 y más allá, anticipamos varias tendencias clave:

- Arquitecturas de Próxima Generación: Los sucesores de las series Blackwell (B100/B200) de NVIDIA y MI300 de AMD seguirán empujando los límites del rendimiento, lo que probablemente hará que las H100 actuales sean más accesibles.

- Optimizaciones de Software Mejoradas: Los avances continuos en frameworks como PyTorch, JAX y librerías como FlashAttention impulsarán aún más la eficiencia en todos los tipos de GPU.

- Funciones de GPU sin Servidor: El auge de las plataformas de GPU sin servidor ofrecerá un control de costos aún más granular, pagando solo por el tiempo de inferencia real en lugar del tiempo de actividad de la instancia por hora.

- Estrategias de Nube Híbrida: Muchas organizaciones adoptarán enfoques híbridos, utilizando GPU locales para datos sensibles o entrenamiento continuo, y GPU en la nube para cargas de trabajo puntuales o hardware especializado.

Mantenerse al tanto de estos desarrollos será crucial para mantener una ventaja competitiva en el desarrollo de IA.