Optimización de la inferencia AI/ML de alto rendimiento en GPU: Triton Inference Server y mejores prácticas (año 2026)

TL;DR

- Triton Inference Server es el estándar de facto para la inferencia AI/ML de alto rendimiento en GPU, garantizando baja latencia y alto rendimiento gracias al procesamiento por lotes, el paralelismo de modelos y la carga dinámica.

- Los factores clave de éxito en 2026 incluyen la elección de la GPU correcta (NVIDIA Blackwell B200/GB200 o AMD Instinct MI400), la cuantificación eficiente de modelos (INT8, FP8) y el uso de técnicas avanzadas de compilación (TensorRT).

- El escalado de la inferencia se logra mejor a través de Kubernetes con operadores como KServe o Seldon Core, lo que permite gestionar dinámicamente los recursos y garantizar la tolerancia a fallos.

- El monitoreo y la elaboración de perfiles son críticos: Prometheus, Grafana y NVIDIA DCGM ayudarán a identificar cuellos de botella en el rendimiento y optimizar el uso de la GPU.

- El ahorro de costes se logra mediante la selección precisa de instancias de GPU, la optimización agresiva de modelos, el uso de instancias spot en la nube y la gestión eficiente del ciclo de vida de los modelos.

- Los errores típicos incluyen subestimar la complejidad del despliegue, ignorar la optimización de modelos antes del despliegue, la falta de monitoreo adecuado y una configuración incorrecta del procesamiento por lotes.

- El futuro de la inferencia se dirige hacia modelos multimodales y súper grandes, que requieren inferencia distribuida y estrategias aún más sofisticadas para optimizar el uso de memoria y los cálculos.

Introducción

Esquema: Introducción

Esquema: Introducción

En 2026, cuando la inteligencia artificial y el aprendizaje automático se han convertido en una parte integral de prácticamente todas las industrias, desde el transporte autónomo hasta la medicina personalizada, un aspecto críticamente importante no es solo el desarrollo de modelos potentes, sino también su despliegue eficiente. La inferencia de alto rendimiento en GPU no es solo una característica deseable, sino un requisito estricto para la mayoría de las aplicaciones de IA modernas. Los usuarios esperan respuestas instantáneas, y las empresas exigen escalabilidad y eficiencia económica.

Los desafíos que enfrentan los equipos son numerosos: ¿cómo atender millones de solicitudes por segundo con una latencia mínima? ¿Cómo utilizar los costosos recursos de GPU de la manera más eficiente posible? ¿Cómo gestionar decenas o cientos de modelos diferentes, cada uno con sus propios requisitos de frameworks y versiones? ¿Cómo garantizar una alta disponibilidad y tolerancia a fallos bajo una carga en constante crecimiento?

Este artículo está dirigido a ingenieros DevOps, desarrolladores backend, fundadores de proyectos SaaS, administradores de sistemas y directores técnicos de startups que buscan construir una infraestructura fiable, escalable y económica para la inferencia AI/ML. Nos centraremos en NVIDIA Triton Inference Server como el estándar de oro en este campo, proporcionando un análisis profundo de sus capacidades, mejores prácticas y ejemplos concretos, relevantes para el panorama tecnológico de 2026.

No solo abordaremos los aspectos técnicos de Triton, sino también cuestiones más amplias como la elección del hardware, la optimización de modelos, la integración con orquestadores como Kubernetes, el monitoreo y la gestión de costes. El objetivo es proporcionarle una guía completa que le permita tomar decisiones informadas e implementar con éxito la inferencia de alto rendimiento en sus proyectos.

Criterios clave y factores de optimización de la inferencia de alto rendimiento

Esquema: Criterios clave y factores de optimización de la inferencia de alto rendimiento

Esquema: Criterios clave y factores de optimización de la inferencia de alto rendimiento

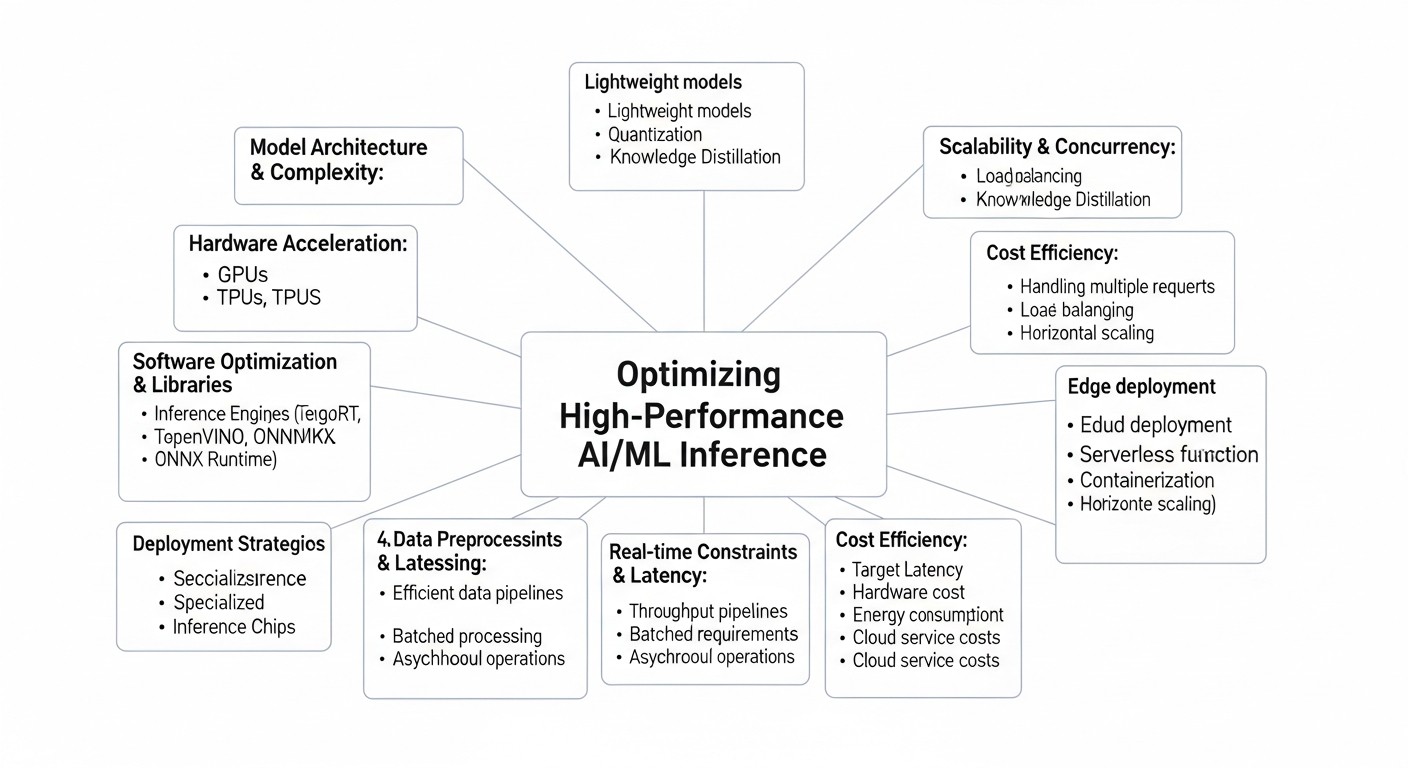

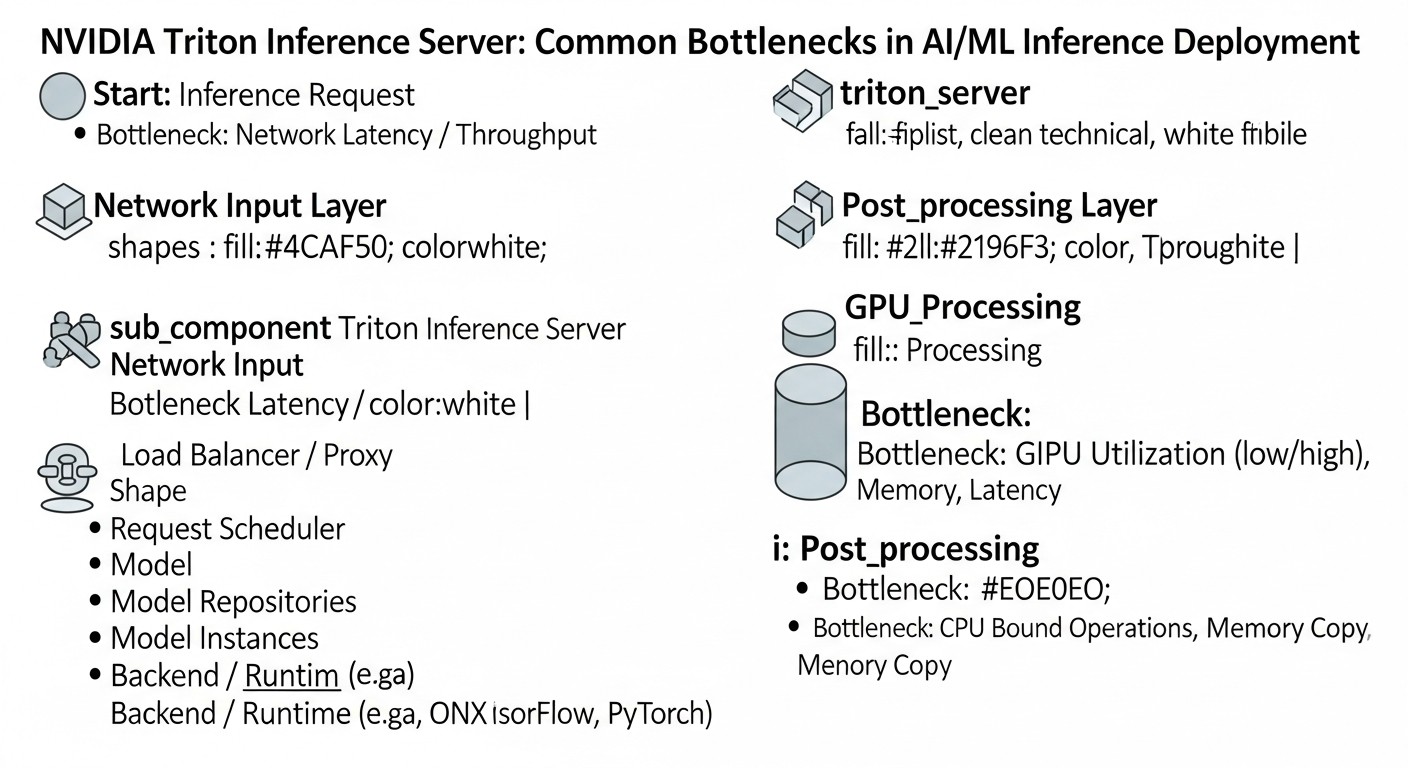

Para lograr un rendimiento y una eficiencia óptimos en la inferencia AI/ML en GPU, es necesario considerar muchos factores. Cada uno de ellos juega un papel clave en la arquitectura general y puede convertirse tanto en un cuello de botella como en una potente palanca de optimización. Examinémoslos en detalle.

1. Latencia (Latency)

La latencia es el tiempo necesario para recibir una respuesta del modelo después de enviar una solicitud. Para aplicaciones interactivas (por ejemplo, chatbots, sistemas de recomendación en tiempo real, conducción autónoma), una baja latencia es críticamente importante. Los usuarios esperan respuestas en decenas o cientos de milisegundos. Una alta latencia conduce a una mala experiencia de usuario y puede hacer que el producto sea inutilizable.

- Por qué es importante: Afecta directamente la UX, especialmente en escenarios en tiempo real.

- Cómo evaluar: Se mide en milisegundos (ms). Es importante observar la latencia p90, p95, p99, y no solo el valor promedio, para tener en cuenta los valores atípicos.

- Factores de influencia: Tamaño del modelo, complejidad de los cálculos, tipo de GPU, tamaño del lote (batch size), latencias de red, sobrecarga del servidor de inferencia.

2. Rendimiento (Throughput)

El rendimiento es la cantidad de solicitudes que un sistema puede procesar por unidad de tiempo (por ejemplo, solicitudes por segundo). Este es un indicador clave para sistemas de alta carga, donde es necesario atender un gran número de solicitudes paralelas, como el procesamiento de imágenes, flujos de video o documentos de texto.

- Por qué es importante: Determina la escalabilidad del sistema y la capacidad de manejar cargas pico.

- Cómo evaluar: Se mide en solicitudes por segundo (RPS) o inferencias por segundo.

- Factores de influencia: Número de GPU, su potencia computacional, tamaño del lote, eficiencia de la paralelización, sobrecarga de E/S.

3. Utilización de recursos de GPU (GPU Utilization)

El uso eficiente de la GPU es la maximización de la potencia computacional de hardware costoso. Una baja utilización significa que está pagando por recursos inactivos. El objetivo es mantener la GPU cargada lo más cerca posible del 100%, sin sacrificar la latencia.

- Por qué es importante: Afecta directamente los costes operativos. Una utilización insuficiente es dinero perdido.

- Cómo evaluar: Monitoreo de la utilización de la GPU (SM utilization, memory utilization) utilizando herramientas como

nvidia-smi, DCGM.

- Factores de influencia: Tamaño del lote, número de modelos paralelos, eficiencia de la planificación de tareas en la GPU, sobrecarga de la CPU, velocidad de transferencia de datos.

4. Rentabilidad (Cost-Effectiveness)

La relación rendimiento-coste. Esto no solo incluye los costes directos de la GPU, sino también los gastos de electricidad, refrigeración, mantenimiento, licencias (si aplica) y salarios de los ingenieros. En 2026, con la aparición de GPU más potentes y especializadas, como NVIDIA Blackwell B200/GB200 o AMD Instinct MI400, su alto coste hace que la cuestión de la rentabilidad sea aún más apremiante.

- Por qué es importante: Determina la viabilidad a largo plazo y la rentabilidad del producto de IA.

- Cómo evaluar: Cálculo del TCO (Total Cost of Ownership) y métricas como "coste por inferencia" o "coste por 1000 solicitudes".

- Factores de influencia: Elección del hardware (nube/on-premise, tipo de GPU), optimización de modelos, escalado eficiente, uso de instancias spot.

5. Soporte para diferentes frameworks y modelos (Framework/Model Support)

Los sistemas de IA modernos a menudo utilizan modelos desarrollados con diferentes frameworks (TensorFlow, PyTorch, ONNX, JAX, Hugging Face Transformers) y en diversos formatos. El servidor de inferencia debe proporcionar flexibilidad para trabajar con esta diversidad.

- Por qué es importante: Permite gestionar el despliegue de forma centralizada, evitando un "zoo" de servicios separados para cada modelo.

- Cómo evaluar: Lista de frameworks y formatos de modelos compatibles, facilidad para añadir nuevos.

- Factores de influencia: Arquitectura del servidor de inferencia (modular, de plugins), disponibilidad de backends preconstruidos.

6. Escalabilidad (Scalability)

La capacidad del sistema para aumentar o disminuir sus recursos en función de los cambios en la carga. Esto incluye tanto el escalado horizontal (añadir nuevas instancias de servidor) como el vertical (usar GPU más potentes o varias GPU en una misma instancia).

- Por qué es importante: Garantiza un funcionamiento estable durante las cargas pico y el ahorro de recursos en períodos de baja actividad.

- Cómo evaluar: Pruebas de carga, capacidad de integrarse con orquestadores (Kubernetes).

- Factores de influencia: Arquitectura de la aplicación, contenerización, uso de Kubernetes, políticas de autoescalado.

7. Facilidad de despliegue y gestión (Ease of Deployment & Management)

La complejidad de la configuración, el despliegue, la actualización y el monitoreo de los modelos y del propio servidor de inferencia. Cuanto más sencillos sean estos procesos, menos tiempo y recursos requerirá el equipo de DevOps.

- Por qué es importante: Reduce los costes operativos y acelera el ciclo de desarrollo/despliegue.

- Cómo evaluar: Tiempo necesario para desplegar un nuevo modelo, complejidad de la configuración, disponibilidad de API para la gestión.

- Factores de influencia: Documentación, imágenes Docker preconstruidas, Helm charts, disponibilidad de API de gestión.

8. Fiabilidad y tolerancia a fallos (Reliability & Fault Tolerance)

La capacidad del sistema para seguir funcionando incluso en caso de fallos de componentes individuales. Esto es crítico para los sistemas de producción, donde el tiempo de inactividad puede llevar a pérdidas financieras significativas.

- Por qué es importante: Garantiza la continuidad del servicio y previene la pérdida de datos o ingresos.

- Cómo evaluar: Tiempo de recuperación tras un fallo (RTO), pérdida de datos admisible (RPO), pruebas de fallos.

- Factores de influencia: Uso de orquestadores (Kubernetes), balanceadores de carga, duplicación de componentes, mecanismos de autorrecuperación.

9. Seguridad (Security)

Protección de modelos, datos e infraestructura contra accesos no autorizados, modificaciones o filtraciones. Incluye autenticación, autorización, cifrado de datos en tránsito y en reposo.

- Por qué es importante: Protección de la propiedad intelectual (modelos), datos confidenciales de clientes y cumplimiento de los requisitos regulatorios (GDPR, HIPAA).

- Cómo evaluar: Disponibilidad de mecanismos de autenticación/autorización, soporte TLS, aislamiento de recursos.

- Factores de influencia: Integración con sistemas de seguridad corporativos, uso de contenedores con privilegios mínimos, auditorías de seguridad regulares.

10. Versionado de modelos y pruebas A/B (Model Versioning & A/B Testing)

La capacidad de gestionar diferentes versiones de un mismo modelo, cambiar entre ellas de forma fluida y dirigir parte del tráfico a una nueva versión para pruebas antes del despliegue completo.

- Por qué es importante: Permite actualizar modelos de forma segura, realizar experimentos y minimizar los riesgos durante el despliegue.

- Cómo evaluar: Disponibilidad de mecanismos integrados de versionado y enrutamiento de tráfico, integración con pipelines de CI/CD.

- Factores de influencia: Funcionalidad del servidor de inferencia, soporte para Kubernetes Ingress/Service Mesh.

Tabla comparativa de enfoques para la inferencia en GPU (año 2026)

Esquema: Tabla comparativa de enfoques para la inferencia en GPU (año 2026)

Esquema: Tabla comparativa de enfoques para la inferencia en GPU (año 2026)

La elección del enfoque correcto para el despliegue de modelos de AI/ML en GPU es crucial. En 2026, existen varias estrategias maduras, cada una con sus fortalezas y debilidades. En esta tabla, compararemos las opciones más comunes, teniendo en cuenta las tecnologías actuales y las realidades de precios.

| Criterio |

"API Cruda" (FastAPI + PyTorch/TF) |

ONNX Runtime Inference Server |

NVIDIA Triton Inference Server |

KServe / Seldon Core (en Kubernetes) |

| Latencia (Latency) |

Media (depende de la optimización personalizada, sin batching dinámico) |

Baja (optimizado para ONNX, trabajo eficiente con CPU/GPU) |

Muy baja (batching dinámico, paralelismo multimodo, TensorRT) |

Baja (utiliza Triton/ONNX RT/TF Serving internamente, pero con gastos generales adicionales de Kubernetes) |

| Rendimiento (Throughput) |

Media (requiere implementación manual de batching) |

Alta (uso eficiente de recursos) |

Muy alta (uso máximo de GPU, solicitudes paralelas) |

Muy alta (escalado horizontal de Kubernetes, autoescalado) |

| Uso de GPU |

Medio (puede ser subóptimo sin configuración manual) |

Alto (bien optimizado) |

Muy alto (batching dinámico, planificador, multi-GPU) |

Alto (asignación eficiente de recursos a través de Kubernetes) |

| Complejidad de despliegue |

Baja para modelos simples, alta para optimización |

Media (requiere formato ONNX) |

Media-Alta (configuración de modelos, backends) |

Alta (requiere conocimientos profundos de Kubernetes) |

| Soporte de frameworks |

Cualquiera (ya que el código se escribe manualmente) |

ONNX (conversión desde PyTorch/TF/etc.) |

TensorFlow, PyTorch, ONNX, TensorRT, OpenVINO, custom backends |

Cualquiera (a través de la integración con TF Serving, PyTorch Serve, Triton, ONNX RT) |

| Escalabilidad |

Escalado horizontal manual, sin autoescalado de GPU |

Escalado horizontal de instancias |

Escalado horizontal de instancias, multi-GPU interno |

Escalado horizontal y vertical automático en Kubernetes |

| Versionado/Pruebas A/B |

Implementación manual |

Mediante el despliegue de diferentes instancias |

Mediante diferentes modelos/versiones en un mismo servidor, gestión de tráfico con herramientas externas |

Mecanismos integrados (KServe/Seldon) |

| Costo estimado (2026, para 10M inferencias/mes en GPU NVIDIA H200/B200) |

$500 - $2000 (depende de la optimización y la elección de la instancia) |

$400 - $1800 (debido a una mejor utilización) |

$300 - $1500 (uso óptimo de GPU, alto rendimiento) |

$600 - $2500 (gastos generales adicionales de Kubernetes, pero con mejor automatización) |

Nota: Los costos indicados son estimaciones para el año 2026 y pueden variar según el proveedor de la nube, la región, el tipo de instancia, el volumen de datos y la complejidad de los modelos. Incluyen solo el costo de las instancias de GPU, sin considerar el costo de CPU, almacenamiento, red y otros servicios.

Análisis detallado de cada punto/opción

Ahora profundicemos en cada uno de los enfoques presentados en la tabla comparativa para comprender sus características, ventajas y desventajas, así como los escenarios de aplicación.

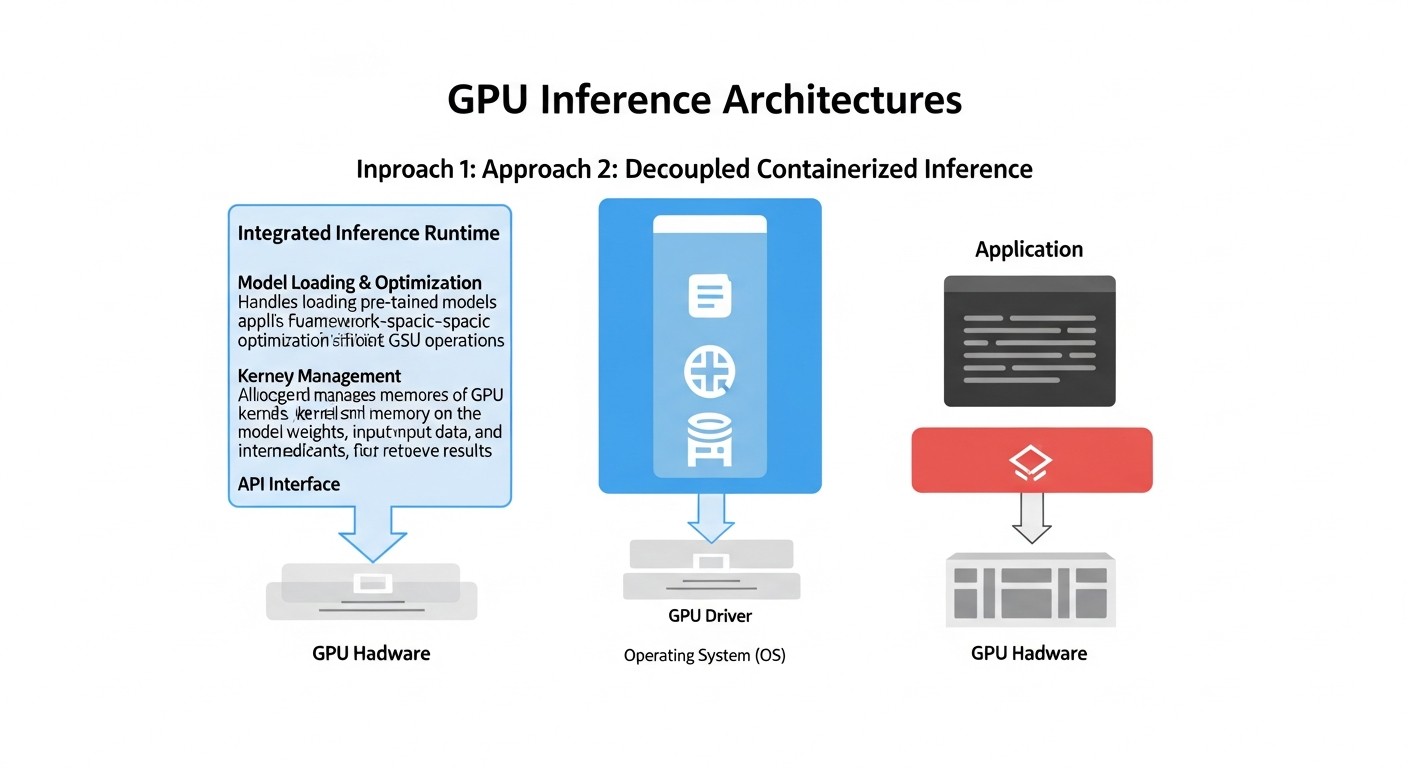

1. API "Cruda" (FastAPI + PyTorch/TensorFlow/JAX)

Este enfoque implica la creación de un servicio API HTTP propio utilizando frameworks web ligeros, como FastAPI (para Python), Express.js (para Node.js) o Gin (para Go), que carga y ejecuta directamente el modelo. El modelo suele estar envuelto en PyTorch, TensorFlow o JAX.

Ventajas:

- Control total: Usted tiene control total sobre cada aspecto del despliegue, desde el procesamiento de solicitudes hasta la carga del modelo y la lógica de inferencia. Esto permite implementar cualquier lógica específica.

- Facilidad para empezar: Para modelos simples y pequeños, especialmente al inicio de un proyecto, es la forma más rápida de llevar un modelo a producción, ya que no se requiere el aprendizaje de frameworks de inferencia complejos.

- Flexibilidad de frameworks: Soporta absolutamente cualquier framework o biblioteca de ML que pueda ejecutarse en su entorno.

- Bajos costos iniciales: No hay necesidad de dependencias adicionales, aparte del propio framework de ML y el servidor web.

Desventajas:

- Falta de optimizaciones "out-of-the-box": El batching dinámico, el paralelismo de modelos, la gestión eficiente de la memoria de la GPU, la inferencia multi-GPU, todo esto tendrá que implementarse manualmente, lo que requiere un esfuerzo y conocimientos expertos significativos.

- Complejidad de escalado: El escalado se vuelve complejo, ya que no hay mecanismos integrados para el uso óptimo de la GPU. A menudo conduce a una baja utilización de los costosos recursos de la GPU.

- Alta latencia y bajo rendimiento: Sin técnicas avanzadas, como el batching dinámico, cada modelo procesa las solicitudes secuencialmente o con un tamaño de lote no óptimo, lo que aumenta la latencia y reduce el rendimiento general.

- Falta de estandarización: Cada modelo puede requerir su propio servicio único, lo que lleva a un "zoo" y complica la gestión y el monitoreo.

Para quién es adecuado:

Este enfoque es ideal para startups en etapas tempranas, cuando se necesita probar rápidamente una hipótesis con uno o dos modelos simples que no requieren un rendimiento extremo. También es adecuado para tareas muy específicas donde los servidores de inferencia estándar no pueden proporcionar la personalización necesaria, y el equipo está dispuesto a invertir en el desarrollo de sus propias optimizaciones. Sin embargo, tan pronto como la carga aumenta o el número de modelos crece, es necesario pasar a soluciones más especializadas.

2. ONNX Runtime Inference Server

ONNX (Open Neural Network Exchange) Runtime es un acelerador de inferencia multiplataforma, desarrollado por Microsoft, que soporta modelos en formato ONNX. ONNX Runtime Inference Server proporciona un wrapper listo para usar para servir este tipo de modelos.

Ventajas:

- Alto rendimiento: ONNX Runtime en sí mismo está muy optimizado y puede proporcionar baja latencia y alto rendimiento, especialmente para CPU. En GPU también funciona bien, utilizando CUDA.

- Multiplataforma: Los modelos en formato ONNX pueden ejecutarse en diferentes dispositivos y sistemas operativos, lo que proporciona flexibilidad de despliegue.

- Soporte para múltiples frameworks: Los modelos de PyTorch, TensorFlow, Keras, Scikit-learn y otros frameworks pueden convertirse al formato ONNX.

- Facilidad de despliegue: El servidor es relativamente fácil de configurar y usar si ya tiene modelos en formato ONNX.

- Uso eficiente de recursos: ONNX Runtime incluye varias optimizaciones, como transformaciones de grafos y selección de operadores óptimos, lo que contribuye a un uso eficiente tanto de la CPU como de la GPU.

Desventajas:

- Requiere conversión a ONNX: No todos los modelos se convierten perfectamente a ONNX, y el proceso de conversión puede ser laborioso, especialmente para operaciones complejas o personalizadas.

- Menos optimizaciones profundas de GPU: Aunque ONNX Runtime soporta GPU, puede que no alcance el mismo nivel de optimizaciones profundas (por ejemplo, TensorRT) que los servidores de inferencia especializados, como Triton, especialmente para los escenarios más exigentes.

- Capacidades limitadas para escenarios complejos: Para la inferencia multimodo, conjuntos de modelos o carga/descarga dinámica de modelos, sus capacidades pueden ser menos desarrolladas en comparación con Triton.

- Falta de batching dinámico: Aunque ONNX Runtime soporta batching estático, el batching dinámico, que combina automáticamente las solicitudes para una máxima utilización de la GPU, está ausente o implementado de manera menos eficiente que en Triton.

Para quién es adecuado:

ONNX Runtime Inference Server es excelente para proyectos donde ya se utiliza ONNX para la unificación de modelos, o donde se requiere un alto rendimiento en diversas plataformas de hardware (incluidos dispositivos edge). Es una buena opción para reemplazar una API "cruda" cuando se necesita un nivel más alto de optimización sin la complejidad de Triton, especialmente si los modelos no requieren el máximo rendimiento posible de la GPU.

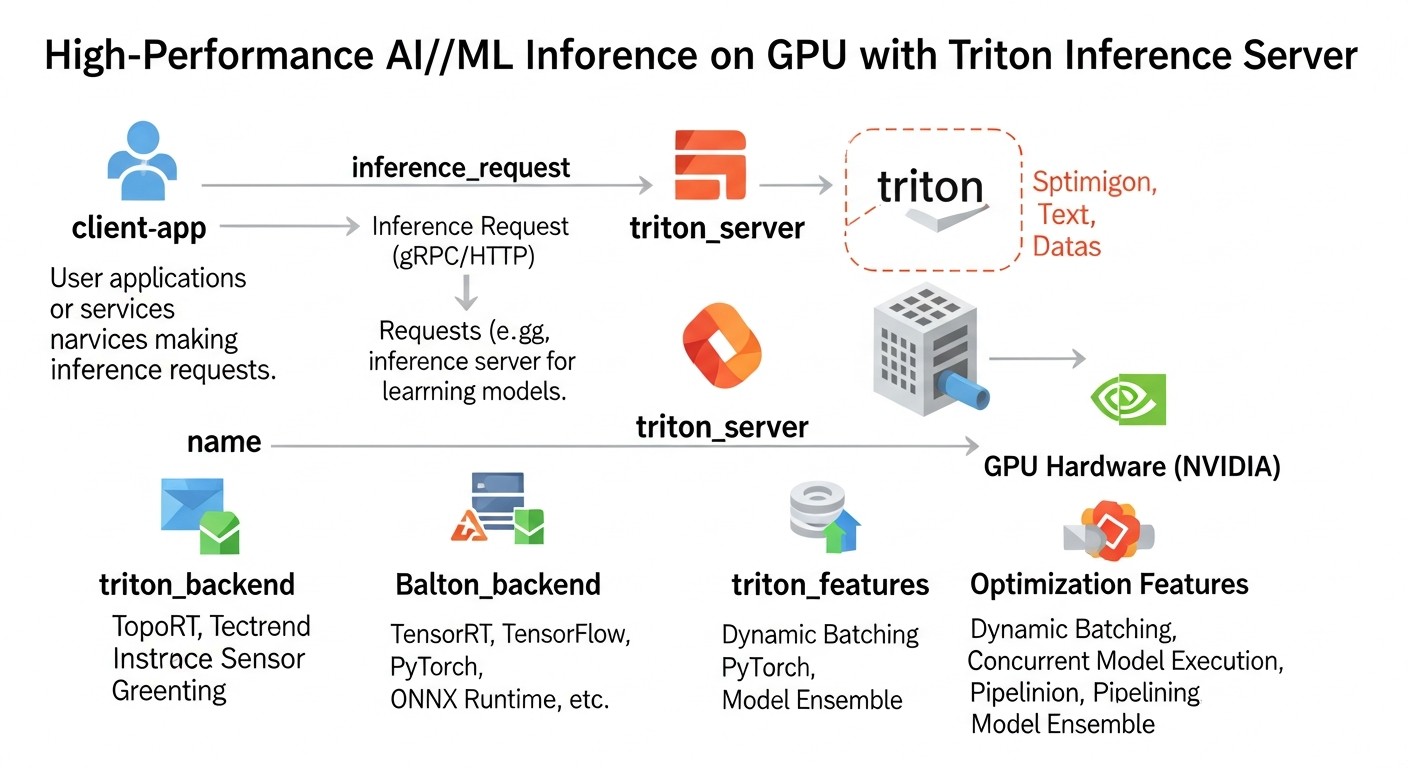

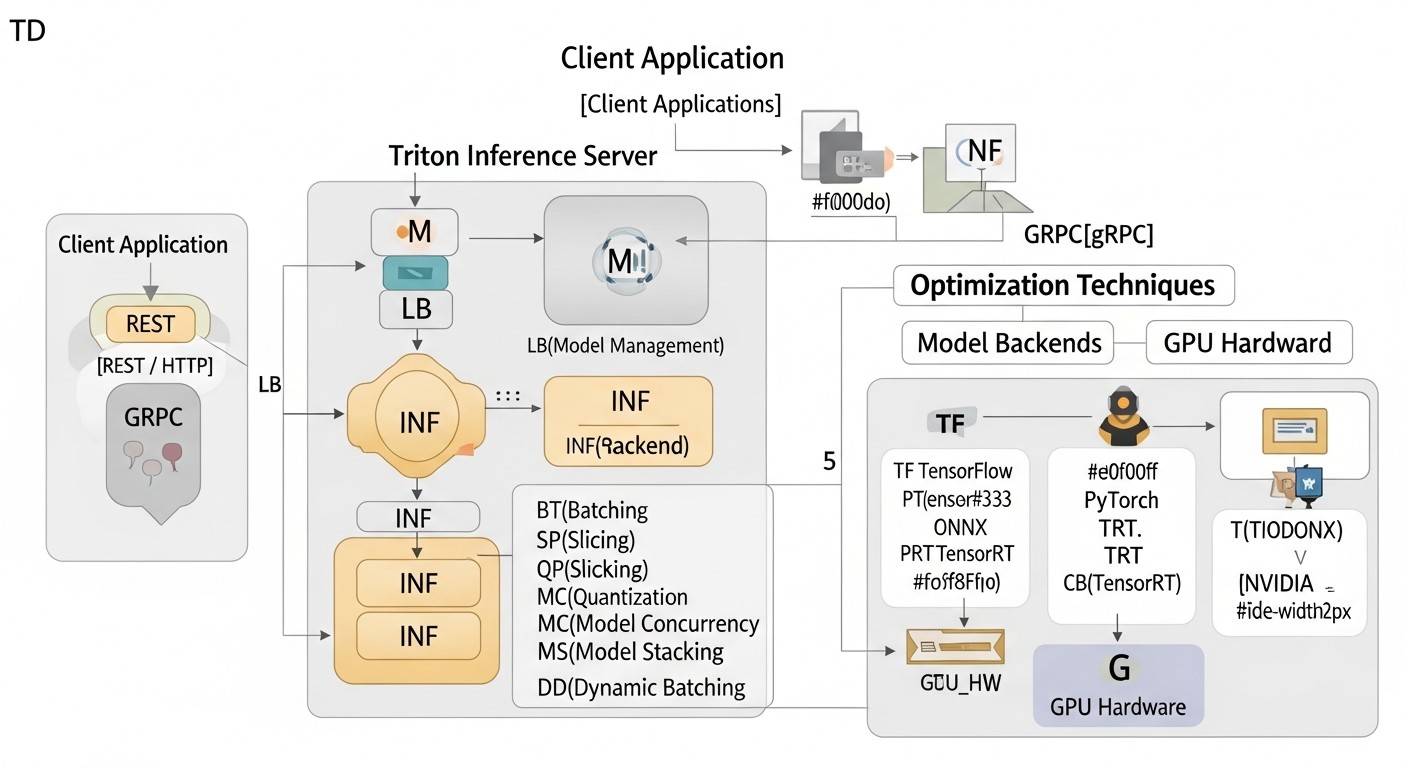

3. NVIDIA Triton Inference Server

NVIDIA Triton Inference Server (anteriormente TensorRT Inference Server) es un servidor de inferencia de alto rendimiento y código abierto, desarrollado por NVIDIA para el despliegue de modelos de aprendizaje automático en producción. Está diseñado para maximizar el uso de los recursos de la GPU, al tiempo que proporciona baja latencia y alto rendimiento.

Ventajas:

- Máximo rendimiento de GPU: Triton está desarrollado por NVIDIA y profundamente integrado con CUDA, TensorRT y otras optimizaciones de bajo nivel. Ofrece batching dinámico, paralelismo de modelos y solicitudes, así como inferencia multi-GPU, lo que permite lograr una utilización sin precedentes de la GPU.

- Amplio soporte de frameworks: Soporta TensorFlow, PyTorch, ONNX, TensorRT, OpenVINO, Scikit-learn, XGBoost y tiene la capacidad de extenderse con backends personalizados.

- Flexibilidad de configuración: Permite ajustar finamente el comportamiento del servidor para cada modelo, incluyendo el tamaño del lote, el número de instancias del modelo, las políticas de planificación y la gestión de la memoria.

- Inferencia multimodo: Capaz de servir múltiples modelos simultáneamente, distribuyendo eficientemente los recursos de la GPU entre ellos.

- Carga/descarga dinámica de modelos: Permite actualizar modelos sin reiniciar el servidor, lo cual es crítico para producción.

- Métricas integradas: Proporciona métricas extensas de Prometheus para monitorear el rendimiento y el uso de recursos.

Desventajas:

- Curva de aprendizaje: La configuración de Triton puede ser compleja, especialmente para nuevos usuarios, debido a la abundancia de opciones y la necesidad de comprender conceptos como backends, repositorios de modelos y políticas de planificación.

- Requisitos de infraestructura: Para aprovechar todo el potencial de Triton, a menudo se requiere el despliegue en Kubernetes, lo que añade su propia complejidad.

- Dependencia de NVIDIA: Aunque hay soporte para CPU y otras GPU, el rendimiento máximo se logra en hardware NVIDIA, lo que puede ser una limitación para algunos proyectos.

- Sobrecarga de CPU: Para un número muy grande de modelos o una planificación compleja, Triton puede consumir recursos significativos de CPU.

Para quién es adecuado:

Triton Inference Server es la elección ideal para empresas que trabajan con aplicaciones de IA de alta carga, que requieren el máximo rendimiento, baja latencia y alto rendimiento. Esto incluye grandes proyectos SaaS, proyectos en el campo del transporte autónomo, visión por computadora, procesamiento de lenguaje natural en tiempo real, así como para cualquier escenario donde la eficiencia económica del uso de la GPU sea una prioridad.

4. KServe / Seldon Core (en Kubernetes)

KServe (anteriormente KFServing) y Seldon Core son frameworks para el despliegue de modelos de aprendizaje automático en Kubernetes. Proporcionan abstracciones de alto nivel para el servicio de modelos, incluyendo autoescalado, versionado, pruebas A/B y despliegues canary. Bajo el capó, pueden utilizar otros servidores de inferencia, como Triton, TensorFlow Serving, PyTorch Serve u ONNX Runtime Server.

Ventajas:

- Potentes capacidades de MLOps: Proporcionan funciones completas para la gestión del ciclo de vida de los modelos, incluyendo versionado, pruebas A/B, despliegues canary y autoescalado.

- Autoescalado: Escalan automáticamente las instancias del modelo en función de la carga, incluyendo el escalado a cero (scale-to-zero) para ahorrar recursos en períodos de inactividad.

- Estandarización del despliegue: Unifican el proceso de despliegue de modelos de ML en Kubernetes, independientemente del framework o servidor de inferencia utilizado.

- Alta disponibilidad y tolerancia a fallos: Utilizan mecanismos integrados de Kubernetes para garantizar alta disponibilidad y autorrecuperación.

- Integración con el ecosistema de Kubernetes: Se integran fácilmente con otros servicios de Kubernetes, como Istio (para enrutamiento de tráfico) y Prometheus/Grafana (para monitoreo).

Desventajas:

- Alta complejidad: Requieren un conocimiento profundo de Kubernetes y tecnologías relacionadas. El despliegue y la gestión de dicha infraestructura pueden ser muy complejos y consumir muchos recursos.

- Sobrecarga de Kubernetes: La plataforma Kubernetes en sí misma y sus componentes (control plane, Kube-proxy, Ingress-controllers) añaden sobrecarga de CPU, memoria y red.

- Capa de abstracción adicional: Aunque la abstracción es conveniente, puede ocultar detalles de optimización de bajo nivel, lo que dificulta el ajuste fino del rendimiento.

- Latencia de "arranque en frío": Al escalar a cero, la primera solicitud a un modelo "frío" puede tener una latencia significativamente mayor debido al tiempo necesario para iniciar un nuevo pod.

Para quién es adecuado:

KServe y Seldon Core son ideales para grandes organizaciones y equipos que ya utilizan activamente Kubernetes para su infraestructura y tienen experiencia con ella. Son indispensables para equipos de MLOps que gestionan un gran número de modelos que requieren estrategias de despliegue complejas (A/B, canary) y autoescalado. Es una solución para aquellos que están dispuestos a invertir en una infraestructura compleja en aras de una alta automatización y fiabilidad a escala.

Consejos prácticos y recomendaciones para optimizar la inferencia con Triton Inference Server

Esquema: Consejos prácticos y recomendaciones para optimizar la inferencia con Triton Inference Server

Esquema: Consejos prácticos y recomendaciones para optimizar la inferencia con Triton Inference Server

En esta sección, nos centraremos en pasos y configuraciones específicos que le ayudarán a lograr el máximo rendimiento y eficiencia al utilizar Triton Inference Server.

1. Selección y optimización de hardware GPU (año 2026)

La elección correcta de la GPU es fundamental. En 2026, el mercado ofrece las siguientes opciones clave:

- NVIDIA Blackwell (B200/GB200): Estas GPU son los buques insignia para la IA, ofreciendo una potencia computacional sin precedentes, especialmente para cálculos FP8 y FP16. Son ideales para los modelos más exigentes y grandes.

- NVIDIA H200/H100: La generación anterior Hopper, todavía muy potente y rentable para muchas tareas. La H200 con memoria aumentada (141 GB HBM3e) es especialmente buena para modelos grandes.

- AMD Instinct MI400-series: Soluciones competitivas de AMD que pueden ofrecer una mejor relación coste/rendimiento en algunos escenarios, especialmente si su ecosistema ya está orientado a ROCm.

- NVIDIA L40S/L4: Para escenarios más económicos o menos exigentes, donde no se necesita un rendimiento extremo de la memoria HBM, pero la densidad y la eficiencia energética son importantes.

Recomendaciones:

- Para modelos que requieren máximo rendimiento y mínima latencia, especialmente para LLM y modelos multimodales, invierta en NVIDIA Blackwell B200/GB200. Ofrecen bloques especializados para FP8 y FP16, así como una interconexión NVLink mejorada.

- Para modelos grandes (LLM) con carga moderada, donde el volumen de memoria es importante, NVIDIA H200 será la elección óptima.

- Para tareas económicas o menos exigentes, considere NVIDIA L40S o L4, que ofrecen una excelente relación precio/rendimiento para la inferencia.

- Utilice NVLink: Si está desplegando varias GPU en un mismo servidor, asegúrese de que estén conectadas a través de NVLink. Esto acelerará significativamente la transferencia de datos entre GPU y permitirá utilizarlas de forma más eficiente en configuraciones multi-GPU de Triton.

2. Optimización de modelos para inferencia

El servidor de inferencia más potente no ayudará si el modelo no está optimizado.

- Cuantificación (Quantization):

La transición de FP32 a FP16 (precisión media), INT8 (precisión entera) o incluso FP8 (en GPU Blackwell) reduce significativamente el tamaño del modelo y el volumen de cálculos, mejorando la latencia y el rendimiento. Para LLM, la cuantificación de 4 bits (GPTQ, AWQ) se está convirtiendo en un estándar.

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer

from accelerate import init_empty_weights, load_checkpoint_and_dispatch

from optimum.gptq import GPTQQuantizer, load_quantized_model_from_config

# Ejemplo de cuantificación para LLM (GPTQ)

model_id = "meta-llama/Llama-2-7b-hf"

quantizer = GPTQQuantizer(bits=4, dataset="wikitext2", model_seqlen=2048)

model_quant = quantizer.quantize_model(model_id, save_dir="llama-2-7b-4bit-gptq")

# O uso de un modelo ya cuantificado

model = load_quantized_model_from_config("llama-2-7b-4bit-gptq")

Recomendación: Siempre busque la cuantificación más agresiva (INT8, FP8, 4-bit) que no conduzca a una degradación inaceptable de la calidad del modelo. Para ello, utilice los métodos QAT (Quantization Aware Training) o PTQ (Post-Training Quantization).

- Compilación con TensorRT:

NVIDIA TensorRT es un SDK para inferencia de alto rendimiento que optimiza redes neuronales para GPU NVIDIA. Realiza optimizaciones de grafo, selecciona núcleos CUDA óptimos y puede cuantificar modelos automáticamente. Triton tiene soporte integrado para el backend de TensorRT.

# Ejemplo de configuración de modelo para Triton con backend TensorRT

# model.json en el directorio del modelo:

# {

# "name": "my_tensorrt_model",

# "platform": "tensorrt_plan", # o tensorrt_onnx

# "input": [ ... ],

# "output": [ ... ],

# "default_model_filename": "model.plan"

# }

# Conversión de ONNX a TensorRT PLAN

trtexec --onnx=model.onnx --saveEngine=model.plan --fp16 # o --int8

Recomendación: Para todos los modelos en GPU NVIDIA, siempre que sea posible, conviértalos a archivos PLAN de TensorRT. Esto proporcionará el mayor aumento de rendimiento. Utilice trtexec para la compilación y prueba.

- ONNX:

La conversión de modelos al formato ONNX y su posterior optimización con ONNX Runtime o TensorRT (a través del backend ONNX-TensorRT en Triton) también mejora significativamente el rendimiento.

3. Configuración de Triton Inference Server

Parámetros clave de configuración que afectan al rendimiento:

- Agrupación dinámica (Dynamic Batching):

Permite a Triton combinar múltiples solicitudes entrantes en un solo lote para la inferencia en la GPU. Esto aumenta significativamente la utilización de la GPU, ya que las GPU procesan lotes de datos más grandes de manera más eficiente. Se configura en el config.pbtxt del modelo.

# config.pbtxt para el modelo

dynamic_batching {

max_queue_delay_microseconds: 100000 # Retraso máximo de la cola en 100 ms

preferred_batch_size: [ 4, 8, 16 ] # Tamaños de lote preferidos

max_batch_size: 32 # Tamaño máximo del lote

}

Recomendación: Experimente con max_queue_delay_microseconds y preferred_batch_size. Una latencia demasiado grande aumentará la latencia, una demasiado pequeña reducirá el rendimiento. Los valores óptimos dependen del modelo y la carga.

- Paralelismo de modelos (Instance Groups):

Permite ejecutar varias copias (instancias) de un mismo modelo en una o varias GPU. Esto es útil para aumentar el rendimiento, especialmente si una sola instancia del modelo no puede cargar completamente la GPU.

# config.pbtxt para el modelo

instance_group [

{

kind: KIND_GPU

count: 2 # Ejecutar 2 instancias del modelo en cada GPU

gpus: [ 0, 1 ] # Usar GPU 0 y 1

}

]

Recomendación: Empiece con count: 1. Si la utilización de la GPU es baja, aumente count hasta que alcance el 90%+ de utilización o se encuentre con una degradación de la latencia.

- Planificadores (Schedulers):

Triton ofrece varios planificadores para gestionar las solicitudes. El predeterminado (Sequence Batcher) es adecuado para la mayoría de los casos. Para modelos con estado (RNN, LLM con historial), utilice Sequence Batcher.

# config.pbtxt para un modelo con estado

sequence_batching {

max_sequence_idle_microseconds: 5000000 # 5 segundos

state_input {

name: "STATE_IN"

data_type: TYPE_FP32

dims: [ 1024 ]

}

state_output {

name: "STATE_OUT"

data_type: TYPE_FP32

dims: [ 1024 ]

}

}

Recomendación: Configure cuidadosamente max_sequence_idle_microseconds para modelos con estado, a fin de equilibrar la conservación del contexto y la liberación de recursos.

- Almacenamiento en caché de modelos:

Triton admite el almacenamiento en caché de modelos en la memoria de la GPU, lo que permite cambiar rápidamente entre ellos sin recargarlos. Para LLM grandes que ocupan toda la memoria de la GPU, esto puede no ser relevante, pero para modelos pequeños utilizados en conjuntos, es crítico.

4. Despliegue en Kubernetes (con KServe/Seldon Core)

Para entornos de producción, Kubernetes es el estándar. La integración de Triton con KServe o Seldon Core simplifica la gestión.

- Uso de Helm-charts:

Para un despliegue rápido de Triton, utilice el Helm-chart oficial de NVIDIA.

helm repo add nvdp https://helm.ngc.nvidia.com/nvidia

helm repo update

helm install triton nvdp/triton-inference-server \

--namespace triton \

--create-namespace \

--set replicaCount=1 \

--set modelRepository.pv.enabled=true \

--set modelRepository.pv.size=50Gi \

--set service.type=LoadBalancer \

--set gpu.enabled=true \

--set nvidia.driver.enabled=false # Suponemos que los drivers ya están instalados

- Integración con KServe:

KServe permite desplegar Triton como uno de los runtimes soportados. Ejemplo de KServe InferenceService para Triton:

apiVersion: "serving.kserve.io/v1beta1"

kind: "InferenceService"

metadata:

name: "my-triton-model"

spec:

predictor:

triton:

protocolVersion: v2 # O v1

storageUri: "s3://my-model-bucket/models/my-triton-model"

resources:

limits:

nvidia.com/gpu: "1" # Solicitar 1 GPU

memory: "32Gi"

requests:

nvidia.com/gpu: "1"

memory: "32Gi"

# También se puede especificar image: "nvcr.io/nvidia/tritonserver:23.09-py3"

Recomendación: Utilice KServe para la abstracción y automatización. Asegúrese de tener instalado el NVIDIA GPU Operator en Kubernetes para el correcto funcionamiento de la GPU.

5. Monitorización y perfilado

Sin monitorización, es imposible entender qué está sucediendo con su inferencia.

- Prometheus y Grafana:

Triton proporciona métricas en formato Prometheus. Configure Prometheus para recopilar estas métricas y Grafana para la visualización. Métricas clave:

nv_gpu_utilization: Utilización de la GPUnv_gpu_memory_used_bytes: Uso de memoria de la GPUnv_inference_request_duration_us: Latencia de las solicitudesnv_inference_request_count: Número de solicitudesnv_inference_queue_duration_us: Tiempo en la cola de agrupación dinámica

- NVIDIA DCGM Exporter:

Para una monitorización más detallada de la GPU, utilice DCGM Exporter, que proporciona métricas de la GPU a nivel de hardware.

# Ejemplo de despliegue de DCGM Exporter en Kubernetes

kubectl apply -f https://raw.githubusercontent.com/NVIDIA/gpu-operator/master/deployments/cluster-monitoring/dcgm-exporter.yaml

- Perfilado con Nsight Systems/Nsight Compute:

Para un análisis profundo del rendimiento de modelos o backends individuales, utilice las herramientas NVIDIA Nsight Systems y Nsight Compute. Ayudan a identificar cuellos de botella a nivel de núcleos CUDA, operaciones de memoria e interacción entre procesos.

# Ejecutar Triton con Nsight Systems para perfilado

nsys profile --output my_triton_profile --duration 60 \

tritonserver --model-repository=/models

Recomendación: Tenga siempre una pila de monitorización configurada. Utilice alertas para métricas críticas (por ejemplo, alta latencia, baja utilización de la GPU, errores). Realice perfilados regularmente para identificar cuellos de botella ocultos.

Errores comunes al desplegar inferencia de IA/ML de alto rendimiento y cómo evitarlos

Esquema: Errores comunes al desplegar inferencia de IA/ML de alto rendimiento y cómo evitarlos

Esquema: Errores comunes al desplegar inferencia de IA/ML de alto rendimiento y cómo evitarlos

Incluso los equipos experimentados se encuentran con obstáculos al optimizar la inferencia. Conocer estos errores ayudará a evitar problemas costosos.

1. Ignorar la optimización de modelos antes del despliegue

Error: Desplegar modelos "crudos" (por ejemplo, en FP32 PyTorch o TensorFlow) sin ninguna optimización (cuantificación, compilación con TensorRT). Muchos creen que una GPU potente y Triton por sí solos resolverán todos los problemas.

Consecuencias: Rendimiento extremadamente bajo, alta latencia, enormes costos de GPU, ya que el modelo no la utiliza de manera eficiente. La GPU puede estar cargada al 20-30% de su capacidad computacional total.

Cómo evitarlo:

- Siempre comience con la optimización del modelo. La cuantificación (INT8, FP8, 4-bit) y la compilación (TensorRT, OpenVINO) deben ser los primeros pasos.

- Utilice perfiladores (Nsight Systems) para evaluar el rendimiento del modelo antes de cargarlo en Triton.

- Incluya la optimización en su pipeline de MLOps para que cada nueva versión del modelo pase automáticamente por la etapa de optimización.

2. Configuración incorrecta del batching dinámico

Error: Establecer un max_queue_delay_microseconds demasiado pequeño o un max_batch_size demasiado grande sin considerar las características del modelo y la carga esperada.

Consecuencias:

max_queue_delay_microseconds demasiado pequeño: Baja utilización de la GPU, ya que Triton no logra recolectar suficientes solicitudes en un lote, lo que resulta en el procesamiento de lotes pequeños.max_batch_size demasiado grande: Aumento de la latencia para solicitudes individuales que esperan a que se complete un lote. También puede provocar errores OOM (Out Of Memory) en la GPU.

Cómo evitarlo:

- Pruebe a fondo el batching dinámico bajo una carga realista. Comience con

preferred_batch_size y max_batch_size pequeños, aumentándolos gradualmente.

- Monitoree las métricas

nv_inference_queue_duration_us y nv_inference_compute_duration_us, así como la utilización de la GPU. Busque un equilibrio entre latencia y rendimiento.

- Utilice

concurrency_limit en config.pbtxt para evitar la sobrecarga de la GPU y los errores OOM.

3. Falta de monitoreo adecuado

Error: Desplegar Triton sin Prometheus/Grafana configurados u otros sistemas de monitoreo.

Consecuencias: Imposibilidad de identificar cuellos de botella de rendimiento, comprender las causas de la degradación del servicio, optimizar el uso de recursos o reaccionar a fallos. Estará "volando a ciegas".

Cómo evitarlo:

- Desde el principio, implemente una pila de monitoreo estándar (Prometheus, Grafana).

- Utilice NVIDIA DCGM Exporter para un monitoreo profundo de la GPU.

- Configure alertas para métricas clave: utilización de la GPU, latencia de las solicitudes, número de errores.

4. Gestión incorrecta de la memoria de la GPU (errores OOM)

Error: Cargar demasiados modelos o instancias de modelos en una sola GPU, lo que lleva a un desbordamiento de la memoria de la GPU.

Consecuencias: Fallos de inferencia, reinicios de pods de Triton, funcionamiento inestable del servicio, pérdida de datos de solicitudes.

Cómo evitarlo:

- Conozca con precisión la cantidad de memoria consumida por cada modelo. Utilice

nvidia-smi o DCGM para el monitoreo.

- Utilice

instance_group con el parámetro count para controlar el número de instancias del modelo en la GPU.

- En Kubernetes, establezca

resources.limits.nvidia.com/gpu y resources.limits.memory adecuados para los pods de Triton.

- Considere la posibilidad de dividir modelos grandes en varias GPU (model parallelism) o utilizar técnicas como la descarga de capas a la CPU, si es posible.

5. Subestimar la complejidad del despliegue en Kubernetes

Error: Asumir que el despliegue de Triton en Kubernetes será tan simple como ejecutar un contenedor Docker.

Consecuencias: Retrasos prolongados en el despliegue, problemas con la configuración de red, el acceso al repositorio de modelos, la integración con los controladores de GPU, el escalado y el monitoreo. Uso ineficiente de los recursos del clúster.

Cómo evitarlo:

- Invierta en la capacitación del equipo de Kubernetes.

- Utilice los Helm charts oficiales de NVIDIA para Triton y NVIDIA GPU Operator para la gestión de controladores de GPU.

- Configure Persistent Volumes para el Model Repository.

- Configure un controlador Ingress y un Service Mesh (por ejemplo, Istio) para la gestión del tráfico y las pruebas A/B.

6. Ignorar el versionado de modelos y las pruebas A/B

Error: Reemplazar directamente un modelo antiguo con una nueva versión sin probarlo en una parte del tráfico.

Consecuencias: Degradación de la calidad de la inferencia, detectada solo después del despliegue completo, lo que puede llevar a pérdidas significativas para el negocio y riesgos reputacionales.

Cómo evitarlo:

- Utilice las capacidades de versionado de modelos de Triton (diferentes subdirectorios en el repositorio).

- Aplique operadores de Kubernetes, como KServe o Seldon Core, que proporcionan mecanismos integrados para despliegues canary y pruebas A/B.

- Siempre pruebe las nuevas versiones de modelos en un pequeño porcentaje del tráfico real antes del despliegue completo.

7. Falta de estrategia para el "arranque en frío" (cold start)

Error: Al utilizar el autoescalado a cero (scale-to-zero), no se considera el tiempo necesario para iniciar el pod y cargar el modelo en la primera solicitud.

Consecuencias: Latencia muy alta para las primeras solicitudes después de un período de inactividad, lo cual es inaceptable para muchas aplicaciones en tiempo real.

Cómo evitarlo:

- Utilice réplicas preestablecidas (min replicas > 0) para modelos críticos, a fin de evitar el arranque en frío.

- Para modelos menos críticos, optimice el tiempo de carga del modelo (por ejemplo, con TensorRT, reduciendo el tamaño del modelo).

- Considere el uso de solicitudes de "calentamiento" (warm-up requests) después de iniciar una nueva instancia.

- En KServe, configure

minReplicas para mantener un número mínimo de pods en ejecución.

FAQ: Preguntas frecuentes sobre Triton Inference Server

1. ¿Qué es Triton Inference Server y para qué sirve?

Triton Inference Server es un servidor de inferencia de alto rendimiento y código abierto, desarrollado por NVIDIA. Está diseñado para el despliegue eficiente de modelos de aprendizaje automático en GPU (y CPU) en entornos de producción. Triton resuelve los problemas de baja utilización de GPU, alta latencia y bajo rendimiento, ofreciendo características como el batching dinámico, el paralelismo de modelos, la inferencia multi-GPU y el soporte para múltiples frameworks de ML. Permite el uso más eficiente posible de los costosos recursos de GPU.

2. ¿Qué frameworks de ML soporta Triton?

Triton soporta una amplia gama de frameworks y formatos de ML populares, incluyendo TensorFlow (SavedModel, GraphDef), PyTorch (TorchScript), ONNX, NVIDIA TensorRT, OpenVINO, Scikit-learn, XGBoost e incluso backends personalizados. Esto permite a los equipos utilizar diferentes modelos en un único servidor de inferencia, unificando el proceso de despliegue.

3. ¿Cuál es la principal diferencia entre Triton y un simple servicio FastAPI con un modelo?

La principal diferencia radica en la profunda optimización para GPU y las funciones avanzadas de gestión de inferencia. Un servicio FastAPI requiere la implementación manual de batching dinámico, paralelismo y gestión de memoria de GPU, lo cual es muy complejo. Triton proporciona estas funciones "de fábrica", maximizando la utilización de la GPU, reduciendo la latencia y aumentando el rendimiento sin un esfuerzo significativo por parte del desarrollador.

4. ¿Qué es el batching dinámico y cómo se configura?

El batching dinámico es un mecanismo de Triton que agrupa varias solicitudes entrantes en un único "lote" para su procesamiento en la GPU. Las GPU procesan lotes de datos grandes de manera mucho más eficiente. Esto se configura en el archivo config.pbtxt del modelo, utilizando la sección dynamic_batching, donde se especifican max_queue_delay_microseconds (tiempo máximo de espera de una solicitud en la cola) y preferred_batch_size (tamaños de lote preferidos).

5. ¿Cómo ayuda Triton a ahorrar dinero?

Triton ahorra dinero al maximizar la utilización de las costosas GPU. En lugar de pagar por GPU inactivas, Triton permite exprimir al máximo su rendimiento, procesando más solicitudes por segundo en el mismo hardware. Esto reduce el número de instancias de GPU necesarias, disminuyendo los costos en la nube y los gastos de energía (para implementaciones on-premise).

6. ¿Se necesita Kubernetes para trabajar con Triton?

No, Triton se puede ejecutar como un contenedor Docker normal en cualquier servidor con GPU. Sin embargo, para entornos de producción donde la autoescalabilidad, la alta disponibilidad, el versionado de modelos y la gestión centralizada son importantes, Kubernetes se convierte en el estándar de facto. La integración de Triton con Kubernetes a través de KServe o Seldon Core simplifica significativamente las MLOps.

7. ¿Qué es TensorRT y por qué es importante para Triton?

TensorRT es un SDK de NVIDIA para inferencia de alto rendimiento que optimiza las redes neuronales para las GPU de NVIDIA. Realiza optimizaciones de gráficos, selecciona los núcleos CUDA óptimos y puede cuantificar modelos. Triton tiene soporte nativo para el backend de TensorRT. El uso de modelos optimizados con TensorRT en Triton proporciona el mayor aumento de rendimiento en las GPU de NVIDIA.

8. ¿Cómo monitorear el rendimiento de Triton?

Triton proporciona métricas en formato Prometheus, que se pueden recopilar y visualizar utilizando Prometheus y Grafana. Las métricas clave incluyen la utilización de la GPU, el uso de la memoria de la GPU, la latencia de las solicitudes, el tiempo en la cola de batching, el número de solicitudes y los errores. Para un monitoreo más profundo de la GPU, se puede utilizar NVIDIA DCGM Exporter.

9. ¿Puedo desplegar varios modelos en una sola GPU con Triton?

Sí, Triton soporta la inferencia de múltiples modelos. Puede cargar varios modelos en un único servidor Triton, y este distribuirá eficientemente los recursos de la GPU entre ellos. Esto es especialmente útil para modelos pequeños o para conjuntos de modelos, permitiendo maximizar la utilización de la GPU.

10. ¿Qué errores típicos se deben evitar al usar Triton?

Los errores más comunes incluyen: ignorar la optimización de modelos (cuantificación, TensorRT), una configuración incorrecta del batching dinámico (lo que lleva a una baja utilización o alta latencia), la falta de un monitoreo adecuado, una gestión incorrecta de la memoria de la GPU (errores OOM) y subestimar la complejidad del despliegue en Kubernetes sin la preparación adecuada.

11. ¿Cómo maneja Triton las solicitudes a modelos con estado (por ejemplo, LLM con historial)?

Triton proporciona un planificador especial sequence_batching para modelos con estado. Permite agrupar solicitudes que pertenecen a una misma secuencia lógica (por ejemplo, un diálogo) y enviarlas para inferencia junto con el estado anterior del modelo. Esto asegura un manejo correcto del contexto y permite aplicar el batching dinámico incluso para solicitudes secuenciales.

12. ¿Se puede usar Triton en CPU?

Sí, Triton soporta la inferencia en CPU. Aunque su principal ventaja se revela en las GPU, puede usar Triton para servir modelos en CPU, especialmente si no tiene acceso a una GPU o para tareas menos exigentes. Para la inferencia en CPU, Triton también ofrece backends para ONNX Runtime, OpenVINO y otros frameworks optimizados para CPU.